决策树一棵对数据属性进行判断,得到分类或回归结果的二叉树或多叉树分类决策树本质上是一个多维空间上的分段线性划分,回归决策树是分段常数函数决策树通过递归分裂过程找到决策边界决策树从不纯度角...

”调参“ 的搜索结果

sklearn快速入门教程–(四)模型自动调参 上个教程中我们已经看到在sklearn中调用机器学习模型其实非常简单。但要获得较好的预测效果则需要选取合适的超参数。在实际的项目中其实也有不少参数是由工程师借助其经验...

深度强化学习算法调参

标签: 强化学习

主要是一些深度强化学习算法的调参技巧

深度学习调参指南.pptx

文章发布于公号【数智物语】 (ID:decision_engine),关注公号不错过每一篇干货。 来源 | 博客园 ...随机森林是一种有监督学习算法,是以决策树为基学习器的集成学习算法。随机森林非常简单,易于实现,计算...

参考了PyTorch官方文档和Ray Tune官方文档 1、HYPERPARAMETER TUNING WITH RAY TUNE 2、How to use Tune with PyTorch 以PyTorch中的CIFAR 10图片分类为例,... 定义用于模型调参的搜索空间。 下面以示例代码解析

目前调参方案有: 贪心调参 参考:https://blog.csdn.net/m0_37893230/article/details/104449166 网格调参 随即搜索调参 贝叶斯调参 参考:https://zhuanlan.zhihu.com/p/54030031 时间紧,改天再整理完善

apm调参软件。。。。。

标签: AAAA

apm地面站。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。。

move_base调参记录

标签: 机器人

深度学习调参指南中文版,机器学习,深度学习,调参指南,深度学习

1、scikit-learn GBDT类库概述 在sacikit-learn中,GradientBoostingClassifier为GBDT的分类类, 而GradientBoostingRegressor为GBDT的回归类。两者的参数类型完全相同,当然有些参数比如损失函数loss的可选择项并不...

P2飞控调参软件, 买飞控配套的。之前用过挺好的,现在不用P2飞控了。

本文为原创文章转载必须注明...终于今天开始着手写这篇关于参数的文章了,可以说我自己其实也在一直进行着各种调参而且有了一段时间了。作为自己的见解和相应的相关知识理论将会在这篇文章里为大家写出来,以做参考...

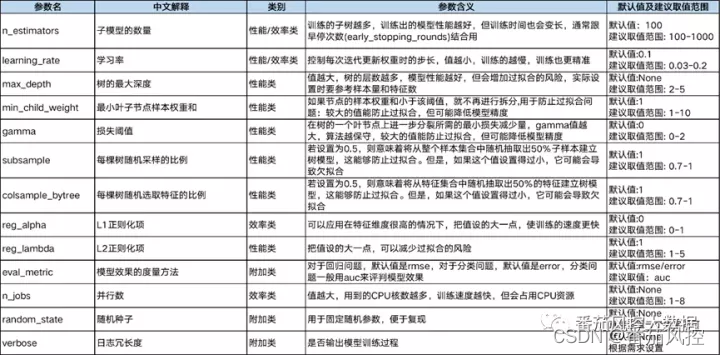

文章目录一、LightGBM 原生接口重要参数训练参数预测方法绘制特征重要性分类例子回归例子二、LightGBM 的 sklearn 风格接口LGBMClassifier基本使用例子LGBMRegressor基本使用例子三、LightGBM 调参思路四、参数网格...

关于优化函数的调整 ... class torch.optim.Optimizer(params, defaults) 所有优化的基类. 参数: ...params (iterable) —— 可迭代的Variable 或者 dict... defaults-(dict):包含优化选项的默认值的dict(一个参...

degree:int型参数 默认为3 这个参数只对多项式核函数有用,是指多项式核函数的阶数n 如果给的核函数参数是其他核函数,则会自动忽略该参数。 ############################################## gamma:float参数 默认...

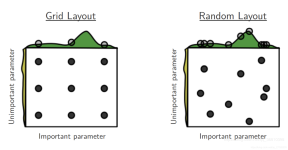

1.机器学习常用三种调参方法:网格搜索、随机搜索和贝叶斯调参2.网格搜索是遍历式搜索方法,效率较低,资源消耗多3.网格搜索和随机搜索都没有考虑前面搜索的先验知识4.贝叶斯调参的原理是贝叶...

调参技巧1

译文部分:多旋翼无人机PID调参指南不用碳化纤维或增强碳化纤维桨调整多轴,不使用损坏的桨片。 出于安全考虑,系统默认增益都设置的比较小。请增加增益以便获取更好的控制响应。 本指导方案适用于所有的多轴飞行...

为了保证DRL算法能够顺利收敛,policy性能达标并具有实用价值,结果有说服力且能复现,需要算法工作者在训练前、训练中和训练后提供全方位一条龙服务。我记得GANs刚火起来的时候,因为训练难度高,有人在GitHub上...

借助Ray-tune可以对pytorch自动调参,下面就一步步地改写,从原始的训练代码慢慢变为可以自动调参的代码的教程• 保姆级: 安装依赖 pip install -i https://mirrors.aliyun.com/pypi/simple/ 'ray[default]' 注意...

推荐文章

- Android RIL框架分析-程序员宅基地

- Python编程基础:第六节 math包的基础使用Math Functions_ps math function-程序员宅基地

- canal异常 Could not find first log file name in binary log index file_canal could not find first log file name in binary-程序员宅基地

- 【练习】生成10个1到20之间的不重复的随机数并降序输出-程序员宅基地

- linux系统扩展名大全,Linux系统文件扩展名学习-程序员宅基地

- WPF TabControl 滚动选项卡_wpf 使用tabcontrol如何给切换的页面增加滚动条-程序员宅基地

- Apache Jmeter常用插件下载及安装及软硬件性能指标_jmeter插件下载-程序员宅基地

- SpringBoot 2.X整合Mybatis_springboot2.1.5整合mybatis不需要配置mapper-locations-程序员宅基地

- ios刷android8.0,颤抖吧 iOS, Android 8.0正式发布!-程序员宅基地

- 【halcon】C# halcon 内存暴增_halcon 读二维码占内存-程序员宅基地