”特征值“ 的搜索结果

特征值和特征向量是计算机视觉以及机器学习中常常会用到的概念,比如PCA(主成分分析)等算法。这篇文章中会记录一些我自己对矩阵的特征值和特征向量的理解以及学习笔记。 从简单实例理解 如上图是一个简单的...

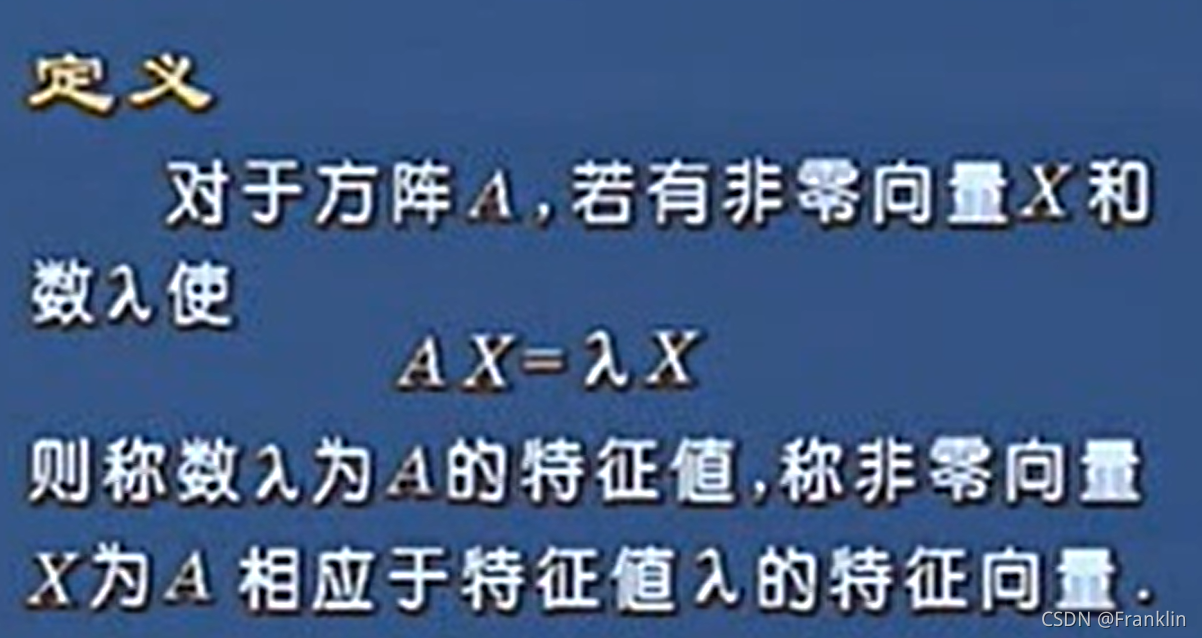

在刚开始学的特征值和特征向量的时候只是知道了定义和式子,并没有理解其内在的含义和应用,这段时间整理了相关的内容,跟大家分享一下; 首先我们先把特征值和特征向量的定义复习一下: 定义: 设A是n阶矩阵...

在MATLAB语言中,求矩阵的特征值和特征向量需要用到两个函数:eig()、diag() diag():可生成一个对角矩阵 调用eig函数的格式为: [x,y]=eig(A) 其中矩阵y的对角线元素存储的是A的所有特征值,且从小到大排列;而...

特征值和特征向量的作用

标签: 特征值和特征向量

本文转自知乎大牛。 从定义出发,Ax=cx:A为矩阵,c为特征值,x为特征向量。 矩阵A乘以x表示,对向量x进行一次转换(旋转或拉伸)(是一种线性转换),而该转换的效果为常数c乘以向量x(即只进行拉伸)。 ...

基础库 1.1.0 开始支持,低版本需做兼容处理向低功耗蓝牙设备特征值中写入二进制数据。注意:必须设备的特征值支持write才可以成功调用,具体参照 characteristic 的 properties 属性tips: 并行调用多次读写接口存在...

一、特征值和特征向量的定义 1 首先让我们来了解一下特征值和特征向量的定义,如下: 2 特征子空间基本定义,如下: END 二、特征多项式 1 特征多项式的定义,如下: 2 推论:...

如何理解矩阵特征值的意义? 毕业多年,曾经有同事问我该如何理解特征值的意义? 当时,实在羞愧,我一学数学的,真不知该如何回答。 ...... 多年后有点感悟了,就当还愿吧,本文将从几何、医学、物理三个视角试图...

目录特征值与特征向量齐次线性方程组的解参考完 特征值与特征向量 对nnn阶矩阵AAA,如果数λ\lambdaλ和nnn维非零列向量xxx使关系式 Ax=λxAx=\lambda xAx=λx 成立,那么,这样的数λ\lambdaλ称为矩阵AAA特征值,...

import numpy as np A = np.array([[1, -1, 3], [-5, 3, 9], [1, 0, -2]]) eigenvalue, featurevector = np.linalg.eig(A) print(eigenvalue) print(featurevector) ...[-3.27491722 1....[ 0.83410767 0.6

特征值分解和奇异值分解(SVD)在主成分分析(PCA)和机器学习领域都有广泛的应用。PCA的实现由两种方法,一种是特征值分解,另一种是奇异值分解,特征值分解和奇异值分解的目的是一样的,都是提取出一个矩阵最重要...

矩阵的秩与特征值矩阵的秩为1 矩阵的秩为1 设n阶矩阵A,n>1n>1n>1,(n阶矩阵一定有n哥特征值,且有且仅有n个) 因为r(A)<n,一定有非零解 ∣A−λE∣=0|A-\lambda E|=0∣A−λE∣=0,所以必定有个λ\...

题题目线性代数A矩阵乘以A的转置的含义或者几何意义我是在最小二乘法和SVD分解这部分知识中看到的,非常的迷惑,而且为什么A的转置乘以A的特征值是和A乘以A的转置的特征值是相同的呢重分!优优质解答(下面以A(T)表示A的...

特征值D、特征向量V的概念(A^n= V * D^n * VT通过将矩阵分解,使A的n次方运算更快速) %MATLAB A = [4,-5;2,-3]; [U,D] = eig(A) ss=A*U hh=U*D EVD特征值分解 通过迭代获得主(最大)特征值 ...

写的很好,收藏用,转载自:https://blog.csdn.net/qq_36653505/article/details/82025971

λ\lambdaλ为特征向量v的特征值,特征值分解是将一个矩阵分解为如下形式:A=Q∑Q−1A=Q\sum Q^{-1}A=Q∑Q−1其中Q是这个矩阵A的特征向量所组成的矩阵,∑\sum∑是一个对角矩阵,每一个对角线元素就是一个特征值,...

特征值处理-机器学习

标签: 数据挖掘

综述 如上图所示是一个经典的机器学习问题框架图。数据清洗和特征挖掘的工作是在灰色框中框出的部分,即“数据清洗=>... 对清洗出的特征和标注数据进行处理,例如样本采样,样本调权,异常点去除,特征归一化处...

若已知矩阵为A,则[V,D]=eig(A),其中对角阵D的对角元素为A的特征值,而矩阵D的每一列向量为其所对应的特征向量.A =0.3132 0.3566 0.2545 0.2579 0.2063-0.0897 0.2913 0.1888 0.4392 0.14700.0845 0.2433 -0.5888 -...

此篇为《线性代数》,第四版,经济科学出版社出版,为B站宋浩老师《线性代数》教学视频所用教材,自己也是跟着宋老师学,边学边做笔记,在此特别感谢像宋老师一样无私奉献的人。本书共7章,纯手工码字,视内容多少,...

学习矩阵对角化(diagonalization)时需要了解一个定理:**不同特征值对应的特征向量线性无关**。我们知道,一个 n 维矩阵是否可以对角化取决于其是否具有 n 个线性无关的特征向量。所以,在上面的定理的基础上可以...

线性代数 特征值和特征向量的理解 首先,n阶方阵在几何上对应的是某一种线性变换。 n维空间中的一个向量乘以该矩阵,得到的结果就是在空间中对这个向量进行该矩阵对应的线性变换后得到的向量。 因此,特征值和特征...

推荐文章

- 机器学习之超参数优化 - 网格优化方法(随机网格搜索)_网格搜索参数优化-程序员宅基地

- Lumina网络进入SDN市场-程序员宅基地

- python引用传递的区别_php传值引用的区别-程序员宅基地

- 《TCP/IP详解 卷2》 笔记: 简介_tcpip详解卷二有必要看吗-程序员宅基地

- 饺子播放器Jzvd使用过程中遇到的问题汇总-程序员宅基地

- python- flask current_app详解,与 current_app._get_current_object()的区别以及异步发送邮件实例-程序员宅基地

- 堪比ps的mac修图软件 Pixelmator Pro 2.0.6中文版 支持Silicon M1_pixelmator堆栈-程序员宅基地

- 「USACO2015」 最大流 - 树上差分_usaco 差分-程序员宅基地

- Leetcode #315: 计算右侧小于当前元素的个数_找元素右边比他小的数字-程序员宅基地

- HTTP图解读书笔记(第六章 HTTP首部)响应首部字段_web响应的首部内容-程序员宅基地