爬虫(又称为网页蜘蛛,网络机器人,在 FOAF 社区中间,更经常的称为网页追逐者);它是一种按照一定的规则,自动地抓取网络信息的程序或者脚本。 如果我们把互联网比作一张大的蜘蛛网,那一台计算机上的数据便是...

”爬虫总结和详解“ 的搜索结果

上一节《【Django 022】中间件Middleware(一):Django中间件本质和处理流程详解》中,我们了解了中间件的本质和执行逻辑,这一节就来自己动手制作一个用来反爬虫的中间件。 我是T型人小付,一位坚持终身学习的...

通过本文介绍的进阶技巧,包括使用代理IP和处理动态加载内容,以及处理登录和验证码,读者可以更加灵活地应对各种爬虫场景。不过需要注意,在进行网络爬虫时,应遵守网站的相关规定和法律法规,以确保合法和道德的...

这篇文章主要介绍了使用正则表达式实现网页爬虫的思路详解,需要的朋友可以参考下网页爬虫:就是一个程序用于在互联网中获取指定规则的数据。思路:1.为模拟网页爬虫,我们可以现在我们的tomcat服务器端部署一个1....

python3.7简单的爬虫,具体代码如下所示:#https://www.runoob.com/w3cnote/python-spider-intro.html#Python 爬虫介绍import urllib.parseimport urllib.requestfrom ...

注:urllib模块作用和requests模块一样,都是基于网络请求的模块。当requests问世后就迅速代替了urllib 2、上述两种方法爬取图片的不同之处是什么? 使用urllib的方式爬取图片无法进行UA伪装,而r...

在使用jsoup爬取其他网站数据的时候,发现class是带空格的多选择,如果直接使用doc.getElementsByClass(“class的值”),这种方法获取不到想要的数据。1、问题描述:在使用jsoup爬取其他网站数据的时候,发现class是...

为了让小伙伴们更加深入的学习本文所讲的页面解析库,我先一步肝了一篇HTML万字详解,希望小伙伴们认认真真看完,看明白,看懂,多敲敲,日后你们自会感受到本博主的用意——当我学到一定...但是爬虫爬虫,重在爬取到。

scrapy-redis分布式爬虫框架详解 随着互联网技术的发展与应用的普及,网络作为信息的载体,已经成为社会大众参与社会生活的一种重要信息渠道。由于互联网是开放的,每个人都可以在网络上发表信息,内容涉及各个方面...

① Python所有方向的学习路线图,清楚各个方向要学什么东西② 600多节Python课程视频,涵盖必备基础、爬虫和数据分析③ 100多个Python实战案例,含50个超大型项目详解,学习不再是只会理论④ 20款主流手游迫解 爬虫...

总的来说,编写程序时遇到的错误可大致分为 2 类,分别为语法错误和运行时错误。在 Python 中,把这种运行时产生错误的情况叫做异常(Exceptions),常见的几种异常情况如下:1. 语法错误语法错误,即解析代码时出现...

python 爬虫 xpath 详解 导入模块 代码: from bs4 import etree 实例化一个etree对象 代码: tree=etree.parse('test.html') #将网页源码解析并加载到了该对象中 xpath表达式 层级定位 /:表示的是从根节点开始...

但目前Scrapy的用途十分广泛,可用于如数据挖掘、监测和自动化测试等领域,也可以应用在获取API所返回的数据(例如 Amazon Associates Web Services ) 或者通用的网络爬虫。Scrapy 是基于twisted框架开发而来,...

scrapy-redis分布式爬虫框架详解 随着互联网技术的发展与应用的普及,网络作为信息的载体,已经成为社会大众参与社会生活的一种重要信息渠道。由于互联网是开放的,每个人都可以在网络上发表信息,内容涉及各个方面...

用Splash做页面抓取时,如果爬取的任务非常多且量非常大,用一个Splash服务来处理的话压力很大,此时可以考虑搭建一个负载均衡器来把压力分散到各个服务器上。这相当于多台机器多个服务共同参与任务的处理,可以减小...

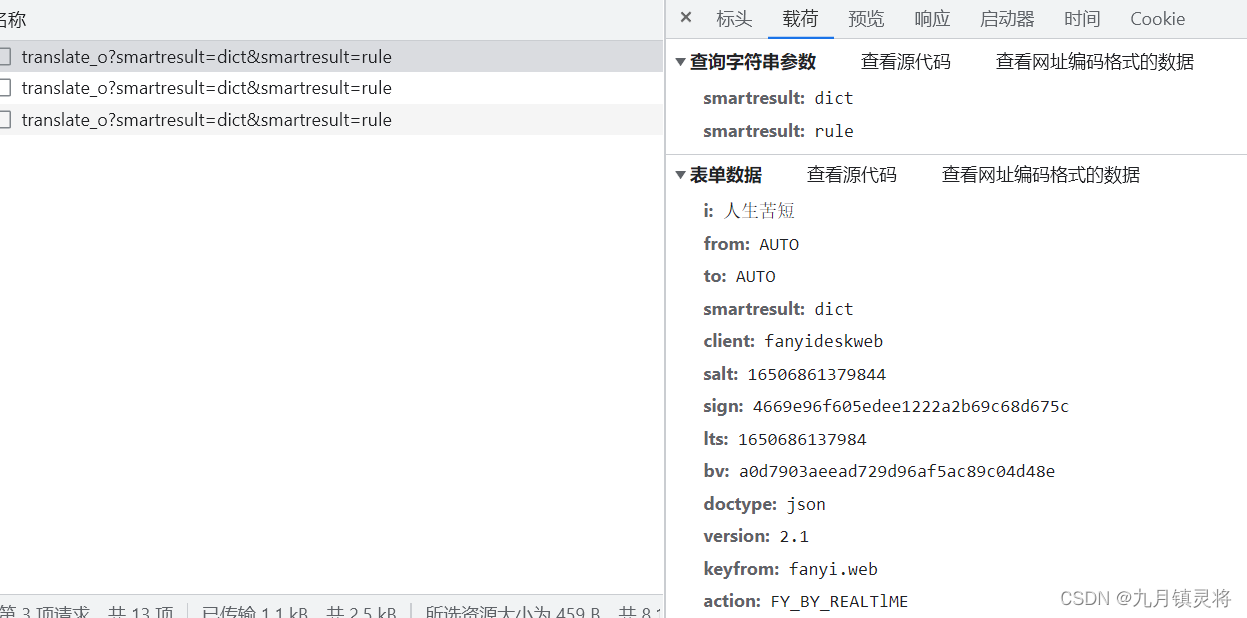

Requests是用Python编写,基于urllib,采用Apache2 Licensed开源协议的HTTP库。它比urllib更方便,可以节约我们大量的工作,完全满足HTTP测试需求。 安装: pip3 install requests 使用 ...print(ty...

1. HTTP和HTTPS 1.1 HTTP和HTTPS的关系 HTTP协议(HyperText Transfer Protocol,超文本传输协议):是一种发布和接收 HTML页面的方法。 HTTPS(Hypertext Transfer Protocol over Secure Socket Layer)简单讲是...

python3.7简单的爬虫,具体代码如下所示:#https://www.runoob.com/w3cnote/python-spider-intro.html#Python 爬虫介绍import urllib.parseimport urllib.requestfrom http import cookiejarurl = "...

上节我们讲了Scrapy框架的安装及遇到错误如何解决,本节我们正式进入Scrapy框架的应用阶段。在开始爬取之前,首先我们必须创建一个新的Scrapy项目,创建一个Scrapy项目本质上就是创建一种文件结构。...

这篇短文的目的是分享我这几天里从头开始学习Python爬虫技术的经验,并展示对爬取的文本进行情感分析(文本分类)的一些挖掘结果。 不同于其他专注爬虫技术的介绍,这里首先阐述爬取网络数据动机,接着以豆瓣影评为例...

云原生网关kong使用详解

这一过程通过爬虫来实现,收集百度网盘地址和提取码,采用xpath爬虫技术1、首先分析图片列表页,该页按照更新先后顺序暂时套图封面,查看HTML结构。每一组“li”对应一组套图。属性href后面即为套图的内页地址(即...

推荐文章

- python——stack()和unstack()用法_unstack函数-程序员宅基地

- C语言调用sqlite3命令语句实现将txt文件导入到数据库中_从txt导入到sqlite-程序员宅基地

- AOP与OOP有什么区别,谈谈AOP的原理是什么,大厂Android高级面试题汇总解答-程序员宅基地

- 最小费用流_单向图费用流-程序员宅基地

- Python中的5个高阶概念属性的知识点!你要了解明白哦!_python属性的五大类-程序员宅基地

- python 基于PHP+MySQL的装修网站的设计与实现_python抓取装修需求-程序员宅基地

- ubuntu完美的nvidia驱动安装方式(ubuntu16+驱动410+cuda10.0)or(ubuntu16+驱动455+cuda11.1)_乌班图英伟达驱动选着哪个版本-程序员宅基地

- 解决redis超时io.lettuce.core.RedisCommandTimeoutException: Connection timed out after 5s-程序员宅基地

- 基于OFDM+64QAM系统的载波同步matlab仿真,输出误码率,星座图,鉴相器,锁相环频率响应以及NCO等-程序员宅基地

- Springboot毕设项目超市商品销售管理系统37x2w(java+VUE+Mybatis+Maven+Mysql)_vue+springboot+mybatis商品管理系统-程序员宅基地