”多任务学习“ 的搜索结果

多任务学习简单例子,包含多任务学习的数据创建,训练,作图的matlab代码

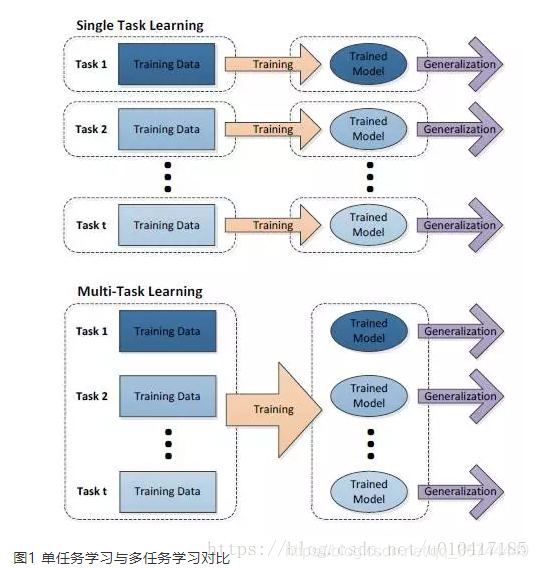

多任务学习的基本思想是:多个任务之间存在一定的相关性或公共特征,我们可以利用这些公共知识来提升各个任务的学习效果。在此过程中,模型参数会根据所有任务的损失函数进行更新,从而同时学习多个任务。共享词向量层和...

我们之前讲过的模型通常聚焦单个任务,比如预测图片的类别等,在训练的时候,我们会关注某一个特定指标的优化.但是有时候,我们需要知道一个图片,从它身上知道新闻的类型(政治/体育/娱乐)和是...这种方法就叫做多任务学习.

多任务学习(Multi-Task Learning) Multi Task Learning. 本文目录: 多任务学习的定义及特点 多任务学习的网络结构 多任务学习的损失函数

多任务学习(Multi-Task Learning, MTL)是机器学习中的一种学习范式,其目的是利用多个相关任务中包含的有用信息来帮助提高所有任务的泛化性能。本文从算法建模、应用和理论分析三个方面对MTL进行了综述。在算法建模...

3.1 提高泛化能力的潜在原因3.2 多任务学习机制3.3 后向传播多任务学习如何发现任务是相关的4 多任务学习可被广泛应用?4.1 使用未来预测现在4.2 多种表示和度量4.3 时间序列预测4.4 使用不可操作特征4.5 使用额外...

只使用单个任务的样本信息局限性1、忽略其它任务的经验信息,致使训练冗余重复和学习资源浪费,限制性能提升2、对于训练样本少且特征维数高的任务,单任务学习出现秩亏且存在过拟合风险给定MMM个任务Tmm1MTmm1M...

多任务学习(Multitask Learning, MTL)是一种人工智能技术,它涉及到在同一系统中学习多个任务,以便在学习过程中共享信息,从而提高学习效率和提高任务性能。多任务学习是一种有趣的人工智能技术,它可以在许多领域...

深度学习中的多任务学习介绍

标签: MTL

在2017年有一篇关于在深度神经网络中多任务学习概述的论文:《An Overview of Multi-Task Learning in Deep Neural Networks》,论文链接为:https://arxiv.org/pdf/1706.05098.pdf,它介绍了在深度学习中多任务学习...

整理学习之多任务学习

标签: 深度学习

深度学习-多任务学习总结

标签: 深度学习

多任务学习是通过合并几个任务中的样例(可以视为对参数施加的软约束)来提高泛化的一种方式。正如额外的训练样本能够将模型参数推向具有更好泛化能力的值一样,当模型的一部分被多个额外的任务共享时,这部分将被...

点击上方,选择星标或置顶,每天给你送干货!阅读大概需要15分钟跟随小博主,每天进步一丢丢来自:DataFunTalk文章作者:邱锡鹏复旦大学计算机科学技术学院教授、博士生导师内容来源:...

Multi-Task Learning Loss

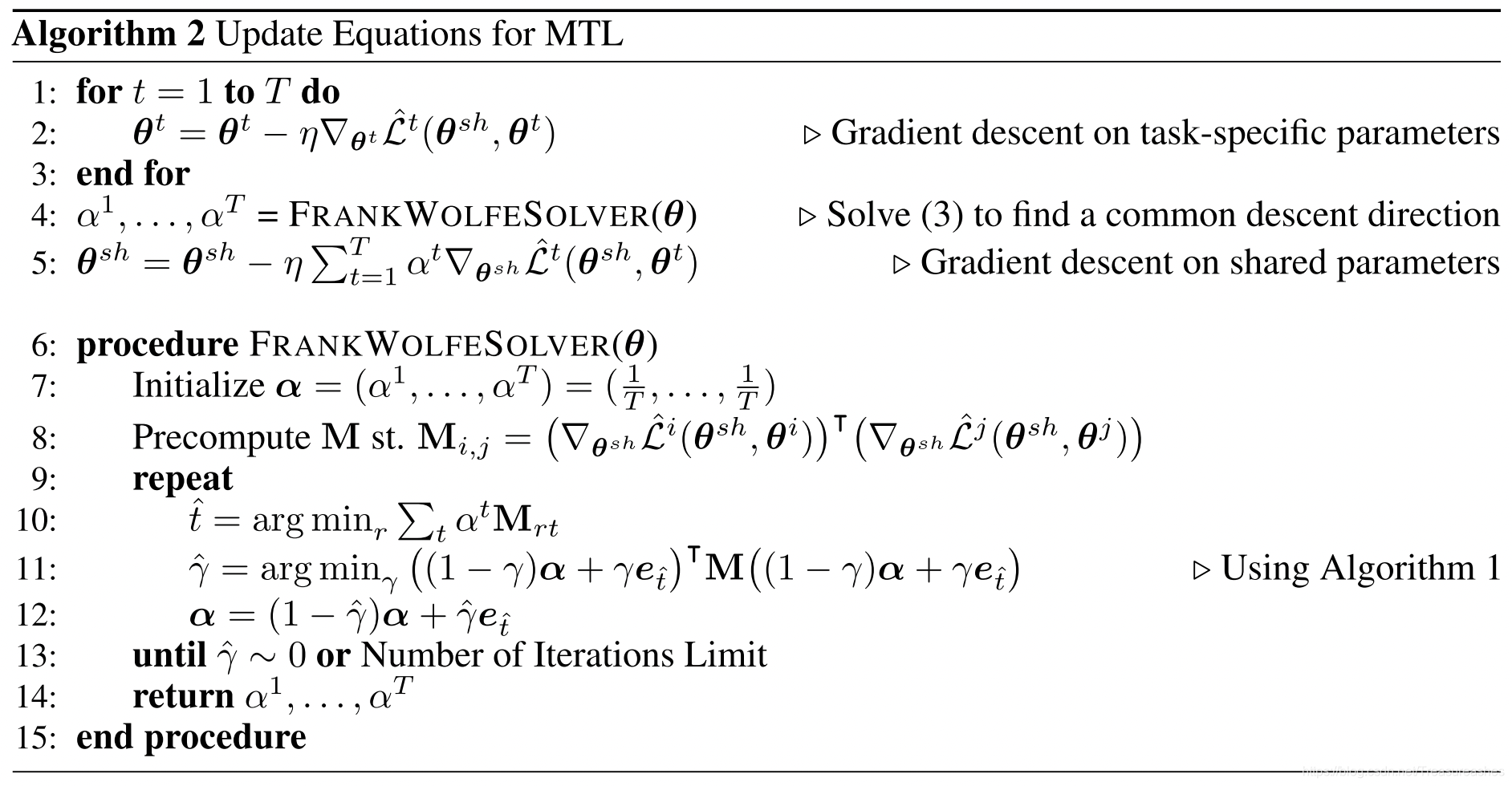

深度学习中,针对loss权重的优化是重要的改进方向,许多深度学习应用都受益于具有多重回归和分类目标的多任务学习。每年的顶会都会出现不少关于loss优化的文章,还有大量的新loss定义方式,眼花缭乱。因此,一个深度...

神经网络的多任务学习概览

标签: 多任务学习

1. 前言 在机器学习中,我们通常关心优化某一特定指标,不管这个指标是一个标准值,还是...为了达到这个目标,我们训练单一模型或多个模型集合来完成指定得任务。然后,我们通过精细调参,来改进模型直至性能不...

推荐文章

- pyhton object is not subscriptable 解决_polygon' object is not subscriptable-程序员宅基地

- Linux系统引导.服务与实验-程序员宅基地

- 在线黑色响应式全屏滚动主页html源码_黑色响应式全屏滚动主页源码-程序员宅基地

- ubuntu php7 memcache,linux上安装php7 memcache扩展-程序员宅基地

- adb:设置手机屏幕亮度_自动化判断是否打开自动亮度调节-程序员宅基地

- WCF使用总结_wcfv-程序员宅基地

- Android Keystore忘记密码怎么办?_keystore密码忘记了-程序员宅基地

- 2119数据结构实验之链表四:有序链表的归并_链表2119csdn-程序员宅基地

- kali 2020.3中fierce没有-dns等参数_fierce: error: unrecognized arguments: -dns-程序员宅基地

- 《哪吒之魔童降生》手稿首曝光!上映5天破11亿,Ta凭什么能火?-程序员宅基地