昨日答辩被老师完虐,问到了机器学习的可解释性,发现这方面资料比较少,而这个概念在我答辩之前的理解都是停留在字面意思的错误理解 待我明日阅读文献后填充

”可解释性“ 的搜索结果

一、著名的大佬课题组 1、张拳石教授的知乎 张老师的知乎个人简介: I am leading a group for explainable AI. The related topics include explainable CNNs, explainable generative networks, unsupervised ...

什么是机器学习的可解释性? - 可解释性(explainability)有大量的近义词,比如可理解 (understandable), 可诠释 (interpretable), 透明(transparent), 可靠 (robust), 公平 (fair), 明确(explicit),忠实(faithful),...

所谓的可解释性其实也分为两种,一种是局部可解释性,一般指的是机器说明如何判断这个样例(例如分类问题中,机器如何将一张猫的图片分成猫);另一种是全局可解释性,一般指的是机器如何对总体进行特征判断(例如...

模型的可解释性是机器学习领域的重要研究课题,主要关注两个方向,一个是提升模型本身的可解释性,如引入注意力机制、解耦表示学习等技术;另一个是对黑盒模型的事后解释,如特征掩码技术、可视化技术等。图结构提供...

导语 | 深度学习是黑盒模型。虽然它能在一些任务上表现得十分出色,但是人们却无法理解它是如何做出的决策。近年来,越来越多的研究者对于如何解释深度学习的推理过程产生了很大的兴趣,模型的可解...

作者 | 王小贱(被编程耽误的设计师,热爱产品的数据民工)来源 | BIGSCity知乎专栏《深度学习的可解释性研究》系列文章希望能用尽可能浅显的语言带领大家了解可解释性...

在这篇文章中:可解释性是什么?我们为什么需要可解释性?有哪些可解释性方法?在建模之前的可解释性方法建立本身具备可解释性的模型在建模之后使用可解释性性方法作出解释关于 BIGSCity参考文献不以人类可以理解的...

本文讲解了一些理解 CNN 可视化的方法(特征、滤波器可视化),以及一些有趣的应用,如DeepDream、图像神经风格迁移(特征反演 + 纹理生成)等【对应 CS231n Lecture 12】

深度神经网络的解释方法有很多,每种解释方法都有各自的优缺点。在大多数情况下,我们感兴趣的是局部解释方法,即对特定输入的网络输出的解释,因为DNNs往往过于复杂,无法进行全局解释(独立于输入)。 一般而言,...

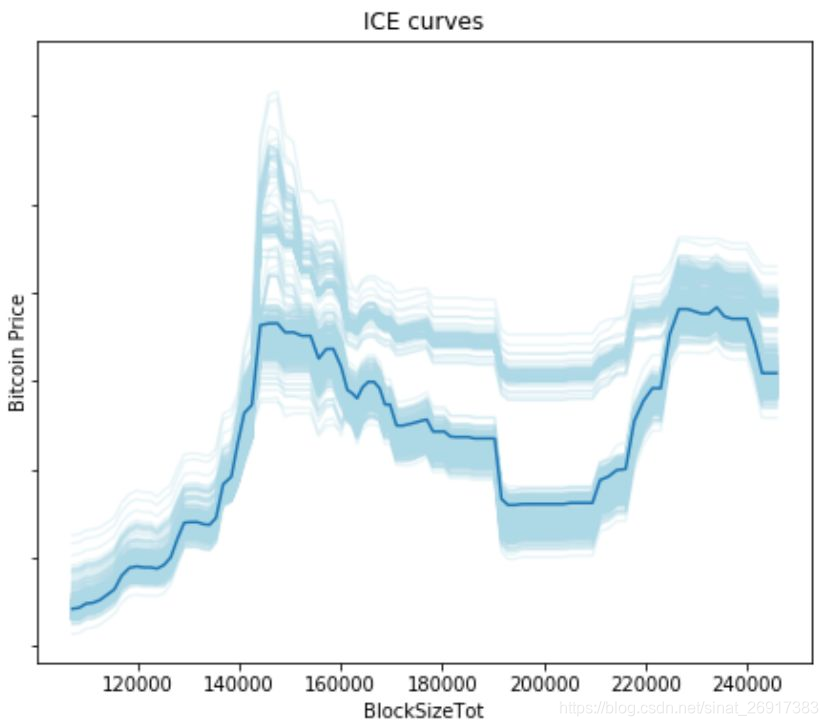

Xgboost相对于逻辑回归模型在进行预测时往往有更好的精度,但是同时也失去了线性模型的可解释性。 Feature importance可以直观地反映出特征的重要性,看出哪些特征对最终的模型影响较大。但是无法判断特征与最终...

本篇博文主要来源于对文章 Unwrapping The Black Box of Deep ReLU Networks: Interpretability, Diagnostics, and Simplification 的学习,同时还有部分内容摘自wiki百科。 什么是ReLU函数? ...

一、背景 深度模型成绩斐然,然而它就像一个黑箱子一样捉摸不透,使用者不知道它到底学到了些什么,也不知道它有什么凭据作出...伟大的研究者们开始进行可解释性研究,针对LSTM,目前有词向量的聚类可视化,hidden...

最近在学习可解释性方面的内容,主要是用cam做可解释性,因此想要系统地学习一下。 参考: keras CAM和Grad-cam原理简介与实现 GAP CAM Grad-CAM Grad-CAM++的解释 pytorch实现所有cam衍生 ECG-Grad-CAM CAM 将原...

在算法建模过程中,我们...尤其当模型应用到银行业等金融领域时,透明度和可解释性是机器学习模型是否值得信任的重要考核标准。我们需要告诉业务人员如何营销,告诉风控人员如何识别风险点,而不仅仅告诉他们预测...

推荐文章

- 阿里云企业邮箱的stmp服务器地址_阿里云stmp地址-程序员宅基地

- c++ 判断数学表达式有效性_高考数学大题如何"保分"?学霸教你六大绝招!...-程序员宅基地

- 处理office365登录出现服务器问题_o365登陆显示网络异常-程序员宅基地

- Nginx RTMP源码分析--ngx_rtmp_live_module源码分析之添加stream_ngx_rtmp_live_module 原理-程序员宅基地

- 基于Ansible+Python开发运维巡检工具_automation_inspector.tar.gz-程序员宅基地

- Linux Shell - if 语句和判断表达式_shell if elif-程序员宅基地

- python升序和降序排序_Python排序列表数组方法–通过示例解释升序和降序-程序员宅基地

- jenkins 构建前执行shell_Jenkins – 在构建之前执行脚本,然后让用户确认构建-程序员宅基地

- 如何完全卸载MySQL_mysql怎么卸载干净-程序员宅基地

- AndroidO Treble架构下HIDL服务查询过程_found dead hwbinder service-程序员宅基地