通常我们在训练模型时可以使用很多不同的框架,比如有的同学喜欢用 Pytorch,有的同学喜欢使用 TensorFLow,也有的喜欢 MXNet,以及深度学习最开始流行的 Caffe等等,这样不同的训练框架就...

”onnxruntime“ 的搜索结果

链接:https://pan.baidu.com/s/1I56s655XpYu2kf9nOazGvQ?

使用ONNXRuntime部署YOLOv5:高效、灵活的实时对象检测框架 项目地址:https://gitcode.com/iwanggp/yolov5_onnxruntime_deploy 本文将介绍一个基于YOLOv5和ONNXRuntime的项目,该项目旨在实现高效的模型部署,为...

首先安装gpu 版本的onnx 包。

使用C++部署FastSAM模型

基于yolov5检测onnxruntime c++ 完整源码+数据(课程设计).zip 已获导师指导并通过的97分的高分课程设计项目,可作为课程设计和期末大作业,下载即用无需修改,项目完整确保可以运行。 基于yolov5检测onnxruntime...

有可能是你转换的是gpu但是推理是cpu,因此卸载cpu版本,重新安装gpu版本。onnx 模型不匹配。

在 conda 环境中安装,不依赖于 本地主机 上已安装的 ...如果需要其他的版本, 可以根据 onnxruntime-gpu, cuda, cudnn 三者对应关系自行组合测试。下面,从创建conda环境,到实现在GPU上加速onnx模型推理进行举例。

【代码】ONNXRuntime。

基于ONNXRuntime部署PP-YOLOE行人检测+HRNet人体骨骼关键点检测源码+模型.zip 含c++版本和python版本 基于ONNXRuntime部署PP-YOLOE行人检测+HRNet人体骨骼关键点检测源码+模型.zip 含c++版本和python版本 基于ONNX...

编译提示onnxruntime_gpu要求numpy>=1.16.6,然后重新安装执行安装onnxruntime_gpu的命令。编译numpy报错误提示,需要安装有cython。再次安装numpy,会进入漫长的编译等待过程。jetpack系统原来运行过的命令。安装pip...

探索YoloV5-Lite on ONNXRuntime: 实时高效目标检测的新里程 项目地址:https://gitcode.com/hpc203/yolov5-lite-onnxruntime 本文将带您深入了解一个开源项目——YoloV5-Lite on ONNXRuntime,这是一个基于轻量级...

在import onnxruntime 之前 import torch。安装[onnxruntime-gpu]已经安装了cuda依然报错。

onnxruntime 配置方式 这里写自定义目录标题 一、下载onnx库文件 二、用visual studio 2019 解析nupkg包 三、用vs2019中的cmake来配置ONNXRunTime 一直以来都是用的linux系统,突然面对windows有点不知所措,这里...

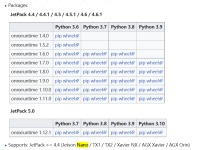

如果需要其他的版本, 可以根据 onnxruntime-gpu, cuda, cudnn 三者对应关系自行组合测试。想要 onnx 模型在 GPU 上加速推理,需要安装 onnxruntime-gpu。onnx 模型在 CPU 上进行推理,在conda环境中直接使用pip安装...

【代码】【环境搭建:onnx模型部署】onnxruntime-gpu安装与测试(python)(1)

import onnxruntime as ort import torch import time import cv2 import numpy as np def time_sync(): if torch.cuda.is_available(): torch.cuda.synchronize() return time.time() ort_session = ort....

把 DataLoader 中 num_workers 设置成 0 就好了。

onnxruntime-gpu版本可以说是一个非常简单易用的框架,因为通常用pytorch训练的模型,在部署时,会首先转换成onnx,而onnxruntime和onnx又是有着同一个爸爸,无疑,在op的支持上肯定是最好的。通常在安装onnxruntime...

onnxruntime推理

1、临时更改源 pip install -i https://pypi.tuna.tsinghua.edu.cn/simple onnxruntime 如果是默认的源位置会很慢,更改以下为好 2、测试 cmd下键入python python>... onnxruntime.get_available_pro

YDOOK:onnxruntime 加载和运行模型 InferenceSession

【代码】onnxruntime (C++/CUDA) 编译安装。

Onnxruntime c接口说明及动态调用示例 背景: 需要onnx模型推理的功能,直接引用onnxruntime代码会引起编译问题。所以考虑动态加载onnxruntime的动态库完成。C++的接口依然需要源码依赖,所以考虑使用onnxruntime...

Pyinstaller打包exe后,执行时onnxruntime包报警告(Init provider bridge failed)

OnnxRuntime 性能调优 - luoganttcc - 博客园 (cnblogs.com)

onnxruntime技术文档

标签: onnx

onnxruntime技术文档

推荐文章

- RerderTexture 在手机上变黑 在电脑上正常显示_unity2019 renderfeature 手机上显示图片是黑色的-程序员宅基地

- js 实现一个图片浮动的效果_js设置图片浮动效果-程序员宅基地

- selenium 之 控制打开的浏览器_selenium指定浏览器路径-程序员宅基地

- 计算机专业数学建模结课论文,数学建模结课论文3000字论文-程序员宅基地

- PHP中Traits详解及如何利用Traits实现代码重用_php traits 静态属性重复怎么解决-程序员宅基地

- Angular 项目中导入 styles 文件到 Component 中的一些技巧_angular standalone component-程序员宅基地

- 关于无线由器限速的问题-程序员宅基地

- Android串口调试工具ComAssistant下载_anzhuochuankougongju-程序员宅基地

- apache的GenericObjectPool对象池使用经历!-程序员宅基地

- Android paypal支付 集成 Manifest merger failed with multiple errors, see logs_android 集成支付宝支付manifest merger failed with multipl-程序员宅基地