今天转换了一个pytorch模型到onnx模型。然后想要测试一下onnx模型是不是可以正常使用。 然后就发现自己几乎没有接触过onnx推理的python代码。 所以就整理了一下,还是参考了一下自己之前的博客onnx模型转换及推理 ...

”onnxruntime“ 的搜索结果

进入...然后pip install onnxruntime******.whl下载就可以。然后pip install onnxruntime******.whl下载就可以。找到python以及系统对应的wheel并下载,传到树莓派里。

由于上篇系统自带python为3.11的而且树莓派2023年10月初刚更新了12的系统,所以各种安装都会出现版本不兼容问题。现找到旧版本11 bullseye,自带python为3.9.2的镜像进行烧录安装。安装成功过后,进入python,输入 ...

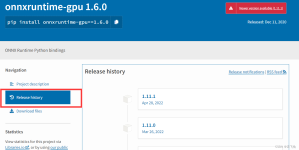

【代码】[onnxrumtime]onnxruntime和cuda对应关系表。

# onnxruntime-gpu与CUDA版本对应关系 # https://onnxruntime.ai/docs/execution-providers/CUDA-ExecutionProvider.html # cuda10.1 cudnn7.6.5 onnxruntime-gpu-1.4.0 # onnx现有算子对应的OpSet Version # ...

1. c++使用onnxruntime进行推理 link code in git #include <opencv2/core.hpp> #include <opencv2/imgcodecs.hpp> #include <opencv2/opencv.hpp> #include <opencv2/highgui.hpp> #...

最近某些项目因为显存不够,onnxruntime推理时切换CPU/GPU,实现某些模型在CPU上推理,某些在GPU上推理。查了一些别人的文章发现很多人都说onnxruntime推理没法像pytorch那样指定GPU,CPU,只能卸载一个GPU用CPU,卸载...

最近因业务需要需要使用yolo模型来做目标检测的任务,翻了网上的各种博客没有比较完整的教程,在部署过程踩了不少坑,特别是在装英伟达驱动和cuda\cudnn版本时,甚至把ubuntu系统搞坏。于是想把训练及部署过程记录...

进行这一步之前,请确保已正确安装配置了Visual Studio 2017 和 C#开发环境。项目的代码也可以在找到,下面的步骤是带着大家从头到尾做一遍。

转换之后运行onnx文件就报错: 解决:最好把h5模型重新加载一下,保存save_model文件: 转pb: 转onnx的时候使用的是save_model格式:

onnxruntime对bfloat16的支持

cpu选择onnxruntime或者dnn都可以,建议选择ort.gpu选择tensorrt,如果有兼容需求就只能选择onnxruntime了.不得不说,gpu推理上TRT把ORT薄纱了,不需要warm-up,对工业生产环境非常友好,因为在实际生产环境中,都不是实时...

pip install onnxruntime_gpu-1.8.0-cp36-cp36m-linux_aarch64.whl 然后import一下看看是否调用的GPU: import onnxruntime onnxruntime.get_device() onnxruntime.get_available_providers() .

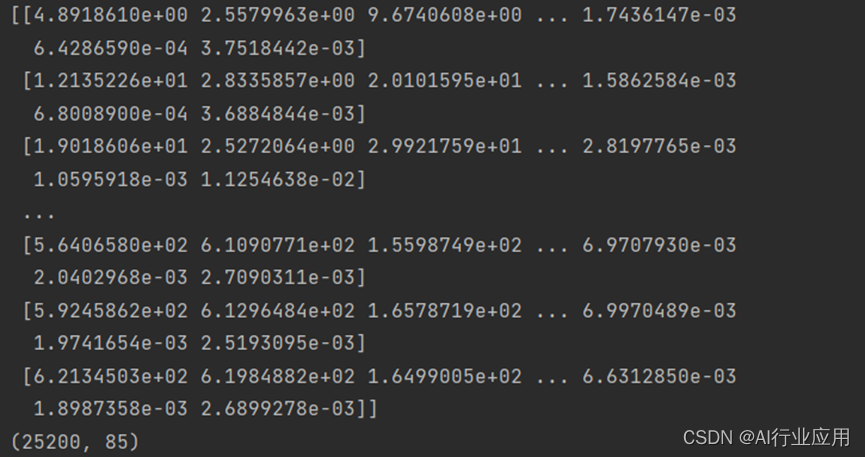

ONNX 模型的运行

分别使用OpenCV与ONNXRuntime部署yolov5旋转目标检测源码+模型(c++和python两个版本程序).zip 已获导师指导并通过的97分的高分期末大作业设计项目,可作为课程设计和期末大作业,下载即用无需修改,项目完整确保可以...

python库,解压后可用。 资源全名:onnxruntime-1.0.0-cp35-cp35m-manylinux1_x86_64.whl

up 在锈中使用onnxruntime的超分辨率使用

推荐文章

- 大数据技术未来发展前景及趋势分析_大数据技术的发展方向-程序员宅基地

- Abaqus学习-初识Abaqus(悬臂梁)_abaqus悬臂梁-程序员宅基地

- 数据预处理--数据格式csv、arff等之间的转换_csv转arff文件-程序员宅基地

- c语言发送网络请求,如何使用C+发出HTTP请求?-程序员宅基地

- ccc计算机比赛如何报名,整理:加拿大的CCC是什么,怎么报名?-程序员宅基地

- RK3568 学习笔记 : ubuntu 20.04 下 Linux-SDK 镜像烧写_rk3568刷linux-程序员宅基地

- Gradle是什么_gradle是干嘛的-程序员宅基地

- adb命令集锦-程序员宅基地

- 【Java基础学习打卡15】分隔符、标识符与关键字_java分隔符有哪三种-程序员宅基地

- Python批量改变图片名字_python批量修改图片名称-程序员宅基地