这里写目录标题实验目的遇到的问题解决方法 实验目的 简单进行一个4*4 tensor经过卷积生成[4 , 2, 2]的tensor... self.conv1 = nn.Conv2d(1, 4, kernel_size = 3, stride=1) def forword(self, x): print(x.type())

”nn.Conv2d卷积异常“ 的搜索结果

Tensorflow用tf.nn.conv2D()实现空洞卷积,具体代码如下: out_tensor = tf.nn.conv2d( in_place, filter=filter_tensor, strides=(1, 1, 1, 1), padding=‘SAME’, dilations=(1, dilation_rate, dilation_rate, 1)...

反卷积操作: 首先对需要进行维度扩张的feature_map 进行补零操作,然后使用3*3的卷积核,进行卷积操作,使得其维度进行扩张,图中可以看出,2*2的feature经过卷积变成了4*4. 3*3的卷积经过扩张以后形成了5*5 ...

今天小编就为大家分享一篇TensorFlow tf.nn.conv2d实现卷积的方式,具有很好的参考价值,希望对大家有所帮助。一起跟随小编过来看看吧

pytorch之卷积神经网络nn.conv2d 卷积网络最基本的是卷积层,使用使用Pytorch中的nn.Conv2d类来实现二维卷积层,主要关注以下几个构造函数参数: nn.Conv2d(self, in_channels, out_channels, kernel_size, stride, ...

torch 包 nn 中 Conv2d 的用法与 tensorflow 中类似,但不完全一样。 在 torch 中,Conv2d 有几个基本的参数,分别是 in_channels 输入图像的深度 out_channels 输出图像的深度 kernel_size 卷积核大小,正方形卷积...

今天在看文档的时候,发现pytorch 的conv操作不是很...classtorch.nn.Conv2d(in_channels, out_channels, kernel_size, stride=1, padding=0, dilation=1, groups=1, bias=True)[source] Parameters: in_channels (int

一、nn.Conv2d nn.Conv2d(self, in_channels, out_channels, kernel_size, stride=1, padding=0, dilation=1, groups=1, bias=True)) 参数: in_channel:输入数据的通道数,例RGB图片通道数为3; out_channel: 输.....

conv1=nn.Conv2d(1,2,kernel_size=3,padding=1) conv2=nn.Conv2d(1,2,kernel_size=3) inputs=torch.Tensor([[[[1,2,3], [4,5,6], [7,8,9]]]]) print("input size: ",inputs.shape) outputs1=conv1(inputs) print(...

nn.Conv1d作用在第二个维度位置channel,nn.Linear作用在第三个维度位置in_features,对于一个XXX,若要在两者之间进行等价计算,需要进行tensor.permute,重新排列维度轴秩序。length],3维tensor,而nn.Linear输入...

主要介绍了TensorFlow tf.nn.conv2d_transpose是怎样实现反卷积的,文中通过示例代码介绍的非常详细,对大家的学习或者工作具有一定的参考学习价值,需要的朋友们下面随着小编来一起学习学习吧

卷积pytorch代码实现,使用torch.nn.functional.conv2d

Pytorch的nn.Conv2d()详解nn.Conv2d()的使用、形参与隐藏的权重参数in_channelsout_channelskernel_sizestride = 1padding = 0dilation = 1groups = 1bias = Truepadding_mode = 'zeros' nn.Conv2d()的使用、形参...

这里写目录标题一、nn.Sequential二、nn.Conv2d 一、nn.Sequential torch.nn.Sequential是一个Sequential容器,模块将按照构造函数中传递的顺序添加到模块中。另外,也可以传入一个有序模块。 为了更容易理解,官方...

一、nn.Conv1d 一维的卷积能处理多维数据 nn.Conv1d(self, in_channels, out_channels, kernel_size, stride=1, padding=0, dilation=1, groups=1, bias=True)) 参数: in_channel: 输入数据的通道数,例RGB...

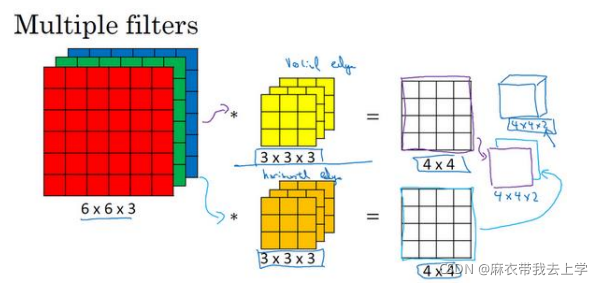

2D卷积很适合处理图像输入。以之前的MNIST为例,在使用MLP时,为方便全连接层的处理,将28乘28的输入flatten成了784维的向量,这样就要有784个权值。而使用了2D卷积以后,假设使用3乘3的卷积核,那么每次的输入都是...

本文主要介绍PyTorch中的nn.Conv1d和nn.Conv2d方法,并给出相应代码示例,加深理解。 一维卷积nn.Conv1d 一般来说,一维卷积nn.Conv1d用于文本数据,只对宽度进行卷积,对高度不卷积。通常,输入大小为word_...

四,nn.conv2d 1, 函数定义 2, 参数: 3, 代码 4, 分析计算过程在开始前,要使用pytorch实现以下内容,需要掌握tensor和的用法卷积层是用一个固定大小的矩形区去席卷原始数据,将原始数据分成一个个和卷积核大小相同...

nn.Conv2d(self, in_channels, out_channels, kernel_size, stride=1, padding=0, dilation=1, groups=1, bias=True)) 参数: in_channel: 输入数据的通道数,例RGB图片通道数为3; out_channel: 输出数据...

正如我们知道的这些看似相同的卷积、激活、池化等操作,分别在不同的包下面—— torch.nn.xxx 和 torch.nn.functional.xxx包,那么他的作用和完成的方式以及调用的方式当然也不一样。 首先我们来看一下pytorch中文...

推荐文章

- Android 编译so文件 MP4V2_android下编译mp4v2-程序员宅基地

- 通讯录Contact_02_contact文件内容-程序员宅基地

- Qt笔记(四十二)之QZXing的编译 配置 使用_qzxingfilterrunnable error:-程序员宅基地

- 关于画图软件Dia打开程序始终为英文界面的问题-程序员宅基地

- OpenCV从入门到精通实战(二)——文档OCR识别(tesseract)-程序员宅基地

- 详解avcodec_receive_packet 11_avcodec_receive_packet eagain-程序员宅基地

- OpenGL SuperBible 7th源码编译记录_superbible7-media github-程序员宅基地

- Wireshark简单使用-程序员宅基地

- MXNet 粗糙的使用指南_iou loss mxnet-程序员宅基地

- iOS对ipa包进行代码混淆《二》 ---代码混淆_ipa包混淆-程序员宅基地