”ncnn“ 的搜索结果

它支持训练和推理,并通过TensorRT(NVidia GPU)和NCNN(ARM CPU)自动转换为嵌入式平台。 它实现了对图像,文本,时间序列和其他数据的有监督和无监督深度学习的支持,重点是简单性和易用性,测试以及与现有应用...

ncnn数据加载,主要有两个函数,分别为Net::load_model(),Net::load_param(),这两个函数在net.cpp里面定义了,对于数据读取,最终是调用了,datareader.cpp实现的方法,因为在加载模型数据时,是先通过.param文件来...

基于ncnn的yolov5部署实现调用摄像头完成目标检测源码(带模型文件+编译方法).zip基于ncnn的yolov5部署实现调用摄像头完成目标检测源码(带模型文件+编译方法).zip基于ncnn的yolov5部署实现调用摄像头完成目标检测源码...

基于ncnn的CodeFormer人脸复原模型源码(含转换后的bin文件)+使用说明.zip基于ncnn的CodeFormer人脸复原模型源码(含转换后的bin文件)+使用说明.zip基于ncnn的CodeFormer人脸复原模型源码(含转换后的bin文件)+使用说明...

yolov5s v6.2训练的pt模型,直接导tourchscript,然后时候ncnn里面的pnnx工具直接转换为ncnn。1.安装vunlkan 1.2.198.1版本,记得配置环境变量。2.安装Protobuf3.20.0版本。该内容还未完整,笔记内容,后期补充。

YOLOv8-pose在ncnn框架下部署过程记录(包含ncnn、pnnx安装以及模型结构更改及转换)

基于ncnn实现的yolov5移植部署安卓手机源码+转换后的模型(bin+param).zip基于ncnn实现的yolov5移植部署安卓手机源码+转换后的模型(bin+param).zip基于ncnn实现的yolov5移植部署安卓手机源码+转换后的模型(bin+param)...

注: 为你刚刚解压的protobuf-3.4.0文件夹的根目录,如果cd无法切换进入到D盘,需要在cd命令与D:\命令之间加入一个 "/d" 就解决了,如:"cd /d D:\build_tools\protobuf-3.4.0"这里我直接下载编译好的 opencv-mobile...

ncnn 是一个为手机端极致优化的高性能神经网络前向计算框架。ncnn 从设计之初深刻考虑手机端的部署和使用。无第三方依赖,跨平台,手机端 cpu 的速度快于目前所有已知的开源框架。基于 ncnn,开发者能够将深度学习...

本文记录ncnn神经网络前向计算框架(ncnn项目地址)加速效果的验证过程,进一步探究ncnn加速原理并学习利用ncnn框架自定义推理加速。流程使用pytorch实现的人脸识别网络参考代码地址)和对应预训练权重生成onnx格式中间...

基于NCNN、PNNX 部署YOLOv7完整源码+训练模型+数据(课程设计).zip 已获导师指导并通过的97分的高分课程设计项目,可作为课程设计和期末大作业,下载即用无需修改,项目完整确保可以运行。 基于NCNN、PNNX 部署...

yolo-fastest-ncnn 物体检测,火炬

一键编译NCNN的IOS库,能够同时支持x86_64/i386(iPhoneSimulator)和 armv7/arm64(iPhoneOS)。直接打包生成framework。 在最新NCNN源码测试通过。

darknet2ncnn将darknet 模型转换为ncnn模型,实现darknet网络模型在移动端的快速部署。除 local/xor conv, rnn, lstm, gru, crnn及iseg外,均提供支持。自定义添加了所有ncnn不直接支持的activation操作,实现位于层...

onnx2ncnn yolov7-0322.onnx yolov7.param yolov7.bin 优化模型 ncnnoptimize yolov7.param yolov7.bin yolov7_fp16.param yolov7_fp16.bin 65536

YOLOv5的Android部署,基于NCNN - 部署 tags: - yolov5 - Android - ncnn --- ## NCNN是什么 `ncnn` 是腾讯公司开源的一个专为手机端极致优化的高性能神经网络前向计算框架。`ncnn` 从设计之初,就深刻考虑手机端...

如果我们想在手机端运行我们的深度学习模型需要...本文介绍了端侧深度学习模型部署流程(NCNN),在了解基本概念之后可以尝试运行NCNN官方demo实例,并根据自己需求进行改进,这样就可以在自己的手机上部署深度学习模型啦~

Picodet Ncnn

修改ncnn\tools目录下的CMakeLists.txt文件 add_subdirectory(caffe) add_subdirectory(mxnet) add_subdirectory(onnx) # add_subdirectory(quantize) 为 add_subdirectory(caffe) add_subdirectory(mxnet) add_...

该博客主要是在基于树莓派在ncnn的框架上进行部署尝试,主要使用resnet18的网络来进行部署,不过没有使用到vulkan加速优化

ncnn 的仿射变换对于深度学习的预处理即小图变换进行了优化,速度可达到 OpenCV 的两倍。详细请参考 [opencv ncnn warpaffine 性能测试](https://zhuanlan.zhihu.com/p/355147243)。在具体实现方面,优点是简洁明快...

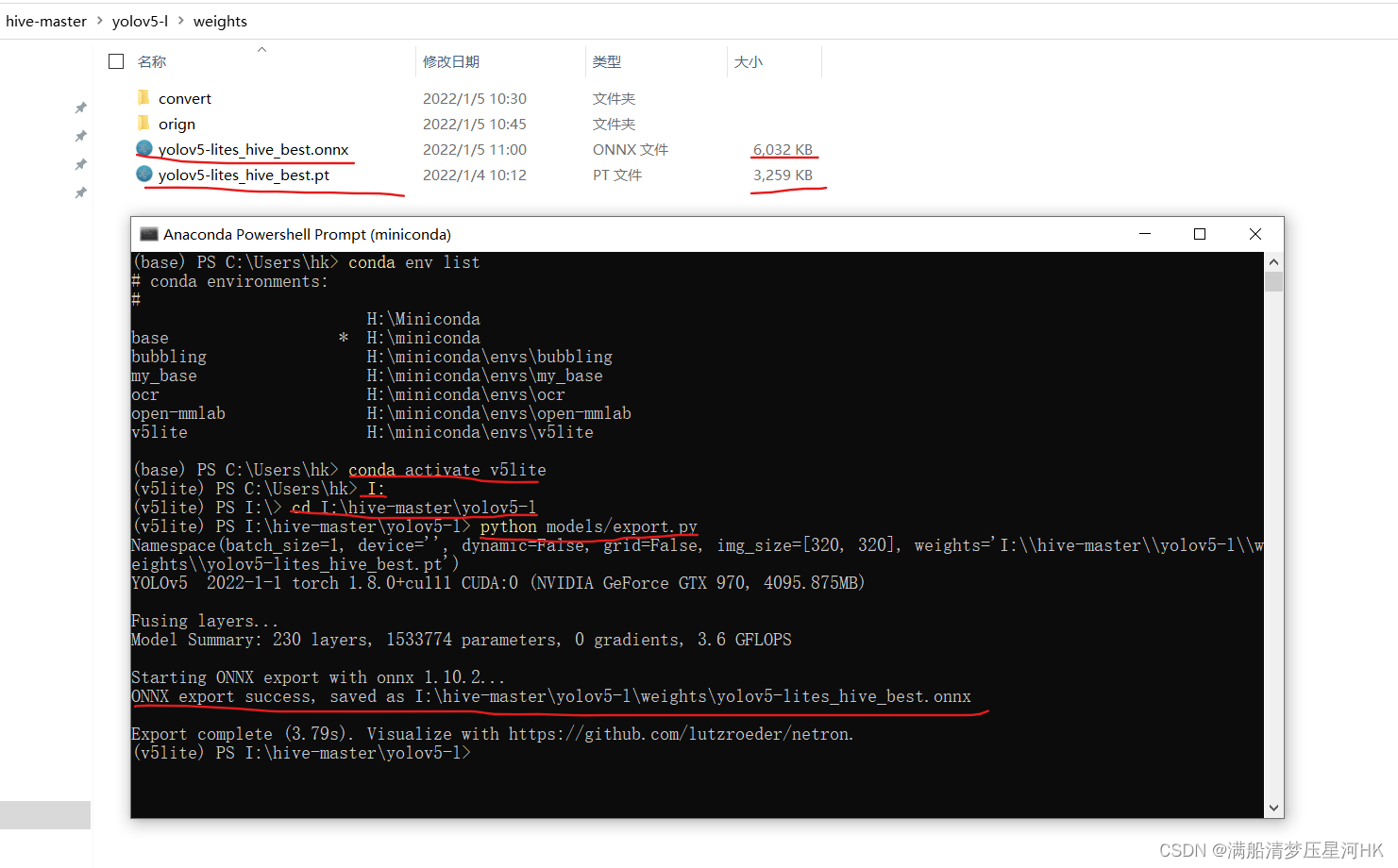

最近在玩树莓派,想在树莓派上不是一个目标检测算法,大致看了一下,目前开源的大家都在使用yolov5-Lite,使用ncnn去推理加速,于是自己也尝试部署,在此记录一下,个人踩的坑。

路径:src/Option.h 和 src/Option.cpp, src/paramdict.h 和 src/paramdict.cppOption是一个简单的配置类,Paramdic是网络层的配置参数,不同层有不同配置参数。

主要介绍了基于Android studio3.6的JNI教程之ncnn之语义分割ENet的相关知识,本文通过实例代码给大家介绍的非常详细,对大家的学习或工作具有一定的参考借鉴价值 ,需要的朋友可以参考下

使用NCNN对paddle ocr v4进行推理,多平台兼容,可使用GPU。

推荐文章

- 机器学习之超参数优化 - 网格优化方法(随机网格搜索)_网格搜索参数优化-程序员宅基地

- Lumina网络进入SDN市场-程序员宅基地

- python引用传递的区别_php传值引用的区别-程序员宅基地

- 《TCP/IP详解 卷2》 笔记: 简介_tcpip详解卷二有必要看吗-程序员宅基地

- 饺子播放器Jzvd使用过程中遇到的问题汇总-程序员宅基地

- python- flask current_app详解,与 current_app._get_current_object()的区别以及异步发送邮件实例-程序员宅基地

- 堪比ps的mac修图软件 Pixelmator Pro 2.0.6中文版 支持Silicon M1_pixelmator堆栈-程序员宅基地

- 「USACO2015」 最大流 - 树上差分_usaco 差分-程序员宅基地

- Leetcode #315: 计算右侧小于当前元素的个数_找元素右边比他小的数字-程序员宅基地

- HTTP图解读书笔记(第六章 HTTP首部)响应首部字段_web响应的首部内容-程序员宅基地