”jieba库“ 的搜索结果

jieba库的基本使用

标签: ie jieba

import jieba # 朱自清散文节选 text = '人生就是一种承受,一种压力,让我们在负重中前行,在逼迫中奋进。无论走到哪里,我们都要学会支撑自己,没有人陪你走一辈子,所以你要适应孤独,没有人会帮你一辈子,所以你...

使用jieba库,你可以轻松地进行中文文本的分词处理,并在自然语言处理、文本挖掘、信息检索等领域中应用它的功能。你可以通过安装jieba库并查阅官方文档来详细了解和使用其提供的功能和方法。PyCharm会连接到Python...

jieba库,为没有装对位置的朋友们提供 jieba库,为没有装对位置的朋友们提供 jieba库,为没有装对位置的朋友们提供 jieba库,为没有装对位置的朋友们提供 jieba库,为没有装对位置的朋友们提供 jieba库,为没有装对...

《Python 高级编程》课程信息化教学设计初探——以“Jieba 库应用”课程单元为例.pdf

NLP: 利用jieba库,基于TF-IDF算法的文本关键词提取

python-jieba库

标签: python

python-jieba库 -jieba介绍 jieba是优秀的中文分词第三方库,需要额外安装 中文文本需要通过分词获得单个的词语 jieba提供三种分词模式 -jieba库安装 pip install jieba 指令,在命令行,要求计算机联网 -jieba分词...

Python的jieba库是一个中文分词工具,它可以将一段中文文本分割成一个一个的词语,方便后续的自然语言处理任务,如文本分类、情感分析等。jieba库使用了基于前缀词典的分词方法,能够处理中文的各种复杂情况,如歧义...

1、jieba库基本介绍 (1)、jieba库概述 jieba是优秀的中文分词第三方库 – 中文文本需要通过分词获得单个的词语 – jieba是优秀的中文分词第三方库,需要额外安装 – jieba库提供三种分词模式,最简单只需掌握一...

jieba库如何正常使用

标签: python

知识点不全,是自用存档~

环境: Python3.6 + windows10 jieba介绍以及分词的原理 1. jieba 是Python中的优秀的中文分词第三方库 --中文文本需要通过分词获得...3.jieba库的安装 只需要在cmd 中, pip install jieba 4.. jieba分......

中文文本需要通过分词获得单个的词语 jieba是优秀的中文分词第三方库,需要额外安装 在(cmd命令行)情况下 运行 pip install jieba 进行安装 ...jieba库常用函数 函数 描述 jieba.lcut(s) 精确模式,返回一个列

我们在看视频学习的时候,不能光动眼动脑不动手,比较科学的学习方法是在理解之后运用它们,这时候练手项目就很适合了,只是里面的项目比较多,水平也是参差不齐,大家可以挑自己能做的项目去练练。...

pycharm安装jieba库

本文实例讲述了Python基于jieba库进行简单分词及词云功能实现方法。分享给大家供大家参考,具体如下: 目标: 1.导入一个文本文件 2.使用jieba对文本进行分词 3.使用wordcloud包绘制词云 环境: Python 3.6.0 |...

jieba库 安装 pip install jieba 我安装时出现了这个警告: You should consider upgrading via the ‘pip install --upgrade pip’ command. 说明pip版本较低,需要升级 敲入 python -m pip install --upgrade pip...

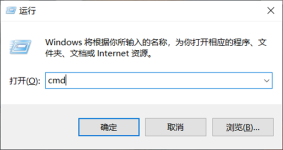

下载jieba,将其解压到指定目录,我这里为了演示方便解压到python的安装目录,找到解压目录里面的。“调出运行窗口,并输入”CMD“点击”确定“ 打开dos运行终端界面;厂面经、学习笔记、源码讲义、实战项目、讲解视频...

下载jieba,将其解压到指定目录,我这里为了演示方便解压到python的安装目录,找到解压目录里面的。“调出运行窗口,并输入”CMD“点击”确定“ 打开dos运行终端界面;厂面经、学习笔记、源码讲义、实战项目、讲解视频...

文章目录jieba库一、 简介1、 是什么2、 安装二、 基本使用1、 三种模式2、 使用语法2.1 对词组的基本操作2.2 关键字提取2.3 词性标注2.4 返回词语在原文的起止位置 jieba库 一、 简介 1、 是什么 (1)jieba是优秀...

下载jieba,将其解压到指定目录,我这里为了演示方便解压到python的安装目录,找到解压目录里面的。大厂面经、学习笔记、源码讲义、实战项目、讲解视频,并且后续会持续更新**“调出运行窗口,并输入”CMD“点击”确定...

Python jieba库用法及实例解析1、jieba库基本介绍(1)、jieba库概述jieba是优秀的中文分词第三方库- 中文文本需要通过分词获得单个的词语- jieba是优秀的中文分词第三方库,需要额外安装- jieba库提供三种分词模式,...

使用jieba库对论文进行相似度的比较以对其进行分类。 源码为001.py,003.py,004.py三个文件,其中001.py负责将原文转为utf-8格式,用户直接运行即可,003.py可以将训练集中的论文进行分词——这一步就要用到jieba库...

Python jieba库的安装

推荐文章

- cocos creator 实现截屏截图切割转成 base64分享--facebook小游戏截图base64分享,微信小游戏截图分享【白玉无冰】每天进步一点点_cocos上传base64-程序员宅基地

- Docker_error running 'docker: compose deployment': server-程序员宅基地

- ChannelSftp下载目录下所有或指定文件、ChannelSftp获取某目录下所有文件名称、InputStream转File_channelsftp.lsentry获取文件全路径-程序员宅基地

- Hbase ERROR: Can‘t get master address from ZooKeeper; znode data == null 解决方案_error: can't get master address from zookeeper; zn-程序员宅基地

- KMP的最小循环节_kmp求最小循环节-程序员宅基地

- 详解ROI-Pooling与ROI-Align_roi pooling和roi align-程序员宅基地

- Imx6ull开发板Linux常用查看系统信息指令_armv7 processor rev 2 (v7l)-程序员宅基地

- java SSH面试资料-程序员宅基地

- ant design vue table 高度自适应_对比1万2千个Vue.js开源项目发现最实用的 TOP45!火速拿来用!...-程序员宅基地

- 程序员需要知道的缩写和专业名词-程序员宅基地