”java读parquet文件乱码“ 的搜索结果

主要介绍hive的优化功能。

)查看 .parquet格式的数据,显示乱码,这个格式如何编写就不演示了。可以跳过不符合条件的数据,只读取需要的数据,降低IO数据量。是自定义的,是标记用的,也是一个文件名,但等号是一定要有的,

原因是Hudi文件没有压缩,只能读RT,不能读RO,修改读方式: .option(DataSourceReadOptions.QUERY_TYPE_OPT_KEY(),DataSourceReadOptions.QUERY_TYPE_INCREMENTAL_OPT_VAL()) .option(DataSourceReadOptions.BEGIN_...

从HBase读取数据非常容易,本人使用的是Python,HBase python支持库happybase操作起来非常方便,主要的问题就是数据编码解码问题。编码主要使用struct.pack(),解码使用struct.unpack()。...HBase里的数据也是有可读...

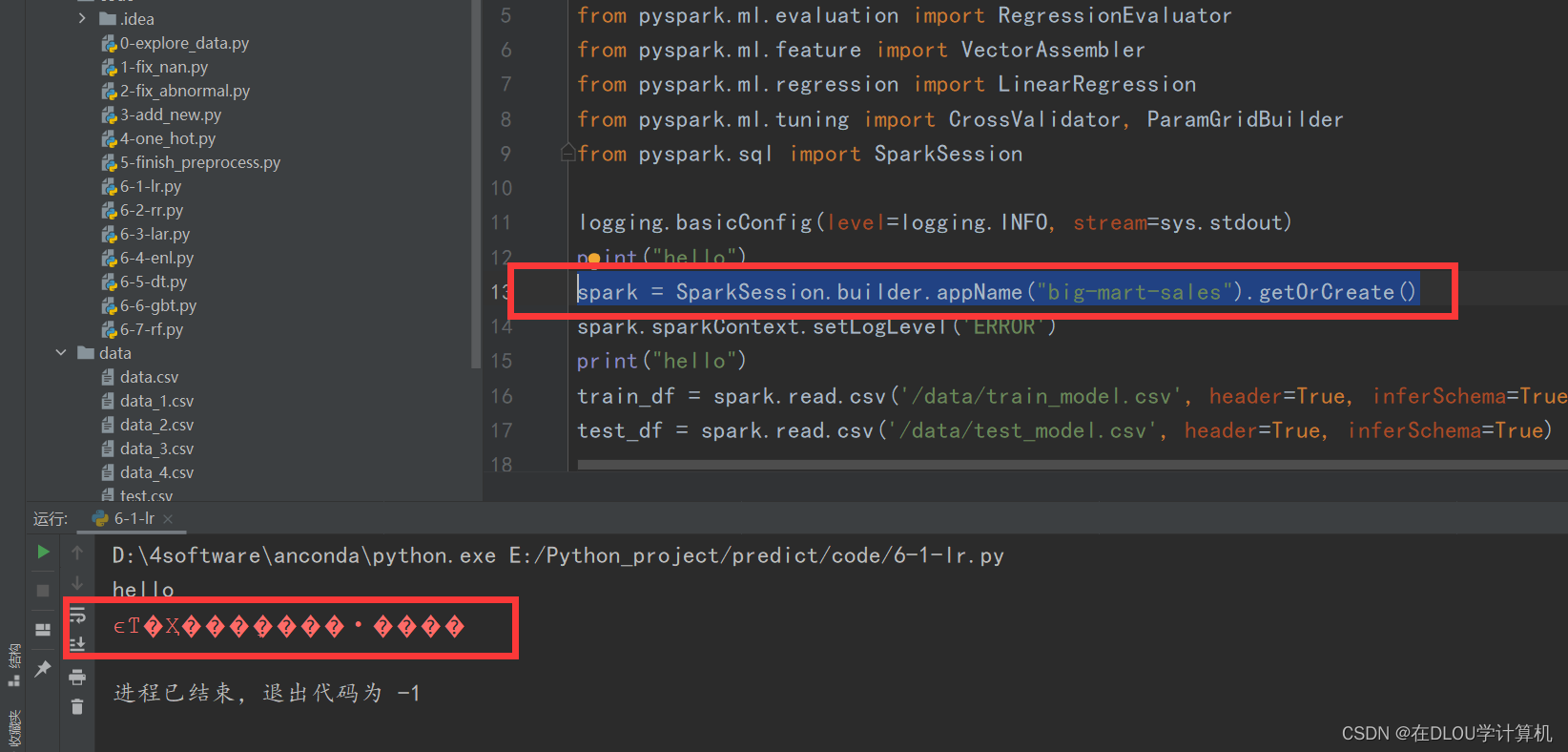

data异常

[2020-04-02 05:32:04,360] {bash_operator.py:110} INFO - Error: java.lang.RuntimeException: org.apache.hadoop.hive.ql.metadata.HiveException: Hive Runtime Error while processing row [Error getting row ...

1第一阶段—Java 核心技术 45 天 模块名 天数 知识点 JavaSE 开发环境搭建 1 计算机基础知识 Java 语言概述 JDK HelloWorld 案例 环境变量的配置 注释 Java 基础语法 1 ...

Apache Paimon 学习笔记,流式数据湖平台。

一、数据类型 1、基本数据类型 Hive 支持关系型数据中大多数基本数据类型 类型描述示例 boolean true/false TRUE tinyint 1字节的有符号整数 -128~127 1Y smallint ......

在这里记录下不同语言中文件读取的区别,这篇文章始终不会写完,我偶尔碰到一点就记录一点。 1、Python中文件操作 在输入文件路径时,注意文件名前是双斜杠,如’D:\tobacco\dataformat\orginal\’ ...

spark-sql调优

标签: spark-sql

sparksql性能调优 性能优化参数 代码实例 import java.util.List; ...import org.apache.spark.SparkConf;...import org.apache.spark.api.java....import org.apache.spark.sql.api.java.JavaSQLContext

默认情况下,load()方法和save()方法只支持Parquet格式的文件,Parquet文件是以二进制方式存储数据的,因此不可以直接读取,文件中包括该文件的实际数据和Schema信息,也可以在配置文件中通过参数spark.sql.sources....

环境篇:CM+CDH6.3.2环境搭建(全网最全) 一 环境准备 1.1 三台虚拟机准备 Master( 32g内存 + 100g硬盘 + 4cpu + 每个cpu2核) 2台Slave( 12g内存 + 100g硬盘 + 4cpu + 每个cpu1核) 参考地址: ...1、准备的机器只要网络...

Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张表,并提供类SQL查询功能。 本质是:将HQL转化成MapReduce程序 1)Hive处理的数据存储在HDFS 2)Hive分析数据底层的实现是MapReduce 3)执行程序...

hive 知识点总结

标签: hive

parquet fixed类型数据读取

之前自己对于numpy和pandas是要用的时候东学一点西一点,直到看到《利用Python进行数据分析·第2版》,觉得只看这一篇就够了。非常感谢原博主的翻译和分享。 ...

ETL工具之Kettle

标签: etl

hive架构及其安装和简单使用

标签: hive

一、hive是什么 HIve是建立在Hadoop上的数据仓库基础架构。 二、hive的概念及架构 1、概念 它提供了一系列的工具,可以用来进行数据提取转化加载(ETL ),这是一种可以存储、查询和分析存储在 Hadoop 中的大...

/ ----------------------- 开始自定义逻辑,基于Spark代码--------------------------------// ----------------------- 结束自定义逻辑,使用Glue代码--------------------------------有关创建自定义 XML 分类器...

推荐文章

- 偏向锁 / 轻量级锁 / 重量级锁-程序员宅基地

- 解决Mysql不能保存中文的问题_innodb 保存中文报错-程序员宅基地

- 前端面试会80%直接进大厂_会 80% 直接进大厂-程序员宅基地

- 【HNU数据库实验】实验6:存储过程_数据库实验六存储过程-程序员宅基地

- 苹果采集插件全套教程-苹果cmsV10采集插件_苹果cms采集插件-程序员宅基地

- win7下安装VC6LineNumberAddin方法[VC6行号插件]_vc6linenumberaddin.exe-程序员宅基地

- UE4 升级vs版本导致打开工程报的c++错误_error c4800: 从“gamestore *”到 bool 的隐式转换。信息可能丢失-程序员宅基地

- 2023年华为HCIE-Datacom认证(H12-891、H12-892)_网络调优计算即选择合适的调优目的,应用相应的算法,全局或局部地计算优化路径。控-程序员宅基地

- 2023春招CSS面试题(更新中...)_css面试题2023-程序员宅基地

- Python对应Opencv的重要常用函数如:cv2.rectangle()等-程序员宅基地