#include <vtkVersion.h> #include <vtkSmartPointer.h> #include <vtkActor.h> #include <vtkSphereSource.h> #include <vtkRendererCollection.h> #include <vtkCellArr

”actor“ 的搜索结果

Akka Actor模型开发库 v2.9.1.zip

Actor IM即时通讯平台 v3.0.0.zip

vtk中鼠标拖动actor在render中移动

“并发是一种解耦策略” —— Robert C.Martin何为Actor模式呢?在计算机科学中,参与者模式(Actor model)是一种并发运算上的模型。“参与者”是一种程序上的抽象概念,被视为并发运算的基本单元:当一个参与者接收...

Actor模型简介 1.1 什么是Actor模型? 1.2 Actor模型与传统并发模型的区别 1.3 Actor模型在并发编程中的优势 在第一章节中,我们将深入介绍Actor模型,包括其基本概念、与传统并发模型的不同之处以及在并发编程...

初始化演员(Actor)、目标演员、评论家(Critic)、目标评论家、策略(Policy)和目标策略网络的神经网络参数,然后设置其他算法参数,如学习率、目标熵、折扣因子等。如果策略的熵低于目标熵,增加目标熵的值,以...

批准actor-crawler,为transfermarkt.com网站提供API。 该参与者可以从transfermarkt.com页面提取数据。 它最适合比赛页面,俱乐部页面或球员页面,但也能够从大多数(如果不是全部)其他页面类型中提取一些数据。 ...

展示了两个示例:在其中一个示例中,使用蓝图告知Actor播放动画,在另外一个示例中,展示了告知Actor播放动画的动画蓝图(例如,此示例展示了如何将变量从蓝图传递给动画蓝图,并演示了如何将现有姿势混合到新动画中...

A3C(Asynchronous Advantage Actor-Critic)算法是一种用于训练深度强化学习模型的并行化算法,它是Actor-Critic(演员-评论家)算法的一种变体,旨在充分利用多核CPU和分布式计算资源以加速强化学习的训练。...

npm install anode演员anode背后的意图是提供一种在 JavaScript 中编写“纯”actor 的方法。 多年来,演员是什么的想法已经发生了很大的变化。 在什么情况下anode试图提供“纯粹”的演员都是通过定义演员和阐述。 ...

其实无论是使用数据库锁 还是多线程,这里有一个共同思路,就是将数据喂给线程,就如同计算机是一套加工流水线,数据作为原材料投入这个流水线的开始,流水线出来后就是成品,这套模式的前提是数据是被动的,自身不...

上一篇文章介绍过vtkInteractorStyleTrackballCamera的使用,可以通过重写vtkInteractorStyleTrackballCamera类,重写鼠标坐及左键按下事件void OnLeftButtonDown() override来获取选中的演员actor。如果想在渲染器...

CSP & Actor Model 本文将简单介绍CSP和Actor模型俩流行的并发机制,并比较他们的优缺点,并通过Golang中CSP并发机制实现FutureTask.并行机制有很多像是多线程,CSP,Actor等等.拿多线程来说,就有诸多问题,譬如:死锁,可...

ingrates是一个基于的actor系统。 我提供了一个非常小的API表面积,并试图保持相对独立。 ingrates大量借鉴了,但使用普通的字符串作为地址。 这样可以更轻松地在角色/线程/进程/设备之间分解actor系统,并在它们...

Qπ(st,a1)表示的就是在当前状态下执行动作a1的价值,就是幕1中st到终止状态的奖励的期望值。Vπ(st)就是Qπ(st,a1),Qπ(st,a2),Qπ(st,a3)这3个对于动作a的一个期望。一旦神经网络训练完成,我们只要输入一个...

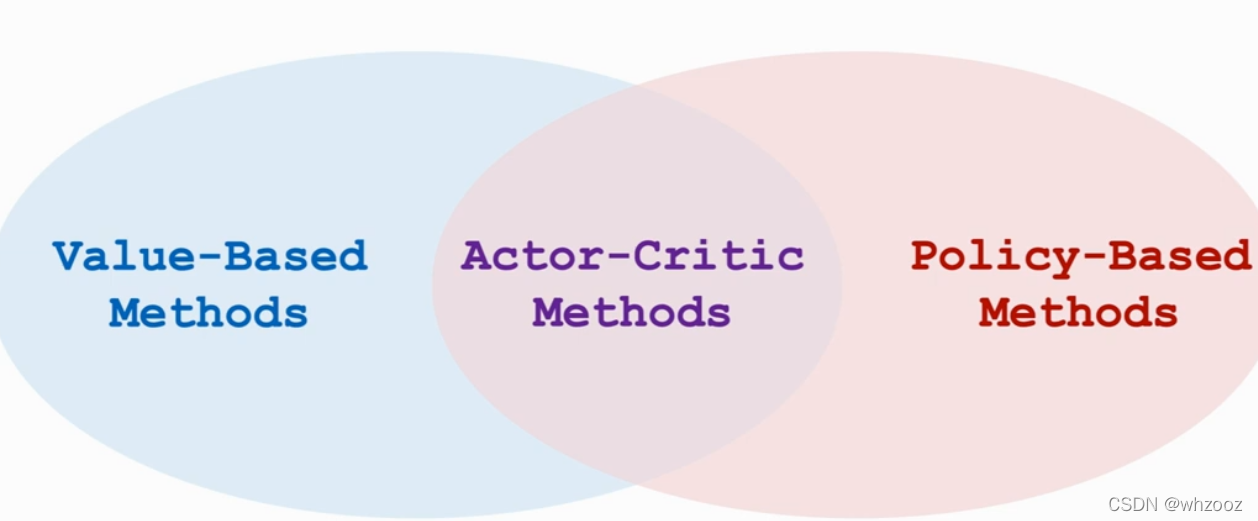

本博客代码部分参考了基于值函数的方法(DQN)和基于策略的方法(REINFORCE),其中基于值函数的方法只学习一个价值...Actor-Critic 是囊括一系列算法的整体架构,目前很多高效的前沿算法都属于 Actor-Critic 算法。

本篇文章我们来介绍一下Actor-Critic 方法。 一、Actor-Critic 方法 1.构造价值网络和策略网络 Actor是策略网络,用来控制agent运动;Critic是价值网络,用来给动作打分;Actor-critic方法把策略学习和价值学习结合...

generate_aktor 生成Rust actor的宏derive_aktor导出一个derive_actor宏。 该宏可以采用结构的隐式函数,并为其生成一个actor,其中该actor具有与该impl大致相同的名义上的类型化API。 这使得编写类型化的,名义上的...

Actor-Critic方法

标签: 深度学习

0x00 Actor出现的背景 0x01 Actor如何通过消息传递避免数据竞争? 0x02 Actor到底是什么? 0x03 Actor特性 0x031 容错 0x032 分布式与位置透明性 0x04 Actor使用场景 0x05 缺点 0x051弱隔离性 0x052其他...

一、Actor-Critic 介绍 1、引入 Actor-Critic 我们还是从上篇强化学习——REINFORCE Algorithm推导出的目标函数的梯度说起: ∇θJ(θ)=Eπθ[∑t=0T−1Gt⋅∇θ log πθ(at∣st)] \nabla_\theta J(\theta) =...

什么是Actor? Actor对于PHPer来说,可能会比较陌生,写过Java的同学会比较熟悉,Java一直都有线程的概念(虽然PHP有Pthread,但不普及),它是一种非共享内存的并发模型,每个Actor内的数据独立存在,Actor之间通过...

pool_actor.json

达卡在 D 中使用 Vibe for RPC 的基于 Actor 的框架。特征: 本地演员参考远程节点连接,使用给定的 ip/port 远程演员调用关于启动/停止/错误支持每个节点的能力(这个节点可以做 x 吗?如果不能,哪个可以创建引用...

推荐文章

- Android RIL框架分析-程序员宅基地

- Python编程基础:第六节 math包的基础使用Math Functions_ps math function-程序员宅基地

- canal异常 Could not find first log file name in binary log index file_canal could not find first log file name in binary-程序员宅基地

- 【练习】生成10个1到20之间的不重复的随机数并降序输出-程序员宅基地

- linux系统扩展名大全,Linux系统文件扩展名学习-程序员宅基地

- WPF TabControl 滚动选项卡_wpf 使用tabcontrol如何给切换的页面增加滚动条-程序员宅基地

- Apache Jmeter常用插件下载及安装及软硬件性能指标_jmeter插件下载-程序员宅基地

- SpringBoot 2.X整合Mybatis_springboot2.1.5整合mybatis不需要配置mapper-locations-程序员宅基地

- ios刷android8.0,颤抖吧 iOS, Android 8.0正式发布!-程序员宅基地

- 【halcon】C# halcon 内存暴增_halcon 读二维码占内存-程序员宅基地