”Scrapy实战“ 的搜索结果

也可以是查询数据库的结果,但要注意数据统一性,因为scrapy是异步爬取spider爬取的结果封装到item对象中,再提交给pipeline持久化,那么当然也可以忽略item对象,传递你想要的数据格式直接到pipeline。MSIE 7.0;q=...

作业一:使用Scrapy爬虫框架,爬取网上信息并保存到文件中;分别读取爬取的数据创建ndarray、Series与DataFrame。 作业二:作业一结果的ndarray,进行数据的截取和排序操作。 作业三:作业一结果的Series,进行截取...

相信学Python爬虫的小伙伴听说过Scrapy框架,也用过Scrapy框架。今天我们边学习Scrapy框架边爬取整部小说,让大家在不知不觉的学习过程中使用Scrapy框架完成整部小说的爬取~Scrapy框架是一个基于Twisted的异步处理...

以前写过一篇文章《Python爬虫获取电子书资源实战》,以一个电子书的网站为例来实现python爬虫获取电子书资源。爬取整站的电子书资源,按目录保存到本地,并形成索引文件方便查找。这次介绍通过Scrapy爬虫框架来实现...

网络爬虫又被称为网页蜘蛛,网络机器人,在FOAF社区中间,更经常的称为网页追逐者,是按照一定的规则,自动抓取万维网信息的...这篇文章主要介绍Python爬虫框架Scrapy实战之批量抓取招聘信息,有需要的朋友可以参考下

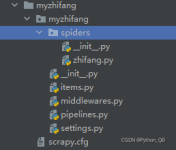

1. Scrapy项目创建 2. Scrapy Spider 基本使用 3. 数据建模 4. 管道 5. 数据持久化

Scrapy,Python开发的一个快速、高层次的屏幕抓取和web抓取框架,用于抓取web站点并从页面中提取结构化的数据。Scrapy用途广泛,可以用于数据挖掘、监测和自动化测试。Scrapy吸引人的地方在于它是一个框架,任何人都...

scrapy实战 糗事百科 创建项目 scrapy startproject qiubaiproject cd qiubai scrapy genspider qsbk Item.py # -*- coding: utf-8 -*- import scrapy class QiubaiprojectItem(scrapy.Item): #...

主要给大家介绍了利用python爬虫框架scrapy爬取京东商城的相关资料,文中给出了详细的代码介绍供大家参考学习,并在文末给出了完整的代码,需要的朋友们可以参考学习,下面来一起看看吧。

【Python高级开发课程 高级教程】课程列表01 Python语言开发要点详解.pptx02 Python数据结构.pptx03 Python函数和函数式编程....多进程开发.pptx09 Python爬虫框架Scrapy实战.pptx10 Python Web开发框架Django实战.pptx

【Python】【进阶篇】二十七、Python爬虫的Scrapy实战应用

完整版 Python高级开发课程 高级教程 09 Python爬虫框架Scrapy实战.rar

可以在Scrapy Shell中测试爬虫:使用Scrapy Shell,您可以测试和调试Web爬虫,以确保其能够正确提取所需的数据。支持调用各种Python函数和库:在Scrapy Shell中,您可以轻松调用各种Python函数和库,以进一步处理所...

通过分析页面中的一篇文章,提取文章名、文章URL、文章的点击数、文章...等待程序运行完成后,进入“D:\scrapy_project\image”目录中,会发现有一个名为full的文件夹,打开该文件夹,将看到爬取到的图片,如图所示。

Python Scrapy 什么是爬虫? 网络爬虫(英语:web crawler),也叫网络蜘蛛(spider),是一种用来自动浏览万维网的网络机器人。其目的一般为编纂网络索引。 Python 爬虫 在爬虫领域,Python几乎是霸主地位,将网络...

先看BeautifulSoup版本的 import requests from bs4 import BeautifulSoup link_head='http://finance.eastmoney.com/news/cywjh_' ...hd={'User-Agent':'Mozilla/5.0 (Windows NT 10.0; Win64; x64) App...

由于Pycharm本身是没有自带scrapy代码包的,所以正常情况是不好调试scrapy代码的,那我们想要学习scrapy,调试scrapy时,会怎么处理呢? 本节给你带来处理方法: 本节以建立爬取 http://books.toscrape.com/ ...

1、scrapy中网页的跳转 2、scrapy中items.py和settings.py pipeline等设置 3、教程链接:http://blog.csdn.net/topkipa/article/details/68486693

知乎用户信息是非常大的,本文是一个scrapy实战:怎样抓取所有知乎用户信息。 爬取的思路如下图所示: 选择一个知乎用户作为根节点 每个用户都会有关注列表 选择每一个用户的关注列表,进行递归爬取知乎用户信息 ...

从安装scrapy项目开始,一步步创建自己的spider,逐步演示如何抓取并处理数据。

继前两篇爬取拉勾网、直聘网后的第三篇文章,同样是使用scrapy来获取网站的招聘信息,并且保存至MySQL数据库,与前两篇文章有所差异,下面进入正题:猎聘网的信息也比较权威、质量,由于吸取了前两次的教训,总结了...

3.然后需要再次发送请求,第二个网址。这里会用到回调函数。5.在Pipelines中会请求,图片的url然后,保存它。2.然后,得到的里面有.exe结尾的广告。然后用 Split分割,得到最后一个,作为名字。...

Scrapy 是一个强大的开源网络爬虫框架,用于从网站上提取数据。它以可扩展性和灵活性为特点,被广泛应用于数据挖掘、信息处理和历史数据抓取等领域。官网链接(外)

Python之Scrapy爬虫学习日记(二)Scrapy实战 使用scrapy爬取阳光问政里的意见信息,并存储到MongoDB中 爬取投诉分类下的所有投诉标题以及详情,包含翻页、图片地址提取等 最后生成wordcloud词云

Scrapy实战-爬取网页英语书籍 一、下载Scrapy(若没有下载可以点击下面的链接按步骤下载),之前若下载过可以跳过此步。 博主文章官方链接:在 windows系统中安装 Scrapy详细过程 二、按照先后顺序复制下面的代码,...

推荐文章

- 卸载Linux自带的JDK并配置自己的jdk_linux 有默认jdk 和自己配置的jdk-程序员宅基地

- 关于SearchView设置字体颜色,提示字体及背景的解决方法_searchview queryhint 颜色适配-程序员宅基地

- 解决树莓派4b使用vnc远程桌面连接时遇到Cannot currently show the desktop问题_树莓派vnc连接不显示桌面-程序员宅基地

- HashMap的四种遍历方式_hashmap循环-程序员宅基地

- 12大理由告诉你选择Java不会后悔!-程序员宅基地

- 如何为微信小程序添加扫码支付和二维码收款功能-程序员宅基地

- 在centos 7内核3.10的内核上编译安装6.0.3的最新内核_centos安装并编译内核-程序员宅基地

- 【Python】Python字符串格式化问题:%、format()与f-strings-程序员宅基地

- 汇总程序员学习Python必备的42个快捷键,看完收获满满_python规范化快捷键-程序员宅基地

- KEIL debug无法进入main函数 或 debug卡死的原因总结_keil5debug卡在fpu_irqhandler-程序员宅基地