”Flink“ 的搜索结果

hadoop,flink,集成

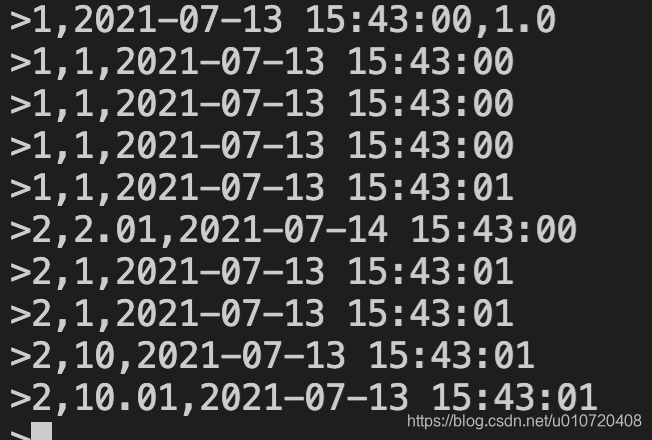

通过flink-cdc实现kafka数据源的数据实时同步到目标数据库,并对目标库进行增删改操作

org.apache.flink.client.program.ProgramInvocationException: The main method caused an error: JobManager memory configuration failed: The configured Total Flink Memory (64.000mb (67108864 bytes)) is

Flink 的部署模式分为3种: Application 模式 Per-Job 模式 Session 模式 Application 模式 Application 模式即 Flink 为1个应用专门创建1个集群,Flink集群和应用同生命周期,Application 的main()方法将由 ...

整理:陈政羽(Flink 社区志愿者)摘要:Flink 1.11 引入了 CDC,在此基础上, JDBC Connector 也发生比较大的变化,本文由Apache Flink Con...

Apache Flink 社区非常高兴地宣布了 ApacheFlink 1.14.4 发布了,这是 Apache Flink 1.14 的第三个 bugfix版本.这个版本修复了 51...

mvn clean install -DskipTests -Drat.skip=true -Dcheckstyle.skip=true -Dscala=2.11.12

Apache Flink是一个开源的流处理和批处理框架,可以实现快速、可靠、可扩展的大数据处理。窗口是Flink中用于对无限数据流进行有界处理的机制。它将无限流切分为有限的、不重叠的块,并对每个窗口进行计算。...

Flink 1.12.2 写入hdfs有3种方式,依照api出现的先后依次介绍,重点介绍Flink SQL on Hive的方式。 目录 1 streaming file sink 2 FileSink 3 Flink SQL on Hive 3.1添加依赖 3.2 配置Hive Catalog及使用Flink...

Apache Flink是一个分布式处理引擎框架,用于在无边界和有边界数据流上进行有状态的计算,实现数据流批一体化。能在常见的YARN、 Mesos、Kubernetes 在内的等多种资源管理框架集群/单机环境中灵活部署,并以高可用...

对于初学者来说,学习 Flink 可能不是一件容易的事情。看文档是一种学习,更重要的是实践起来。但对于一个初学者来说要把一个 Flink SQL 跑起来还真不容易,要搭各种环境,真心累。很...

对于单个flink任务提交到yarn集群,通过命令行的方式是能接受的,但是我们开发实时计算平台就需要通过代码的方式将我们管理的flink任务提交到yarn集群上去。本文主要介绍flink1.11新的部署模式–Application模式,...

【Flink】Flink通过自定义Sink写入MySQL数据库

org.apache.flink.table.api.TableException: StreamPhysicalWindowAggregate doesn't support consuming update and delete changes which is produced by node TableSourceScan(table=[[vvp, dwd, holo_d

Flink的项目依赖

推荐文章

- 【百度大脑新品体验】驾驶行为分析_为什么选用百度智能云驾驶行为分析接口-程序员宅基地

- 深度学习模型Intel与ARM部署性能分析,Intel和ARM CPU上CNN计算速度差距分析。_arm中数据搬运速度太慢-程序员宅基地

- Xilinx之FPGA器件系列简介_ultrascale和7系列区别-程序员宅基地

- 获取每个部门中当前员工薪水最高的相关信息,mysql的group by一个我踩过的坑_求各个部门薪资最高多少,如果为空显示没有薪资-程序员宅基地

- window下hadoop、hbase的安装和eclipse开发环境配置_安装和配置 eclipse 下的 hadoop 开发环境-程序员宅基地

- linux的source命令,Linux中source命令的用法-程序员宅基地

- oracle数据库后plsql登陆界面不显示数据库问题_plsql连接oracle配置完没有数据库显示-程序员宅基地

- 会议OA系统04_ufrusx-程序员宅基地

- ipa签名工具(IPA Resign Tool)在windows和macos系统下对苹果ipa文件一键重签名-程序员宅基地

- 2024年Unity 面试题 |五萬字 二佰道| Unity面试题大全,面试题总结【全网最全,收藏一篇足够面试】-程序员宅基地