pytorch U-Net,R2U-Net,Attention U-Net,Attention R2U-Net的实现 U-Net:用于生物医学图像分割的卷积网络 基于U-Net(R2U-Net)的递归残积卷积神经网络用于医学图像分割 注意U-Net:学习在哪里寻找胰腺 ...

”Attention“ 的搜索结果

NIPS-2017-attention-is-all-you-need-Paper.pdf

Yong Li , Student Member, IEEE, Jiabei Zeng , Member, IEEE, Shiguang Shan , Member, IEEE, and Xilin Chen, Fellow, IEEE

$ pip install slot_attention 用法 import torch from slot_attention import SlotAttention slot_attn = SlotAttention ( num_slots = 5 , dim = 512 , iters = 3 # iterations of attention, defaults to 3 ) ...

TensorFlow版本:1.9.0 Keras版本:2.0.2 我的博客: :

Attention Is All You Need,Sequence to Sequence for neural machine tranlation

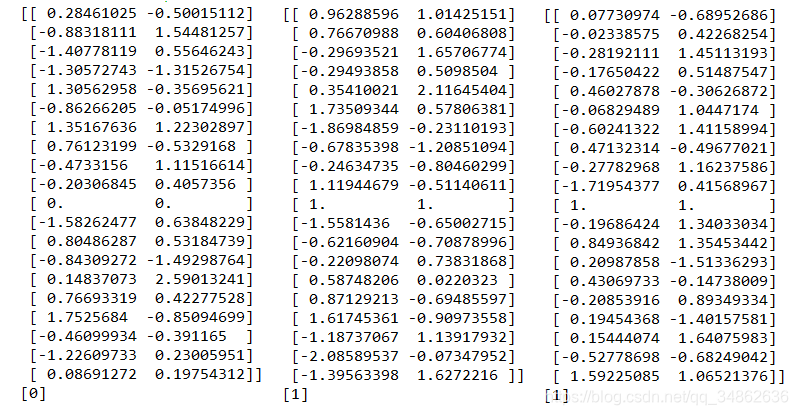

attention_mul = merge([inputs, attention_probs], output_shape=input_dims, name='attention_mul', mode='mul') 让我们考虑这个“ Hello World”示例: 32个值的向量v作为模型的输入(简单前馈神经网络)。 v ...

Stand-Alone_Self-Attention_in_Vision_Models 创建的资料库旨在审查德累斯顿大学计算机视觉研讨会的科学文章

Self-supervised_Attention_Mechanism_for_Pediatric_Bone_Age_Assessment_with_Efficient_Weak_Annotation.pdf

<p>Attention Is All You Need,NLP经典论文,值得仔细阅读</p>

attention is all you need 讲解PPT 附带注释

情感分析分类 先决条件 安装依赖项 pip install -r requirements.txt 安装Spacy英语数据 python -m spacy download en 框架 火炬 数据集 Cornell MR(电影评论)数据集 实施 RNN ...有线电视新闻网

RCNN-Attention Unet -Attention R2U-Net:只需将两个最新的高级作品集成在一起(R2U-Net + Attention U-Net) 嵌套的UNet -UNet ++:用于医学图像分割的嵌套U-Net体系结构 具有图层可视化 1.入门 克隆仓库: ...

使用attention机制实现和可视化一个自定义RNN层

Self Attention Attention机Decoder是输出元素和Encoder中的输入元素做attention,说的是翻译的结果和输入的哪些信息有关。 Self Attention则是Encoder中的信息自己对自己做attention,说的是自己这一句话内容之间的...

cnn-bilstm-attention-time-series-prediction_keras-mastercnn-bilstm-attention-time-series-prediction_keras-mastercnn-bilstm-attention-time-series-prediction_keras-mastercnn-bilstm-attention-time-series...

基于Keras的GAN网络代码,里面有各种GAN网络的代码,请下载

Attention plays a critical role in human visual experience. Furthermore, it has recently been demonstrated that attention can also play an important role in the context of applying artificial neural ...

时序预测中Attention机制是否真的有效?盘点LSTM/RNN中24种Attention机制+效果对比

论文 Attention-is-all-you-need 训练数据集,即Transformers的数据集

从深度学习的角度出发,提出了一种基于Attention 的双向长短时记忆网络(bidirectional long short-term memory,BLSTM)与条件随机场(conditional random fields,CRF)相结合的领域术语抽取模型(BLSTM_Attention_CRF ...

内容包含注意力机制和强化学习两部分,组会汇报所用,便于理解

深度学习注意力机制 - Attention in Deep learning【101页PPT】Amazon网络服务机器学习负责人Alexander J. Smola 在ICML2019会议上做了关于深度学习中的注意力机制的报告,详细展示了从最早的NWE到最新的Multiple ...

【Attention中mask pad的weight的做法】 在attention中,对attention score进行softmax时,需要考虑到query与pad计算得到的score应该忽略。我们在处理时可以先正常地用高维tensor形式将所有score计算出来,然后根据...

IoT中的监视视频理解的“ Attention-In-Attention”网络

该文档主要介绍了attention及其变种self attention 、multi-attention以及一些相关的paper

Attention注意机制现在大热,很多深度学习的框架都带上了注意力机制,而且也取得了很好的性能指标。乘着大热也来水一水文章,发表发表自己的看法。事先说明老哥我在NLP上萌新一枚,粗糙想法不登大雅,呆萌的逻辑思维...

attention_mul = merge([inputs, attention_probs], output_shape=input_dims, name='attention_mul', mode='mul') 让我们考虑这个“ Hello World”示例: 32个值的向量v作为模型的输入(简单前馈神经网络)。 v ...

推荐文章

- 大数据技术未来发展前景及趋势分析_大数据技术的发展方向-程序员宅基地

- Abaqus学习-初识Abaqus(悬臂梁)_abaqus悬臂梁-程序员宅基地

- 数据预处理--数据格式csv、arff等之间的转换_csv转arff文件-程序员宅基地

- c语言发送网络请求,如何使用C+发出HTTP请求?-程序员宅基地

- ccc计算机比赛如何报名,整理:加拿大的CCC是什么,怎么报名?-程序员宅基地

- RK3568 学习笔记 : ubuntu 20.04 下 Linux-SDK 镜像烧写_rk3568刷linux-程序员宅基地

- Gradle是什么_gradle是干嘛的-程序员宅基地

- adb命令集锦-程序员宅基地

- 【Java基础学习打卡15】分隔符、标识符与关键字_java分隔符有哪三种-程序员宅基地

- Python批量改变图片名字_python批量修改图片名称-程序员宅基地