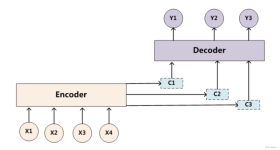

说到attention机制,那可真是太牛逼了。不会attention都不好意思说自己视深度学习从业者,那么今天我们就来一步一步剖析一下这近几年来最火的深度学习模型。 2.Encoder-Decoder 2.1Encoder-Decoder简介 Encoder-...

”Attention“ 的搜索结果

注意力机制是深度学习方法的一个重要主题。清华大学计算机图形学团队和南开大学程明明教授团队、卡迪夫大学Ralph R. Martin教授合作,在ArXiv上发布关于计算机视觉中的注意力机制的综述文章[1]。...

30种常见注意力机制论文、解读、使用方法、实现代码整理(Attention)

中文文本分类实战,基于TextCNN,TextRNN,FastText,TextRCNN,BiLSTM_Attention等模型 完整代码数据 可直接运行:

回归预测 | MATLAB实现Attention-LSTM(注意力机制长短期记忆神经网络)多输入单输出(完整源码和数据) 多输入单输出,运行环境MATLAB2020b及以上。

2021AIWIN 手写体 OCR 识别竞赛总结(任务一),详见文章:https://blog.csdn.net/hhhhhhhhhhwwwwwwwwww/article/details/122563647?spm=1001.2014.3001.5501

An Attention-Based BiLSTM-CRF Model for Chinese Clinic Named Entity Recognition;基于注意力的 BiLSTM-CRF 模型 中国门诊病历文本命名实体识别

基于Attention网络实现行车速度预测.rar基于Attention网络预测.rar

TCN-with-attention-master_attention_tcn_attention预测_attention-LSTM_TCN预测_源码.zip

使用TextCNN神经网络以及Attention机制来实现文本的情感分类,该文档只是提供了完整的模型部分,可以根据自己的需要更改数据集等以及数据预处理部分.

该代码为基于Keras的attention实战,环境配置: Wn10+CPU i7-6700 、Pycharm 2018、 python 3.6 、、numpy 1.14.5 、Keras 2.0.2 Matplotlib 2.2.2 经过小编亲自调试,可以使用,适合初学者从代码的角度了解...

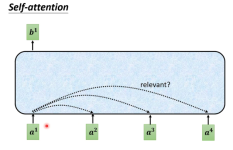

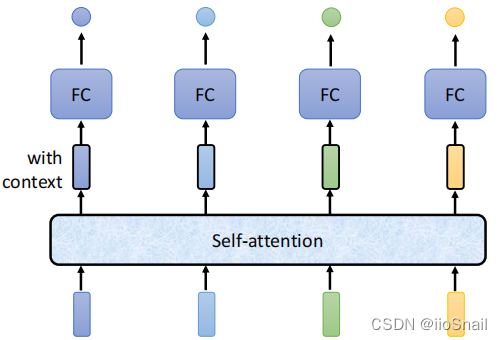

Attention分享周知瑞@研发中心, Jun 20, 2018(一)深度学习中的直觉3 X 1 and 1 X 3 代替 3 X 3LSTM中的门设计生成对抗网络Attention机制的本质来自于人类视觉注意力机制。人们视觉在感知东西的时候一般不会是一个...

该模型设计的思想就是利用attention机制,在普通ResNet网络中,增加侧分支,侧分支通过一系列的卷积和池化操作,逐渐提取高层特征并增大模型的感受野,前面已经说过高层特征的激活对应位置能够反映attention的区域,...

MATLAB实现LSTM-Attention和LSTM多特征分类预测(完整源码和数据) 1.LSTM-Attention和LSTM分类预测; 2.Attention-LSTM分类预测,注意力机制Attention-LSTM分类预测; 3.程序语言为matlab,程序可出分类效果图,混淆...

自下而上的注意力该存储库包含基于Caffe的项目的PyTorch重新实现。 我们使用作为后端来提供完整的功能,包括培训,测试和特征提取。 此外,我们从原始存储库中迁移了经过预训练的基于Caffe的模型,该模型可以提取与...

RNN+Attention实现Seq2Seq中英文机器翻译

Attention is all you need

NeAt(Neural Attention)Vision是一种可视化工具,用于自然语言处理(NLP)任务的深度学习模型的注意力机制。 产品特点 可视化注意力得分,有很多选择。 将可视化文件导出为SVG格式。 如果要在学术论文中使用可视...

要求Cuda 8(Theano可以搭配使用) 的Python 3 千层面其他一些(最佳安装Anaconda)跑步在源根目录首先提取预处理的SNLI数据./extract_data.sh 然后运行: python3 ./snli_reasoning_attention.py [condition|...

利用CNN_LSTM_ATTENTION模型对寿命的预测

实验代码:relation_Extraction.zip

【深度学习实战应用案例】时序分析-seq2seq(attention)(代码+数据)

文字识别方法在不规则文本识别上,多采用attention的方式,但是采用自回归模型的attention容易存在attention对齐的问题。文章提出了一个 a decoupled attention network (DAN)网络。其主要由:1.特征采集器;2.一个...

A Supervised Multi-Head Self-Attention Network for Nested NE.pdf

Attention Based Spatial-Temporal Graph Convolutional Networks for Traffic Flow Forecasting

推荐文章

- 大数据技术未来发展前景及趋势分析_大数据技术的发展方向-程序员宅基地

- Abaqus学习-初识Abaqus(悬臂梁)_abaqus悬臂梁-程序员宅基地

- 数据预处理--数据格式csv、arff等之间的转换_csv转arff文件-程序员宅基地

- c语言发送网络请求,如何使用C+发出HTTP请求?-程序员宅基地

- ccc计算机比赛如何报名,整理:加拿大的CCC是什么,怎么报名?-程序员宅基地

- RK3568 学习笔记 : ubuntu 20.04 下 Linux-SDK 镜像烧写_rk3568刷linux-程序员宅基地

- Gradle是什么_gradle是干嘛的-程序员宅基地

- adb命令集锦-程序员宅基地

- 【Java基础学习打卡15】分隔符、标识符与关键字_java分隔符有哪三种-程序员宅基地

- Python批量改变图片名字_python批量修改图片名称-程序员宅基地