Mixed High-Order Attention Network for Person Re-Identification CVPR2020

”Attention“ 的搜索结果

ResNeSt Split-Attention Networks,ResNet的一个变形,取得了很好的效果

Top attention in line with time: A light-weight strategy

Recurrent attention model for pedestrian attribute recognition

给定任何查询,注意力机制通过注意力汇聚(attention pooling) 将选择引导至感官输入(sensory inputs,例如中间特征表示)。 在注意力机制中,这些感官输入被称为值(value)。 更通俗的解释,每个值都与一个键...

Attention的原理和实现 目标 知道Attention的作用 知道Attention的实现机制 能够使用代码完成Attention代码的编写 1. Attention的介绍 在普通的RNN结构中,Encoder需要把一个句子转化为一个向量,然后在Decoder中...

论文笔记:Progressive Attention Guided Recurrent Network for Salient Object Detection-附件资源

Attention mechanism 总结:Attention机制简单来说就是一种信息过滤或者提取机制类似于记忆或者门控机制,用来筛选、更新信息。 类比于人脑,神经网络中可以存储的信息量称为网络容量。要存储的信息越多,神经元...

Transformer-Attention is all you need 论文, google出品, 可查阅博文: https://ai.googleblog.com/2017/08/transformer-novel-neural-network.html

Attention在文档分类中的应用

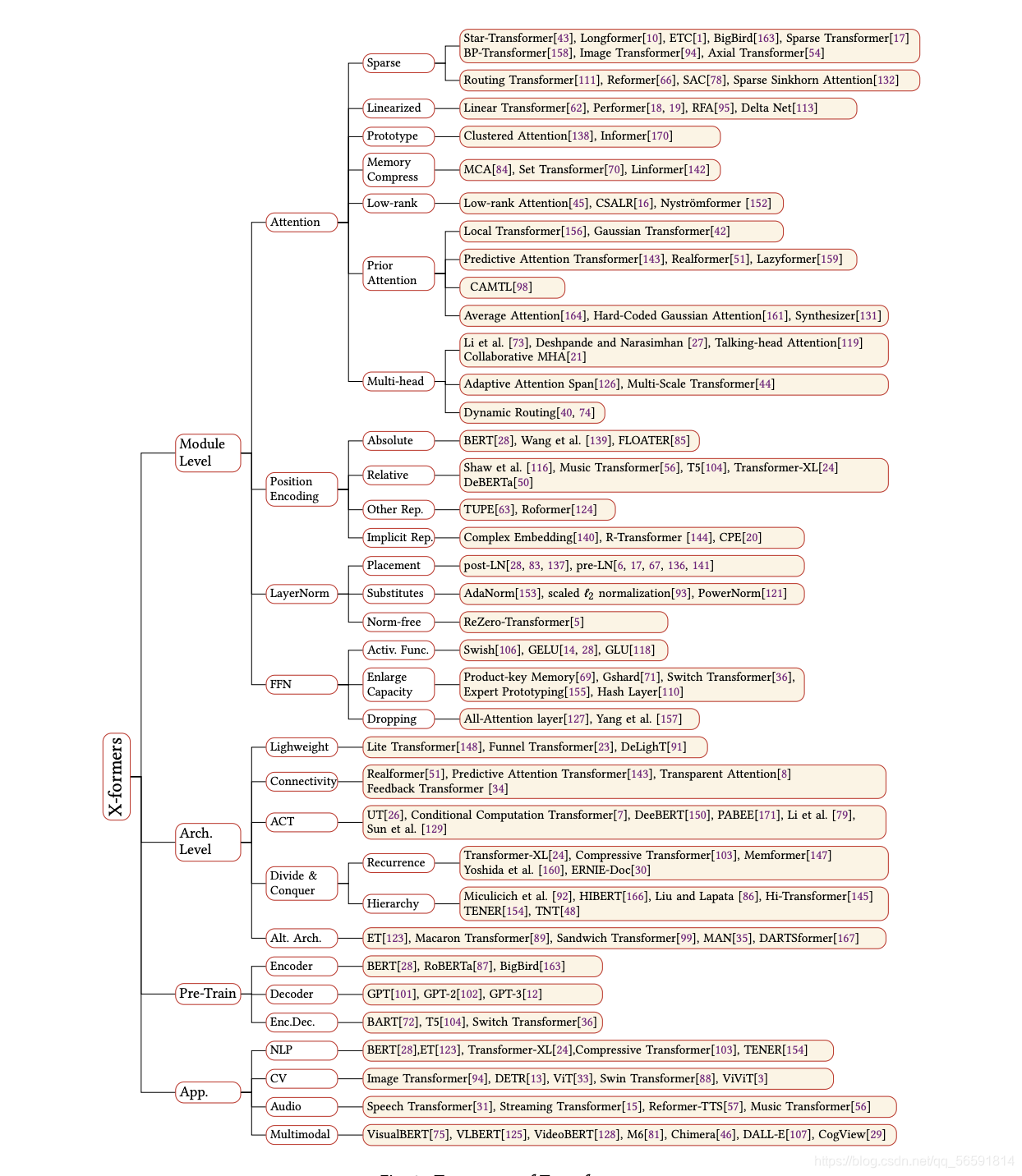

1. self-attention原理介绍 形象化解释:The Illustrated Transformer 哈佛代码介绍:The Annotated Transformer 论文解读:Attention Is All You Need - The Transformer 2. self-attention改进方向 先放资源,...

Attention Is All You Need 注意力机制是你需要的全部 Ashish Vaswani, Noam Shazeer, Niki Parmar, Jakob Uszkoreit, Llion Jones, Aidan N. Gomez, Lukasz Kaiser, Illia Polosukhin attention [ə'tenʃ(ə)n]:n...

Attention总结二: 涉及论文: Show, Attend and Tell: Neural Image Caption Generation with Visual Attentio(用了hard\soft attention attention) Effective Approaches to Attention-based Neural Machine ...

推荐文章

- 大数据技术未来发展前景及趋势分析_大数据技术的发展方向-程序员宅基地

- Abaqus学习-初识Abaqus(悬臂梁)_abaqus悬臂梁-程序员宅基地

- 数据预处理--数据格式csv、arff等之间的转换_csv转arff文件-程序员宅基地

- c语言发送网络请求,如何使用C+发出HTTP请求?-程序员宅基地

- ccc计算机比赛如何报名,整理:加拿大的CCC是什么,怎么报名?-程序员宅基地

- RK3568 学习笔记 : ubuntu 20.04 下 Linux-SDK 镜像烧写_rk3568刷linux-程序员宅基地

- Gradle是什么_gradle是干嘛的-程序员宅基地

- adb命令集锦-程序员宅基地

- 【Java基础学习打卡15】分隔符、标识符与关键字_java分隔符有哪三种-程序员宅基地

- Python批量改变图片名字_python批量修改图片名称-程序员宅基地