NNLM Word2Vec FastText LSA Glove 总结_word2vec 和 nnlm 对比有什么区别?-程序员宅基地

NNLM(Neural Network Language Model)

顾名思义,就是神经网络语言模型,本质就是语言模型。word2vec也可以看成一种语言模型,但是为了计算的效率,把神经softmax给拿掉了,下面稍详细写写word2vec

Word2Vec

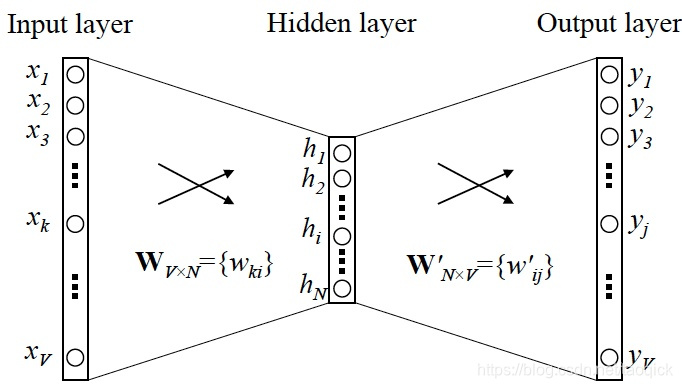

Word2Vec的结构如下图,假设输入词库的大小是V,每个词都用one-hot来表示,那么每个词的维度就是V。Input layer到Hidden layer之间用一个全连接网络相连,如果Hidden layer有N层,那么参数就是VN。而Output layer最终也是V维,因此从Hidden layer到Output layer之间的参数是VN。

有了这个结构,Word2Vec有两个目标: ∑ w ∈ C l o g ( w ∣ c o n t e x t ) \sum_{w\in C}log(w|context) ∑w∈Clog(w∣context) (Continous bag-of-word)和 ∑ w ∈ C l o g ( c o n t e x t ∣ w ) \sum_{w\in C}log(context|w) ∑w∈Clog(context∣w) (Skip-gram)。当然输出层是一个向量,想把这个向量映射到某个词的概率得用softmax函数 P ( y = x n ∣ x ) = e x n ∑ i = 1 V e x i P(y=x_n|x)=\frac{e^{x_n}}{\sum_{i=1}^Ve^{x_i}} P(y=xn∣x)=∑i=1Vexiexn,其中x为最终输出层输出的向量, x n x_n xn表示x中和单词 w n w_n wn对应的维度的值。

有了这个结构以后,开始用back propagation来求解,但是由于Softmax激活函数中存在归一化项的缘故,推导出来的迭代公式需要对词汇表中的所有单词进行遍历,使得每次迭代过程非常缓慢。这部分推导可以参考word2vec Parameter Learning Explained by Xin Rong,里面非常详细。

为了优化back propagation,word2vec里用了hierarchy softmax,本质是把 N 分类问题变成 log(N)次二分类,但是这种方法还是训练慢。干脆更直接一点用了Negative Sample,实质上对每一个样本中每一个词都进行负例采样。

训练好以后,我们实际上是把隐藏层(Hidden layer也叫projection layer)里的权重拿出来,这样原始的V维one-hot就可以映射成一个N维的向量(N一般在50-300之间)。这个N维的向量有些很好的性质,例如叠加,再比如巴黎-法国=柏林-德国等等。我们在应用中直接load这个word2vec的词表就可以。

FastText

fastText简而言之,就是把文档中所有词通过lookup table变成向量,取平均后直接用线性分类器得到分类结果。

但是比如对下面的三个例子来说:The movie is not very good , but i still like it . [2]The movie is very good , but i still do not like it .I do not like it , but the movie is still very good .其中第1、3句整体极性是positive,但第2句整体极性就是negative。如果只是通过简单的取平均来作为sentence representation进行分类的话,可能就会很难学出词序对句子语义的影响。

这部分转自知乎

作者:董力

链接:https://www.zhihu.com/question/48345431/answer/111513229

LSA

潜在语义分析(Latent Semantic Analysis)可以基于co-occurance matrix构建词向量,实质上是基于全局语料采用SVD进行矩阵分解,然而SVD计算复杂度高,所以潜在语义分析是基于频率的

Glove

GloVe的全称叫Global Vectors for Word Representation,它是一个基于全局词频统计(count-based & overall statistics)的词表征(word representation)工具,说白了就是给共现矩阵降维,但是又不像LSA那么heavy,而是利用目标函数上的技巧来优化计算。

Glove的目标函数是

J = ∑ i , j N f ( X i , j ) ( v i T v j + b i + b j − l o g ( X i , j ) ) 2 J=\sum_{i,j}^Nf(X_{i,j})(v_i^Tv_j+b_i+b_j-log(X_{i,j}))^2 J=i,j∑Nf(Xi,j)(viTvj+bi+bj−log(Xi,j))2

其中f(x)是权重

f ( x ) = ( x / x m a x ) 0.75 , 当 x < x m a x f ( x ) = 1 , 当 x > = x m a x f(x)=(x/xmax)^{0.75}, 当x<xmax\\ f(x)=1, 当x>=xmax f(x)=(x/xmax)0.75,当x<xmaxf(x)=1,当x>=xmax

训练采用了AdaGrad的梯度下降算法,对矩阵X中的所有非零元素进行随机采样,学习曲率(learning rate)设为0.05,在vector size小于300的情况下迭代了50次,其他大小的vectors上迭代了100次,直至收敛。

这个目标函数的脑洞是这样的,两个词向量的乘积 v i T v j v_i^Tv_j viTvj是和 P i , j P_{i,j} Pi,j正相关的,其中 P i , j P_{i,j} Pi,j表示两个词共现的概率。那么

P i , j = X i , j X i = X i , j X i P_{i,j} = \frac{X_{i,j}}{X_i}=\frac{X_{i,j}}{X_i} Pi,j=XiXi,j=XiXi,j

同时希望满足以下除法的关系,因此需要加一下Log: P i , j = X i , k X j , k P_{i,j} = \frac{X_{i,k}}{X_{j,k}} Pi,j=Xj,kXi,k

那么的可以得到

l o g ( P i , j ) = v i T v j l o g ( X i , j ) − l o g ( X i ) = v i T v j l o g ( X i , j ) = v i T v j + b i + b j J = ∑ i , j N f ( X i , j ) ( v i T v j + b i + b j − l o g ( X i , j ) ) 2 log(P_{i,j})=v_i^Tv_j \\ log(X_{i,j})-log(X_{i})=v_i^Tv_j \\ log(X_{i,j}) =v_i^Tv_j+b_i+b_j \\ J=\sum_{i,j}^Nf(X_{i,j})(v_i^Tv_j+b_i+b_j-log(X_{i,j}))^2 log(Pi,j)=viTvjlog(Xi,j)−log(Xi)=viTvjlog(Xi,j)=viTvj+bi+bjJ=i,j∑Nf(Xi,j)(viTvj+bi+bj−log(Xi,j))2

详细目标函数的脑洞和推导可以参考:https://blog.csdn.net/coderTC/article/details/73864097和http://www.fanyeong.com/2018/02/19/glove-in-detail/

各种比较

以下转自知乎:https://zhuanlan.zhihu.com/p/57153934

1、word2vec和tf-idf 相似度计算时的区别?

word2vec 1、稠密的 低维度的 2、表达出相似度; 3、表达能力强;4、泛化能力强;

2、word2vec和NNLM对比有什么区别?(word2vec vs NNLM)

1)其本质都可以看作是语言模型;

2)词向量只不过NNLM一个产物,word2vec虽然其本质也是语言模型,但是其专注于词向量本身,因此做了许多优化来提高计算效率:

与NNLM相比,词向量直接sum,不再拼接,并舍弃隐层;

考虑到sofmax归一化需要遍历整个词汇表,采用hierarchical softmax 和negative sampling进行优化,hierarchical softmax 实质上生成一颗带权路径最小的哈夫曼树,让高频词搜索路劲变小;negative sampling更为直接,实质上对每一个样本中每一个词都进行负例采样;

3、 word2vec负采样有什么作用?

负采样这个点引入word2vec非常巧妙,两个作用,1.加速了模型计算,2.保证了模型训练的效果,一个是模型每次只需要更新采样的词的权重,不用更新所有的权重,那样会很慢,第二,中心词其实只跟它周围的词有关系,位置离着很远的词没有关系,也没必要同时训练更新,作者这点非常聪明。

4、word2vec和fastText对比有什么区别?(word2vec vs fastText)

1)都可以无监督学习词向量, fastText训练词向量时会考虑subword;

2)fastText还可以进行有监督学习进行文本分类,其主要特点:

结构与CBOW类似,但学习目标是人工标注的分类结果;

采用hierarchical softmax对输出的分类标签建立哈夫曼树,样本中标签多的类别被分配短的搜寻路径;

引入N-gram,考虑词序特征;

引入subword来处理长词,处理未登陆词问题;

5、glove和word2vec、 LSA对比有什么区别?(word2vec vs glove vs LSA)

1)glove vs LSA

LSA(Latent Semantic Analysis)可以基于co-occurance matrix构建词向量,实质上是基于全局语料采用SVD进行矩阵分解,然而SVD计算复杂度高;

glove可看作是对LSA一种优化的高效矩阵分解算法,采用Adagrad对最小平方损失进行优化;

2)word2vec vs LSA

主题模型和词嵌入两类方法最大的不同在于模型本身。

主题模型是一种基于概率图模型的生成式模型。其似然函数可以写为若干条件概率连乘的形式,其中包含需要推测的隐含变量(即主题)

词嵌入模型一般表示为神经网络的形式,似然函数定义在网络的输出之上。需要学习网络的权重来得到单词的稠密向量表示。

3)word2vec vs glove

word2vec是局部语料库训练的,其特征提取是基于滑窗的;而glove的滑窗是为了构建co-occurance matrix,是基于全局语料的,可见glove需要事先统计共现概率;因此,word2vec可以进行在线学习,glove则需要统计固定语料信息。

word2vec是无监督学习,同样由于不需要人工标注;glove通常被认为是无监督学习,但实际上glove还是有label的,即共现次数[公式]。

word2vec损失函数实质上是带权重的交叉熵,权重固定;glove的损失函数是最小平方损失函数,权重可以做映射变换。

总体来看,glove可以被看作是更换了目标函数和权重函数的全局word2vec。

智能推荐

手把手教你安装Eclipse最新版本的详细教程 (非常详细,非常实用)_eclipse安装教程-程序员宅基地

文章浏览阅读4.4k次,点赞2次,收藏16次。写这篇文章的由来是因为后边要用这个工具,但是由于某些原因有部分小伙伴和童鞋们可能不会安装此工具,为了方便小伙伴们和童鞋们的后续学习和不打击他们的积极性,因为80%的人都是死在工具的安装这第一道门槛上,这门槛说高也不高说低也不是太低。所以就抽时间水了这一篇文章。_eclipse安装教程

分享11个web前端开发实战项目案例+源码_前端项目实战案例-程序员宅基地

文章浏览阅读4.1w次,点赞12次,收藏193次。小编为大家收集了11个web前端开发,大企业实战项目案例+5W行源码!拿走玩去吧!1)小米官网项目描述:首先选择小米官网为第一个实战案例,是因为刚开始入门,有个参考点,另外站点比较偏向目前的卡片式设计,实现常见效果。目的为学者练习编写小米官网,熟悉div+css布局。学习资料的话可以加下web前端开发学习裙:600加上610再加上151自己去群里下载下。项目技术:HTML+CSS+Div布局2)迅雷官网项目描述:此站点特效较多,所以通过练习编写次站点,学生可以更多练习CSS3的新特性过渡与动画的实_前端项目实战案例

计算质数-埃里克森筛法(间隔黄金武器)-程序员宅基地

文章浏览阅读73次。素数,不同的质数,各种各样的问题总是遇到的素数。以下我们来说一下求素数的一种比較有效的算法。就是筛法。由于这个要求得1-n区间的素数仅仅须要O(nloglogn)的时间复杂度。以下来说一下它的思路。思路:如今又1-n的数字。素数嘛就是除了1和本身之外没有其它的约数。所以有约数的都不是素数。我们从2開始往后遍历,是2的倍数的都不是素数。所以我们把他们划掉然后如...

探索Keras DCGAN:深度学习中的创新图像生成-程序员宅基地

文章浏览阅读532次,点赞9次,收藏14次。探索Keras DCGAN:深度学习中的创新图像生成项目地址:https://gitcode.com/jacobgil/keras-dcgan在数据驱动的时代,图像生成模型已经成为人工智能的一个重要领域。其中,Keras DCGAN 是一个基于 Keras 的实现,用于构建和训练 Deep Convolutional Generative Adversarial Networks(深度卷积生...

org.apache.ibatis.binding.BindingException: Invalid bound statement (not found):_spring-could org.apache.ibatis.binding.bindingexce-程序员宅基地

文章浏览阅读116次。今天在搭建springcloud项目时,发现如上错误,顺便整理一下这个异常:1. mapper.xml的命名空间(namespace)是否跟mapper的接口路径一致<mapper namespace="com.baicun.springcloudprovider.mapper.SysUserMapper">2.mapper.xml接口名是否和mapper.java接..._spring-could org.apache.ibatis.binding.bindingexception: invalid bound state

四种高效数据库设计思想——提高查询效率_数据库为什么能提高效率-程序员宅基地

文章浏览阅读1.1k次。四种高效数据库设计思想——提高查询效率:设计数据库表结构时,我们首先要按照数据库的三大范式进行建立数据。1. 1NF每列不可拆分2. 2NF确保每个表只做一件事情3. 3NF满足2NF,消除表中的依赖传递。三大范式的出现是在上世纪70年代,由于内存资源比较昂贵,所以严格按照三大范式进行数据库设计。而如今内存变得越来越廉价,在考虑效率和内存的基础上我们可以做出最优选择以达到最高效率。_数据库为什么能提高效率

随便推点

HTML标签分类及转义字符_ol是单标记还是双标记-程序员宅基地

文章浏览阅读302次。一. HTML标签分类1.根据标签个数分类。 单标签:只有一个标签。 <br>, <hr>,<img>,<meta>, 实现一个特定的功能。 双标签:既有开始标签,也有结束标签。 Html,head,Body,title,h1~h6,p,a,ul,li,ol,strong,em。2.根据标签特性分类(网页效果)。 2.1行属性..._ol是单标记还是双标记

什么是配置_基于配置是什么意思-程序员宅基地

文章浏览阅读1.6k次。应用程序在启动和运行的时候往往需要读取一些配置信息,配置基本上伴随着应用程序的整个生命周期,比如:数 据库连接参数、启动参数等。配置主要有以下几个特点:配置是独立于程序的只读变量配置对于程序是只读的,程序通过读取配置来改变自己的行为,但是程序不应该去改变配置配置伴随应用的整个生命周期配置贯穿于应用的整个生命周期,应用在启动时通过读取配置来初始化,在运行时根据配置调整行为。比如:启动时需要读取服务的端口号、系统在运行过程中需要读取定时策略执行定时任务等。配置可以有多种加载方式常见的有程序内部_基于配置是什么意思

二、使用GObject——一个简单类的实现-程序员宅基地

文章浏览阅读170次。Glib库实现了一个非常重要的基础类--GObject,这个类中封装了许多我们在定义和实现类时经常用到的机制: 引用计数式的内存管理 对象的构造与析构 通用的属性(Property)机制 Signal的简单使用方式 很多使用GObject..._

golang 定时任务处理-程序员宅基地

文章浏览阅读6.3k次,点赞2次,收藏9次。在 golang 中若写定时脚本,有两种实现。一、基于原生语法组装func DocSyncTaskCronJob() { ticker := time.NewTicker(time.Minute * 5) // 每分钟执行一次 for range ticker.C { ProcTask() }}func ProcTask() { log.Println("hello world")}二、基于 github 中封装的 cron 库实现package taskimport (_golang 定时任务

VC获取精确时间的方法_vc 通过线程和 sleep 获取精准时间-程序员宅基地

文章浏览阅读2.1k次。 来源:http://blog.csdn.net/clever101/archive/2008/10/18/3096049.aspx 声明:本文章是我整合网上的资料而成的,其中的大部分文字不是我所为的,我所起的作用只是归纳整理并添加我的一些看法。非常感谢引用到的文字的作者的辛勤劳动,所参考的文献在文章最后我已一一列出。 对关注性能的程序开发人员而言,一个好的计时部件既是益友,也_vc 通过线程和 sleep 获取精准时间

wml入门-程序员宅基地

文章浏览阅读58次。公司突然说要进行wap开发了,以前从没了解过,但我却异常的兴奋,因为可以学习新东西了,呵呵,我们大家一起努力吧。首先说说环境的搭建。可以把.wml的文件看做是另一种的html进行信息的展示,但并不是所有的浏览器都支持,好用的有Opera,还有WinWap。编写wml文件语法比较严格,不好的是我还没有找到好的提示工具,就先用纯文本吧。我找到了一个很好的学习网站:http://w3sc..._winwap学习