Python网络爬虫与信息提取——网络爬虫Scrapy框架_网络爬虫与信息提取 目录-程序员宅基地

技术标签: 爬虫 MOOC python 笔记 Scrapy框架

第五章 网络爬虫之Scrapy框架

● Scrapy爬虫框架

- Scrapy爬虫框架介绍

1、Scrapy安装:cmd-> pip install scrapy

2、Scrapy不是一个函数功能库而是一个爬虫框架。

爬虫框架:

1)爬虫框架是实现爬虫功能的一个软件结构和功能组件集合。

2)爬虫框架是一个半成品,能够帮助用户实现专业网络爬虫。

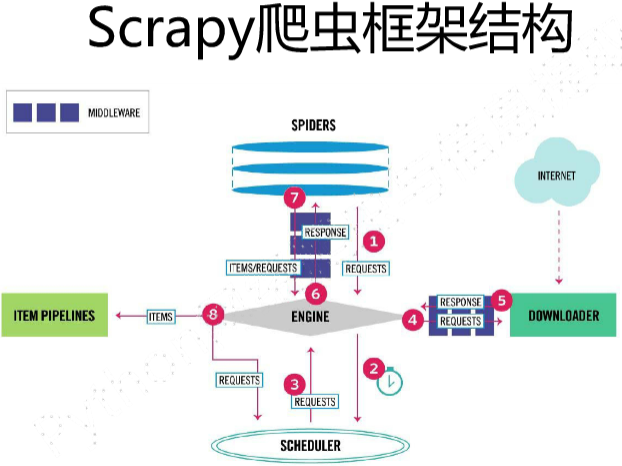

3、Scrapy爬虫框架结构(5主要模块+2中间键)

数据流的三个路径

路径1:

1)Engine从 Spider处获得爬取请求( Request);

2)Engine将爬取请求转发给 Scheduler,用于调度;

路径2:

3)Engine从 Scheduler处获得下一个要爬取的请求;

4)Engine将爬取请求通过中间件发送给 Downloader;

5)爬取网页后, Downloader形成响应( Response),通过中间件发给 Engine;

6)Engine将收到的响应通过中间件发送给 Spider处理;

路径3:

7)Spider处理响应后产生爬取项(scraped Item)和新的爬取请求( Requests)给Engine;

8)Engine将爬取项发送给Item Pipeline(框架出口);

9)Engine将爬取请求发送给Scheduler。

数据流的出入口

Engine控制各模块数据流,不间断从 Scheduler处获得爬取请求,直至请求为空。

框架入口: Spider的初始爬取请求

框架出口: Item Pipeline

ENGINE、SCHEDULER、DOWNLOAD模块功能已有实现,SPIDERS、ITEM PIPELINES模块有用户编写(配置)。 - Scrapy爬虫框架解析

1、Engine模块(不需要用户修改)—核心

1)控制所有模块之间的数据流;

2)根据条件触发事件;

2、Downloader模块(不需要用户修改:根据请求下载网页;

3、Scheduler模块(不需要用户修改:对所有爬取请求进行调度管理;

4、Spider模块(需用户编写配置代码)

1)解析Downloader返回的响应(Response);

2)产生爬取项(scraped item);

3)产生额外的爬取请求(Request);

5、Item Pipelines模块(需用户编写配置代码)

1)以流水线方式处理 Spider产生的抓取项;

2)由一组操作顺序组成,类似流水线,每个操作是一个Item Pipeline类型;

3)可能操作包括:清理、检验和查重爬取项中的HTML数据、将数据存储到数据库;

6、Downloader Middleware中间键(用户可编写配置代码)

目的:实施 Engine、Scheduler和Downloader间进用户可配置的控制;

功能:修改、丟弃、新增请求或响应;

7)Spider middleware中间键(用户可编写配置代码)

目的:对请求和爬取项的再处理;

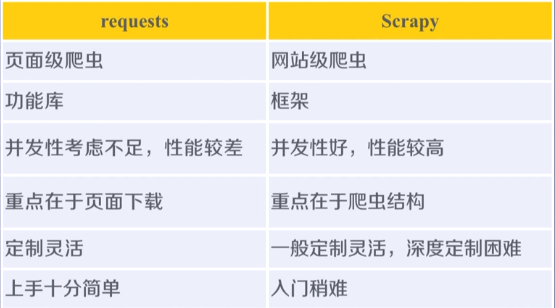

功能:修改、丢弃、新增请求或爬取项。 - requests库和Scrapy爬虫比较

1、相同点

1)两者都可以进行页面请求和爬取, Python爬虫的两个重要技术路线;

2)两者可用性都好,文档丰富,入门简单;

3)两者都没有处理js、提交表单、应对验证码等功能(可扩展)。

2、不同点

3、开发爬虫技术路线选择

1)非常小的需求, requests库。

2)不太小的需求, Scrapy框架。

3)定制程度很高的需求(不考虑规模),自搭框架,requests>Scrapy。 - Scrapy爬虫常用命令

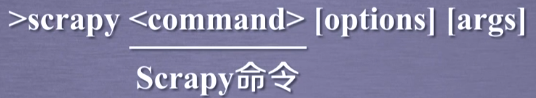

1、Scrapy命令行:Scrapy是为持续运行设计的专业爬虫框架,提供操作的Scrap命令行,打开命令行操作:CMD窗口->scrapy -h。

2、Scrapy命令行格式

3、Scrapy常用命令

最常用:startproject、genspider、crawl

4、为什么 Scrapy采用命令行创建和运行爬虫?

1)命令行(不是图形界面)更容易自动化,适合脚本控制;

2)本质上,Scrapy是给程序员用的,功能(而不是界面)更重要。

● Scrapy爬虫基本使用

- Scrapy爬虫案列讲解

应用Scrapy爬虫框架主要是编写配置型代码

1、产生步骤

步骤1:建立一个Scrapy爬虫工程

选取一个目录(F:\pycodes\),然后执行如下命令:

F:\pycodes>scrapy startprojrct python123demo

Scrapy 1.6.0 - no active project

Unknown command: startprojrct

Use "scrapy" to see available commands

F:\pycodes>scrapy startproject python123demo

New Scrapy project 'python123demo', using template directory 'c:\users\hp\appdata\local\programs\python\python37-32\lib\site-packages\scrapy\templates\project', created in:

F:\pycodes\python123demo

You can start your first spider with:

cd python123demo

scrapy genspider example example.com

步骤2:在工程中产生一个Scrapy爬虫

进入工程目录(F:\pycodes\python123demo),然后执行如下命令:

F:\pycodes\python123demo>scrapy genspider demo python123.io

Spider 'demo' already exists in module:

python123demo.spiders.demo

该命令作用:

1)生成一个名称为demo的spider;

2)在spiders目录下增加代码文件 demo.py;

该命令仅用于生成 demo.py,该文件也可以手工生成。

步骤3:配置产生的spider爬虫

配置:1)初始URL地址;2)获取页面后的解析方式

import scrapy

class DemoSpider(scrapy.Spider):

name = "demo"

#allowed_domains = ["python123.io"]

start_urls = ['https://python123.io/ws/demo.html']

def parse(self, response):

fname = response.url.split('/')[-1]

with open(fname, 'wb') as f:

f.write(response.body)

self.log('Saved file %s.' % name)

步骤4:运行爬虫,获取网页

在命令行下,执行如下命令:demo爬虫被执行,捕获页面存储在demo.html

F:\pycodes\python123demo>scrapy crawl demo

2、生成的工程目录结构

python123demo/ --------------→外层目录

scrap.cfg --------→部署 Scrapy爬虫的配置文件(将爬虫放在特定的服务器,并在服务器配置相关的操作接口)

python 123demo/--------→Scrapy框架的用户自定义 Python代码

_init_.py -------→初始化脚本

items.py -------→Items代码模板(继承类)(一般不需要编写)

middlewares.py----→Middlewares代码模板(继承类)(扩展middlewares功能时编写)

pipelines.py -----→pipelines代码模板(继承类)

settings.py ------→scrap爬虫的配置文件(优化爬虫功能,需修改对应的配置项)

spiders/ -------→Spiders代码模板目录(继承类)(存放工程爬虫,要求其中爬虫符合爬虫模板的约束)

_init_.py —→初始文件,无需修改

_pycache_.py →缓存目录,无需修改

(内层目录结构 用户自定义的spider代码增加在此处)

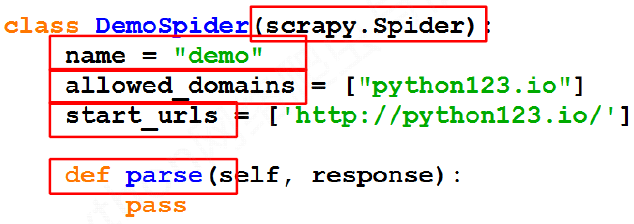

3、工程爬虫模板

1)类必须继承于scrapy.Spider子类;

2)name为当前爬虫名;

3)allowed_domains为提交给命令行的域名,爬虫在爬取网站只能爬取这个域名以下的相关链接;

4) start_urls以列表形式包含的一个或多个url,为scrapy框架最初爬取网址;

5)parse()用于处理响应,解析内容形成字典,发现新的URL爬取请求。

- yield关键字的使用

1、yield←→ 生成器

1)生成器是一个不断产生值的函数;

2)包含yield语句的函数是一个生成器;

3)生成器每次产生一个值(yield语句),函数被冻结,被唤醒后再产生一个值。

2、生成器相比一次列出所有内容的优势:

1)更节省存储空间;

2)响应更迅速;

3)使用更灵活。 - Scrapy爬虫基本使用

1、Scrapy爬虫的使用步骤

步骤1:创建一个工程和Spider模板;

步骤2:编写Spider;

步骤3:编写Item Pipeline;

步骤4:优化配置策略。

2、Scrapy爬虫的数据类型

Request类:class scrapy.http.Request()

Request类介绍:

1)Request对象表示一个HTTP请求;

2)由Spider生成,由Downloader执行。

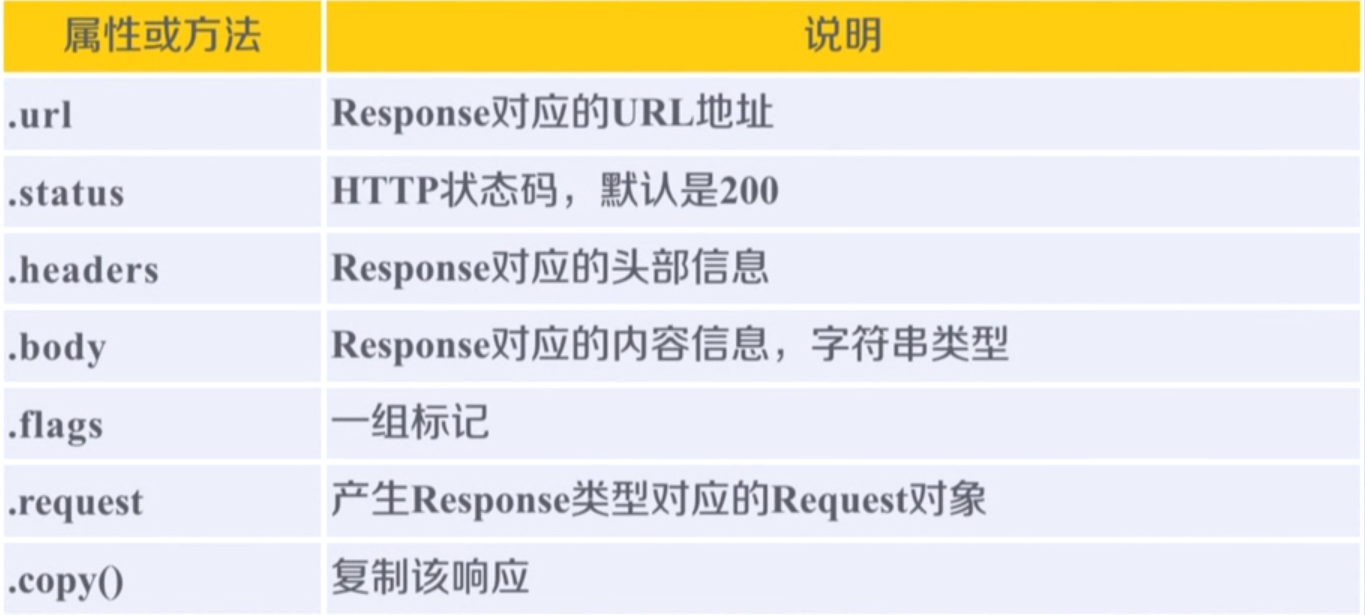

Request类方法 Response类:class scrapy.http.Response()

Response类:class scrapy.http.Response()

Response类介绍:

1)Response对象表示一个HTTP响应;

2)由Downloader生成,由Spider处理。

Response类方法

Item类:class scrapy.item.Item()

Item类:class scrapy.item.Item()

Item类介绍:

1)Item对象表示一个从HTML页面中提取的信息内容;

2)由Spider生成,由Item Pipeline处理;

3)Item类似字典类型,可以按照字典类型操作。

3、Scrapy爬虫支持多种HTML信息提取方法:

• Beautiful Soup

• lxml

• re

• XPath Selector

• CSS Selector

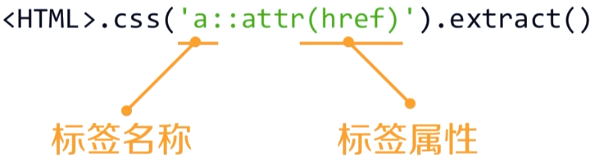

CSS Selector的基本使用

1)格式:

2)CSS Selector由W3C组织维护并规范

● Scrapy爬虫实例

- 股票数据 Scrape爬中实例介绍

1、功能描述

目标:获取上交所和深交所所有股票的名称和交易信息

输出:保存到文件中

技术路线:scrapy

2、数据网站的确定

获取股票列表:

东方财富网:http://quote.eastmoney.com/stocklist.html

获取个股信息:

百度股票:https://gupiao.baidu.com/stock/

单个股票:https://gupiao.baidu.com/stock/sz002439.html

3、程序框架:编写spider处理链接爬取和页面解析,编写pipelines处理信息存储。 - “股票数据 Scrap爬虫实例编写(仅供参考)

步骤

步骤1:建立工程和Spider模板

1)>scrapy startproject BaiduStocks

2)>cd BaiduStocks

3)>scrapy genspider stocks baidu.com

4)进一步修改spiders/stocks.py文件

步骤2:编写Spider

1)配置stocks.py文件

2)对返回页面的处理

3)修改对新增URL爬取请求的处理

stocks.py文件源代码

import scrapy

import re

class StocksSpider(scrapy.Spider):

name = "stocks"

start_urls = ['https://quote.eastmoney.com/stocklist.html']

def parse(self, response):

for href in response.css('a::attr(href)').extract():

try:

stock = re.findall(r"[s][hz]\d{6}", href)[0]

url = 'https://gupiao.baidu.com/stock/' + stock + '.html'

yield scrapy.Request(url, callback=self.parse_stock)

except:

continue

def parse_stock(self, response):

infoDict = {

}

stockInfo = response.css('.stock-bets')

name = stockInfo.css('.bets-name').extract()[0]

keyList = stockInfo.css('dt').extract()

valueList = stockInfo.css('dd').extract()

for i in range(len(keyList)):

key = re.findall(r'>.*</dt>', keyList[i])[0][1:-5]

try:

val = re.findall(r'\d+\.?.*</dd>', valueList[i])[0][0:-5]

except:

val = '--'

infoDict[key]=val

infoDict.update(

{

'股票名称': re.findall('\s.*\(',name)[0].split()[0] + \

re.findall('\>.*\<', name)[0][1:-1]})

yield infoDict

步骤3:编写ITEM Pipelines

1)配置pipelines.py文件

pipelines.py文件源代码

class BaidustocksPipeline(object):

def process_item(self, item, spider):

return item

class BaidustocksInfoPipeline(object):

def open_spider(self, spider):

self.f = open('BaiduStockInfo.txt', 'w')

def close_spider(self, spider):

self.f.close()

def process_item(self, item, spider):

try:

line = str(dict(item)) + '\n'

self.f.write(line)

except:

pass

return item

2)定义对爬取项(Scraped Item)的处理类

3)配置ITEM_PIPELINES选项

settings.py文件中被修改的区域

ITEM_PIPELINES = {

'BaiduStocks.pipelines.BaidustocksInfoPipeline': 300,

}

步骤4:程序的执行:>scrapy crawl stocks

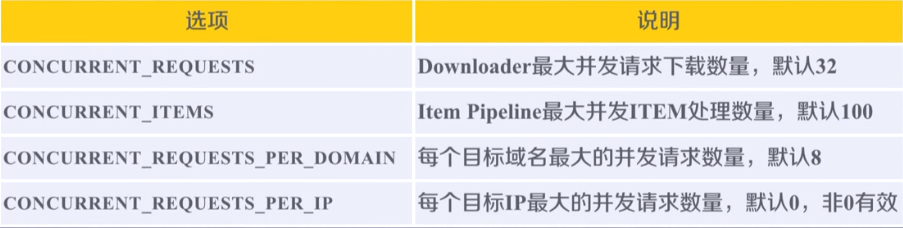

- “股票数据 Scrap爬虫实例优化

配置并发连接选项——settings.py文件

智能推荐

c# 调用c++ lib静态库_c#调用lib-程序员宅基地

文章浏览阅读2w次,点赞7次,收藏51次。四个步骤1.创建C++ Win32项目动态库dll 2.在Win32项目动态库中添加 外部依赖项 lib头文件和lib库3.导出C接口4.c#调用c++动态库开始你的表演...①创建一个空白的解决方案,在解决方案中添加 Visual C++ , Win32 项目空白解决方案的创建:添加Visual C++ , Win32 项目这......_c#调用lib

deepin/ubuntu安装苹方字体-程序员宅基地

文章浏览阅读4.6k次。苹方字体是苹果系统上的黑体,挺好看的。注重颜值的网站都会使用,例如知乎:font-family: -apple-system, BlinkMacSystemFont, Helvetica Neue, PingFang SC, Microsoft YaHei, Source Han Sans SC, Noto Sans CJK SC, W..._ubuntu pingfang

html表单常见操作汇总_html表单的处理程序有那些-程序员宅基地

文章浏览阅读159次。表单表单概述表单标签表单域按钮控件demo表单标签表单标签基本语法结构<form action="处理数据程序的url地址“ method=”get|post“ name="表单名称”></form><!--action,当提交表单时,向何处发送表单中的数据,地址可以是相对地址也可以是绝对地址--><!--method将表单中的数据传送给服务器处理,get方式直接显示在url地址中,数据可以被缓存,且长度有限制;而post方式数据隐藏传输,_html表单的处理程序有那些

PHP设置谷歌验证器(Google Authenticator)实现操作二步验证_php otp 验证器-程序员宅基地

文章浏览阅读1.2k次。使用说明:开启Google的登陆二步验证(即Google Authenticator服务)后用户登陆时需要输入额外由手机客户端生成的一次性密码。实现Google Authenticator功能需要服务器端和客户端的支持。服务器端负责密钥的生成、验证一次性密码是否正确。客户端记录密钥后生成一次性密码。下载谷歌验证类库文件放到项目合适位置(我这边放在项目Vender下面)https://github.com/PHPGangsta/GoogleAuthenticatorPHP代码示例://引入谷_php otp 验证器

【Python】matplotlib.plot画图横坐标混乱及间隔处理_matplotlib更改横轴间距-程序员宅基地

文章浏览阅读4.3k次,点赞5次,收藏11次。matplotlib.plot画图横坐标混乱及间隔处理_matplotlib更改横轴间距

docker — 容器存储_docker 保存容器-程序员宅基地

文章浏览阅读2.2k次。①Storage driver 处理各镜像层及容器层的处理细节,实现了多层数据的堆叠,为用户 提供了多层数据合并后的统一视图②所有 Storage driver 都使用可堆叠图像层和写时复制(CoW)策略③docker info 命令可查看当系统上的 storage driver主要用于测试目的,不建议用于生成环境。_docker 保存容器

随便推点

网络拓扑结构_网络拓扑csdn-程序员宅基地

文章浏览阅读834次,点赞27次,收藏13次。网络拓扑结构是指计算机网络中各组件(如计算机、服务器、打印机、路由器、交换机等设备)及其连接线路在物理布局或逻辑构型上的排列形式。这种布局不仅描述了设备间的实际物理连接方式,也决定了数据在网络中流动的路径和方式。不同的网络拓扑结构影响着网络的性能、可靠性、可扩展性及管理维护的难易程度。_网络拓扑csdn

JS重写Date函数,兼容IOS系统_date.prototype 将所有 ios-程序员宅基地

文章浏览阅读1.8k次,点赞5次,收藏8次。IOS系统Date的坑要创建一个指定时间的new Date对象时,通常的做法是:new Date("2020-09-21 11:11:00")这行代码在 PC 端和安卓端都是正常的,而在 iOS 端则会提示 Invalid Date 无效日期。在IOS年月日中间的横岗许换成斜杠,也就是new Date("2020/09/21 11:11:00")通常为了兼容IOS的这个坑,需要做一些额外的特殊处理,笔者在开发的时候经常会忘了兼容IOS系统。所以就想试着重写Date函数,一劳永逸,避免每次ne_date.prototype 将所有 ios

如何将EXCEL表导入plsql数据库中-程序员宅基地

文章浏览阅读5.3k次。方法一:用PLSQL Developer工具。 1 在PLSQL Developer的sql window里输入select * from test for update; 2 按F8执行 3 打开锁, 再按一下加号. 鼠标点到第一列的列头,使全列成选中状态,然后粘贴,最后commit提交即可。(前提..._excel导入pl/sql

Git常用命令速查手册-程序员宅基地

文章浏览阅读83次。Git常用命令速查手册1、初始化仓库git init2、将文件添加到仓库git add 文件名 # 将工作区的某个文件添加到暂存区 git add -u # 添加所有被tracked文件中被修改或删除的文件信息到暂存区,不处理untracked的文件git add -A # 添加所有被tracked文件中被修改或删除的文件信息到暂存区,包括untracked的文件...

分享119个ASP.NET源码总有一个是你想要的_千博二手车源码v2023 build 1120-程序员宅基地

文章浏览阅读202次。分享119个ASP.NET源码总有一个是你想要的_千博二手车源码v2023 build 1120

【C++缺省函数】 空类默认产生的6个类成员函数_空类默认产生哪些类成员函数-程序员宅基地

文章浏览阅读1.8k次。版权声明:转载请注明出处 http://blog.csdn.net/irean_lau。目录(?)[+]1、缺省构造函数。2、缺省拷贝构造函数。3、 缺省析构函数。4、缺省赋值运算符。5、缺省取址运算符。6、 缺省取址运算符 const。[cpp] view plain copy_空类默认产生哪些类成员函数