VAE异常检测论文复现——Anomaly Detection for Skin Disease Images Using Variational Autoencoder_vaeanomaly-程序员宅基地

技术标签: 论文阅读

VAE异常检测论文复现——Anomaly Detection for Skin Disease Images Using Variational Autoencoder

今天内容是复现论文Anomaly Detection for Skin Disease Images Using Variational Autoencoder当中的实验,因为目前还没有连接到实验室的服务器,我的实验的训练次数只有3次,所以复现的效果可能相对来说要差一些。这一次所面对的数据集是图像数据集,所以主要针对图像数据集的一些操作和处理,以及对于图像数据集其网络结构如何建立做一点总结。

数据集下载

论文所使用的数据集是ISIC2018年比赛用的一个数据集,我是在网址https://challenge.kitware.com/#phase/5abcbc6f56357d0139260e66处下载的相关数据,数据需要注册一个邮箱,然后可以下载training data(包括10015张图片),以及一个csv文件,里面标注了每一张图片的真实分类。

数据集预处理及数据集调用

在下载好了数据集和标签文档之后,先行做了一些预处理工作,将下载的图片(共7类)分别根据他们的标签存入了7个文件夹当中,这样在调用的时候采用以下的一些代码,就可以获取他们的图片数据和图片分类

from torchvision import transforms, datasets

def load_dataset(input_size, data_path, batch_size):#用来载入数据

normalize = transforms.Normalize(

mean=[0.5, 0.5, 0.5],

std=[0.5, 0.5, 0.5])

transform = transforms.Compose([

transforms.Resize((input_size, input_size)),

transforms.ToTensor(),

normalize,

])

train_dataset = datasets.ImageFolder(data_path, transform)

train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=batch_size,shuffle=True)

return train_loader

train_loader = load_dataset(input_size=image_size,data_path=data_path,batch_size=batch_size)

for idx, (image, target) in tqdm(enumerate(traint_loader)):

上述是调用的几句比较核心的语句,首先是在整理数据集的时候,要对其进行transform和normalize,其次是导入的时候的地址应该是7类图片所属文件夹的父文件夹。每一张图片的数据和所属标签可通过遍历的方式,从train_loader当中获得。

深度学习网络结构

Encoding层结构(相对来说在处理图片的时候encoding层的结构是比较复杂的。之前我们处理的主要都是如KDD99这样的文本数据比较多)

ngf = 64

nz = 300

nc = 3

n = math.log2(imageSize)

self.encoder = nn.Sequential()

self.encoder.add_module('input-conv', nn.Conv2d(nc, ngf, 4, 2, 1,

bias=True))

self.encoder.add_module('input-relu', nn.ReLU(inplace=True))

for i in range(n - 3):

# state size. (ngf) x 32 x 32

self.encoder.add_module('pyramid_{0}-{1}_conv'.format(ngf * 2 ** i, ngf * 2 ** (i + 1)),

nn.Conv2d(ngf * 2 ** (i), ngf * 2 ** (i + 1), 4, 2, 1, bias=True))

self.encoder.add_module('pyramid_{0}_batchnorm'.format(ngf * 2 ** (i + 1)),

nn.BatchNorm2d(ngf * 2 ** (i + 1)))

self.encoder.add_module('pyramid_{0}_relu'.format(ngf * 2 ** (i + 1)), nn.ReLU(inplace=True))

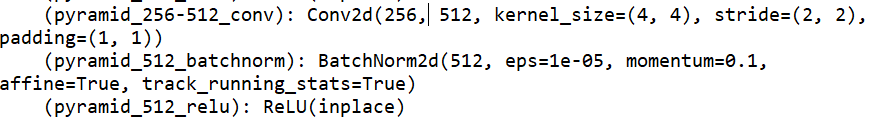

通过打印模型当中的数值,我们可以看出网络的每一层情况都如下:

这里的参数kernel_size是卷积核,stride是步长,padding代表卷积操作是否使图像的大小改变。BatchNorm2d是一个归一化函数,对每个通道进行数据的归一化,最后通过ReLU之后输出到下一个网络层。

self.decoder = nn.Sequential()

# input is Z, going into a convolution

self.decoder.add_module('input-conv', nn.ConvTranspose2d(nz, ngf * 2 ** (n - 3), 4, 1, 0, bias=True))

self.decoder.add_module('input-batchnorm', nn.BatchNorm2d(ngf * 2 ** (n - 3)))

self.decoder.add_module('input-relu', nn.ReLU(inplace=True))

# state size. (ngf * 2**(n-3)) x 4 x 4

for i in range(n - 3, 0, -1):

self.decoder.add_module('pyramid_{0}-{1}_conv'.format(ngf * 2 ** i, ngf * 2 ** (i - 1)),

nn.ConvTranspose2d(

ngf * 2 ** i, ngf * 2 ** (i - 1),

4, 2, 1, bias=True))

self.decoder.add_module('pyramid_{0}_batchnorm'.format(ngf * 2 ** (i - 1)),

nn.BatchNorm2d(ngf * 2 ** (i - 1)))

self.decoder.add_module('pyramid_{0}_relu'.format(ngf * 2 ** (i - 1)), nn.ReLU(inplace=True))

self.decoder.add_module('ouput-conv', nn.ConvTranspose2d(ngf, nc, 4, 2,

1, bias=True))

self.decoder.add_module('output-tanh', nn.Tanh())

Decoder层和Encoder层差不多,重点是关于 μ \mu μ和 σ \sigma σ的选择:

self.conv_mu = nn.Conv2d(ngf * 2 ** (n - 3), nz, 4)

self.conv_logvar = nn.Conv2d(ngf * 2 ** (n - 3), nz, 4)

def encode(self, input):

output = self.encoder(input)

output = output.squeeze(-1).squeeze(-1)

return [self.conv_mu(output), self.conv_logvar(output)]

def reparameterize(self, mu, logvar):

std = torch.exp(0.5 * logvar)

eps = torch.randn_like(std)

return eps.mul(std).add_(mu)

def decode(self, z):

return self.decoder(z)

def forward(self, x):

mu, logvar = self.encode(x)

z = self.reparameterize(mu, logvar)

return self.decode(z), \

mu.squeeze(-1).squeeze(-1), \

logvar.squeeze(-1).squeeze(-1)

Loss函数的选择

关于标准VAE做法的loss函数的选择已经比较熟悉了,这里重点讲一下作者提到的一种叫做iWAE的算法,这种算法是源于论文Importance Weighted Autoencoders,其算法的核心是选择了k个 z i z_i zi,算了其加权平均之后的值作为结果。这里我们的相应代码如下:

def _log_mean_exp(x, dim):

m, _ = torch.max(x, dim=dim, keepdim=True)

x0 = x - m

m = m.squeeze(dim)

return m + torch.log(torch.mean(torch.exp(x0),

dim=dim))

def get_iwae_score(vae, image, L=5):

image_batch = image.expand(L,

image.size(1),

image.size(2),

image.size(3))

mu, logvar = vae.encode(image_batch)

eps = torch.randn_like(mu)

z = mu + eps * torch.exp(0.5 * logvar)

kl_weight = criterion.kl_weight

reconst = vae.decode(z)

log_p_x_z = -torch.sum((reconst - image_batch).pow(2).reshape(L, -1),

dim=1)

log_p_z = -torch.sum(z.pow(2).reshape(L, -1), dim=1)

log_q_z = -torch.sum(eps.pow(2).reshape(L, -1), dim=1)

iwae_score = -_log_mean_exp(log_p_x_z + (log_p_z - log_q_z)*kl_weight, dim=0)

iwae_KL_score = -_log_mean_exp(log_p_z - log_q_z, dim=0)

iwae_reconst_score = -_log_mean_exp(log_p_x_z, dim=0)

return iwae_score, iwae_KL_score, iwae_reconst_score

class VAELoss(nn.Module):

def __init__(self, size_average=False, kl_weight=1):

super(VAELoss, self).__init__()

self.size_average = size_average

self.kl_weight = kl_weight

def forward(self, recon_x, x, mu, logvar):

bsz = x.shape[0]

reconst_err = (x - recon_x).pow(2).reshape(bsz, -1)

reconst_err = 0.5 * torch.sum(reconst_err, dim=-1)

# KL(q || p) = -log_sigma + sigma^2/2 + mu^2/2 - 1/2

KL = (-logvar + logvar.exp() + mu.pow(2) - 1) * 0.5

KL = torch.sum(KL, dim=-1)

if self.size_average:

KL = torch.mean(KL)

reconst_err = torch.mean(reconst_err)

else:

KL = torch.sum(KL)

reconst_err = torch.sum(reconst_err)

loss = reconst_err + self.kl_weight * KL

return loss, {

'KL': KL, 'reconst_logp': -reconst_err}

实验结果

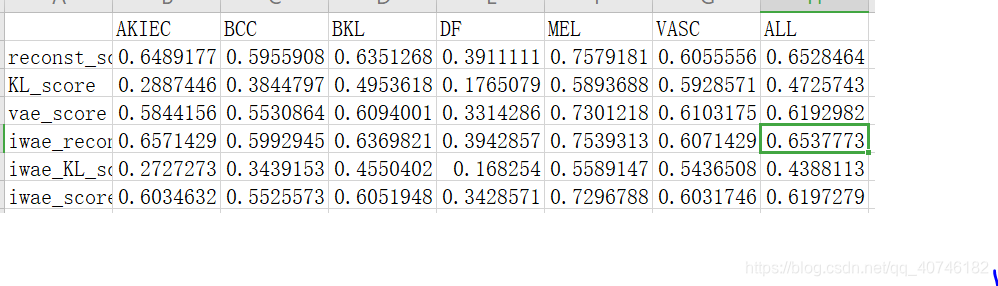

因为整体训练只进行了三次,结果可能没有论文结果那么好,另外和论文取样也有一定的不同,很难做出完整的一样的结果。最终实验结果如下:

智能推荐

while循环&CPU占用率高问题深入分析与解决方案_main函数使用while(1)循环cpu占用99-程序员宅基地

文章浏览阅读3.8k次,点赞9次,收藏28次。直接上一个工作中碰到的问题,另外一个系统开启多线程调用我这边的接口,然后我这边会开启多线程批量查询第三方接口并且返回给调用方。使用的是两三年前别人遗留下来的方法,放到线上后发现确实是可以正常取到结果,但是一旦调用,CPU占用就直接100%(部署环境是win server服务器)。因此查看了下相关的老代码并使用JProfiler查看发现是在某个while循环的时候有问题。具体项目代码就不贴了,类似于下面这段代码。while(flag) {//your code;}这里的flag._main函数使用while(1)循环cpu占用99

【无标题】jetbrains idea shift f6不生效_idea shift +f6快捷键不生效-程序员宅基地

文章浏览阅读347次。idea shift f6 快捷键无效_idea shift +f6快捷键不生效

node.js学习笔记之Node中的核心模块_node模块中有很多核心模块,以下不属于核心模块,使用时需下载的是-程序员宅基地

文章浏览阅读135次。Ecmacript 中没有DOM 和 BOM核心模块Node为JavaScript提供了很多服务器级别,这些API绝大多数都被包装到了一个具名和核心模块中了,例如文件操作的 fs 核心模块 ,http服务构建的http 模块 path 路径操作模块 os 操作系统信息模块// 用来获取机器信息的var os = require('os')// 用来操作路径的var path = require('path')// 获取当前机器的 CPU 信息console.log(os.cpus._node模块中有很多核心模块,以下不属于核心模块,使用时需下载的是

数学建模【SPSS 下载-安装、方差分析与回归分析的SPSS实现(软件概述、方差分析、回归分析)】_化工数学模型数据回归软件-程序员宅基地

文章浏览阅读10w+次,点赞435次,收藏3.4k次。SPSS 22 下载安装过程7.6 方差分析与回归分析的SPSS实现7.6.1 SPSS软件概述1 SPSS版本与安装2 SPSS界面3 SPSS特点4 SPSS数据7.6.2 SPSS与方差分析1 单因素方差分析2 双因素方差分析7.6.3 SPSS与回归分析SPSS回归分析过程牙膏价格问题的回归分析_化工数学模型数据回归软件

利用hutool实现邮件发送功能_hutool发送邮件-程序员宅基地

文章浏览阅读7.5k次。如何利用hutool工具包实现邮件发送功能呢?1、首先引入hutool依赖<dependency> <groupId>cn.hutool</groupId> <artifactId>hutool-all</artifactId> <version>5.7.19</version></dependency>2、编写邮件发送工具类package com.pc.c..._hutool发送邮件

docker安装elasticsearch,elasticsearch-head,kibana,ik分词器_docker安装kibana连接elasticsearch并且elasticsearch有密码-程序员宅基地

文章浏览阅读867次,点赞2次,收藏2次。docker安装elasticsearch,elasticsearch-head,kibana,ik分词器安装方式基本有两种,一种是pull的方式,一种是Dockerfile的方式,由于pull的方式pull下来后还需配置许多东西且不便于复用,个人比较喜欢使用Dockerfile的方式所有docker支持的镜像基本都在https://hub.docker.com/docker的官网上能找到合..._docker安装kibana连接elasticsearch并且elasticsearch有密码

随便推点

Python 攻克移动开发失败!_beeware-程序员宅基地

文章浏览阅读1.3w次,点赞57次,收藏92次。整理 | 郑丽媛出品 | CSDN(ID:CSDNnews)近年来,随着机器学习的兴起,有一门编程语言逐渐变得火热——Python。得益于其针对机器学习提供了大量开源框架和第三方模块,内置..._beeware

Swift4.0_Timer 的基本使用_swift timer 暂停-程序员宅基地

文章浏览阅读7.9k次。//// ViewController.swift// Day_10_Timer//// Created by dongqiangfei on 2018/10/15.// Copyright 2018年 飞飞. All rights reserved.//import UIKitclass ViewController: UIViewController { ..._swift timer 暂停

元素三大等待-程序员宅基地

文章浏览阅读986次,点赞2次,收藏2次。1.硬性等待让当前线程暂停执行,应用场景:代码执行速度太快了,但是UI元素没有立马加载出来,造成两者不同步,这时候就可以让代码等待一下,再去执行找元素的动作线程休眠,强制等待 Thread.sleep(long mills)package com.example.demo;import org.junit.jupiter.api.Test;import org.openqa.selenium.By;import org.openqa.selenium.firefox.Firefox.._元素三大等待

Java软件工程师职位分析_java岗位分析-程序员宅基地

文章浏览阅读3k次,点赞4次,收藏14次。Java软件工程师职位分析_java岗位分析

Java:Unreachable code的解决方法_java unreachable code-程序员宅基地

文章浏览阅读2k次。Java:Unreachable code的解决方法_java unreachable code

标签data-*自定义属性值和根据data属性值查找对应标签_如何根据data-*属性获取对应的标签对象-程序员宅基地

文章浏览阅读1w次。1、html中设置标签data-*的值 标题 11111 222222、点击获取当前标签的data-url的值$('dd').on('click', function() { var urlVal = $(this).data('ur_如何根据data-*属性获取对应的标签对象