ElasticJob - 任务执行过程解析_手动调用esjob simplejob-程序员宅基地

技术标签: elasticjob Elastic-Job elastic

ElasticJob是基于Quartz实现的弹性分布式任务调度框架,整个任务触发的底层是Quartz来触发。LiteJob框架触发任务执行的开始,下面来分析任务的执行过程。

public final class LiteJob implements Job {

@Override

public void execute(final JobExecutionContext context) throws JobExecutionException {

//根据任务类型获取执行器,SimpleJobExecutor

JobExecutorFactory.getJobExecutor(elasticJob, jobFacade).execute();

}

}

ElasticJob根据任务的作业类型,获取不同的作业执行器,这里以SimpleJobExecutor为例。它继承了AbstractElasticJobExecutor,它是所有任务执行流程的模板类。

protected AbstractElasticJobExecutor(final JobFacade jobFacade) {

this.jobFacade = jobFacade;

jobRootConfig = jobFacade.loadJobRootConfiguration(true);

jobName = jobRootConfig.getTypeConfig().getCoreConfig().getJobName();

executorService = ExecutorServiceHandlerRegistry.getExecutorServiceHandler(jobName, (ExecutorServiceHandler) getHandler(JobProperties.JobPropertiesEnum.EXECUTOR_SERVICE_HANDLER));

jobExceptionHandler = (JobExceptionHandler) getHandler(JobProperties.JobPropertiesEnum.JOB_EXCEPTION_HANDLER);

itemErrorMessages = new ConcurrentHashMap<>(jobRootConfig.getTypeConfig().getCoreConfig().getShardingTotalCount(), 1);

}

在构造方法里面,是根据JobName为每个Job实例初始化了一个任务执行线程池,就是一个普通的ThreadPoolExecutor封装。下面分析下任务执行的流程:

public void execute() {

try {

//TODO 检验作业服务器和zk服务器系统时差是否可忍受,默认是不开启检查的

jobFacade.checkJobExecutionEnvironment();

} catch (final JobExecutionEnvironmentException cause) {

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

//TODO 获取分片的上下文信息

ShardingContexts shardingContexts = jobFacade.getShardingContexts();

jobFacade.postJobStatusTraceEvent(shardingContexts.getTaskId(), State.TASK_STAGING, String.format("Job '%s' execute begin.", jobConfig.getJobName()));

//TODO 查看当前任务是否有分片正在执行,就创建节点/sharding/{item}/misfire

if (jobFacade.misfireIfRunning(shardingContexts.getShardingItemParameters().keySet())) {

jobFacade.postJobStatusTraceEvent(shardingContexts.getTaskId(), State.TASK_FINISHED, String.format(

"Previous job '%s' - shardingItems '%s' is still running, misfired job will start after previous job completed.", jobConfig.getJobName(),

shardingContexts.getShardingItemParameters().keySet()));

return;

}

try {

//TODO 任务开始执行,这里会去执行业务配置的监听器ElasticJobListener

jobFacade.beforeJobExecuted(shardingContexts);

//CHECKSTYLE:OFF

} catch (final Throwable cause) {

//CHECKSTYLE:ON

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

//TODO 任务的执行处理

execute(shardingContexts, ExecutionSource.NORMAL_TRIGGER);

//TODO 任务是否有错过执行,重新出发调度一次

while (jobFacade.isExecuteMisfired(shardingContexts.getShardingItemParameters().keySet())) {

jobFacade.clearMisfire(shardingContexts.getShardingItemParameters().keySet());

execute(shardingContexts, ExecutionSource.MISFIRE);

}

//TODO 执行故障转移,防止未及时故障转移吧,其实有个listener在监控,为什么这里还要手动执行下 故障转移

jobFacade.failoverIfNecessary();

try {

//TODO 任务执行完成,这里是去触发业务配置的监听器的执行

jobFacade.afterJobExecuted(shardingContexts);

//CHECKSTYLE:OFF

} catch (final Throwable cause) {

//CHECKSTYLE:ON

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

}

- Job节点服务器和zookeeper时钟差校验,对应的是Job的maxTimeDiffSeconds最大始终差配置,默认是-1不检查

try {

//TODO 检验作业服务器和zk服务器系统时差是否可忍受,默认是不开启检查的

jobFacade.checkJobExecutionEnvironment();

} catch (final JobExecutionEnvironmentException cause) {

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

public void checkMaxTimeDiffSecondsTolerable() throws JobExecutionEnvironmentException {

int maxTimeDiffSeconds = load(true).getMaxTimeDiffSeconds();

if (-1 == maxTimeDiffSeconds) {

return;

}

long timeDiff = Math.abs(timeService.getCurrentMillis() - jobNodeStorage.getRegistryCenterTime());

if (timeDiff > maxTimeDiffSeconds * 1000L) {

throw new JobExecutionEnvironmentException(

"Time different between job server and register center exceed '%s' seconds, max time different is '%s' seconds.", timeDiff / 1000, maxTimeDiffSeconds);

}

}

- 获取当前节点服务器的分片信息,这里是分片的关键,在分片那节再细说,这里大概说下做的事情。如果Job配置了故障转移并且存在故障转移分片,优先执行从其它故障节点转移到当前节点服务器的分片。如果需要重新分片,则执行重新分片逻辑,获取分配到当前节点的分片信息。

public ShardingContexts getShardingContexts() {

boolean isFailover = configService.load(true).isFailover();

if (isFailover) {

//TODO 获取故障转移到当前节点的分片信息

List<Integer> failoverShardingItems = failoverService.getLocalFailoverItems();

if (!failoverShardingItems.isEmpty()) {

//TODO 获取故障转移分片信息

return executionContextService.getJobShardingContext(failoverShardingItems);

}

}

shardingService.shardingIfNecessary();

List<Integer> shardingItems = shardingService.getLocalShardingItems();

if (isFailover) {

//TODO 删除本节点被故障转移的分片信息

shardingItems.removeAll(failoverService.getLocalTakeOffItems());

}

shardingItems.removeAll(executionService.getDisabledItems(shardingItems));

return executionContextService.getJobShardingContext(shardingItems);

}

-

当前节点服务器该job对应的所有分片,是否有执行中的分片, 只要有一个执行中的分片,则对应的所有分片都会被设置为misfire错失执行,然后退出。 就是上次触发的执行没有完成,本次触发不会执行,会等待上次执行完成,防止任务分片在当前节点被重复执行。

//TODO 查看当前任务是否有分片正在执行,就创建节点/sharding/{item}/misfire

if (jobFacade.misfireIfRunning(shardingContexts.getShardingItemParameters().keySet())) {

jobFacade.postJobStatusTraceEvent(shardingContexts.getTaskId(), State.TASK_FINISHED, String.format(

"Previous job '%s' - shardingItems '%s' is still running, misfired job will start after previous job completed.", jobConfig.getJobName(),

shardingContexts.getShardingItemParameters().keySet()));

return;

}

public boolean misfireIfHasRunningItems(final Collection<Integer> items) {

if (!hasRunningItems(items)) {

return false;

}

//TODO 只要其中一个分片没有执行完成,就会设置misfire

setMisfire(items);

return true;

}

public boolean hasRunningItems(final Collection<Integer> items) {

JobConfiguration jobConfig = configService.load(true);

if (!jobConfig.isMonitorExecution()) {

return false;

}

for (int each : items) {

//TODO 只要其中一个分片没有执行完成,就会设置misfire

if (jobNodeStorage.isJobNodeExisted(ShardingNode.getRunningNode(each))) {

return true;

}

}

return false;

}

- 执行任务之前对应的ElasticJobListener,这个是之前在配置Job任务时对应的ElasticJobListener。

try {

//TODO 任务开始执行,这里会去执行业务配置的监听器ElasticJobListener

jobFacade.beforeJobExecuted(shardingContexts);

//CHECKSTYLE:OFF

} catch (final Throwable cause) {

//CHECKSTYLE:ON

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

- 具体任务分片的调度执行,在分片任务执行前,在当前节点服务器把任务在内存中设置为running状态,如果配置了幂等机制,同时也会在zookeeper中创建/sharding/{item}/running临时节点,在服务器宕机该节点就会自动删除了。然后就是把所有的分片任务提交到ThreadPoolExecutor中执行。这里使用的CountDownLatch控制并发等待所有的分片任务都完成,然后就删除任务执行钱创建的/sharding/{item}/running节点。同时如果开启了故障转移机制,就会删除之前创建的故障转移节点/sharding/{item}/failover

//TODO 任务的执行处理

execute(shardingContexts, ExecutionSource.NORMAL_TRIGGER);

private void execute(final ShardingContexts shardingContexts, final ExecutionSource executionSource) {

if (shardingContexts.getShardingItemParameters().isEmpty()) {

jobFacade.postJobStatusTraceEvent(shardingContexts.getTaskId(), State.TASK_FINISHED, String.format("Sharding item for job '%s' is empty.", jobConfig.getJobName()));

return;

}

//TODO 将当前任务设置为运行中Running的状态,分为内存状态和zk状态,在zk中创建一个临时节点

jobFacade.registerJobBegin(shardingContexts);

String taskId = shardingContexts.getTaskId();

jobFacade.postJobStatusTraceEvent(taskId, State.TASK_RUNNING, "");

try {

process(shardingContexts, executionSource);

} finally {

// TODO Consider increasing the status of job failure, and how to handle the overall loop of job failure

//TODO 清除job的running状态和删除故障转移节点/sharding/{item}/failover

jobFacade.registerJobCompleted(shardingContexts);

if (itemErrorMessages.isEmpty()) {

jobFacade.postJobStatusTraceEvent(taskId, State.TASK_FINISHED, "");

} else {

jobFacade.postJobStatusTraceEvent(taskId, State.TASK_ERROR, itemErrorMessages.toString());

}

}

}

private void process(final ShardingContexts shardingContexts, final ExecutionSource executionSource) {

Collection<Integer> items = shardingContexts.getShardingItemParameters().keySet();

if (1 == items.size()) {

int item = shardingContexts.getShardingItemParameters().keySet().iterator().next();

JobExecutionEvent jobExecutionEvent = new JobExecutionEvent(IpUtils.getHostName(), IpUtils.getIp(), shardingContexts.getTaskId(), jobConfig.getJobName(), executionSource, item);

process(shardingContexts, item, jobExecutionEvent);

return;

}

CountDownLatch latch = new CountDownLatch(items.size());

for (int each : items) {

JobExecutionEvent jobExecutionEvent = new JobExecutionEvent(IpUtils.getHostName(), IpUtils.getIp(), shardingContexts.getTaskId(), jobConfig.getJobName(), executionSource, each);

if (executorService.isShutdown()) {

return;

}

executorService.submit(() -> {

try {

process(shardingContexts, each, jobExecutionEvent);

} finally {

latch.countDown();

}

});

}

try {

latch.await();

} catch (final InterruptedException ex) {

Thread.currentThread().interrupt();

}

}

- 检查是否有任务分片错过执行,这里的判断是开启了misfire任务错过机制并且分片存在/sharding/{item}/misfire节点。如果开启了任务错过机制,并且有任务错过执行,这里会重新执行一次分片节点任务。任务执行之前清除了/sharding/{item}/misfire节点。

//TODO 任务是否有错过执行,重新出发调度一次

while (jobFacade.isExecuteMisfired(shardingContexts.getShardingItemParameters().keySet())) {

jobFacade.clearMisfire(shardingContexts.getShardingItemParameters().keySet());

execute(shardingContexts, ExecutionSource.MISFIRE);

}

- 在这里再手动执行下故障转移操作, 在这里不知道为啥还需要手动执行下故障转移,在故障转移监听器里面就能监听到,为啥这里还要在任务执行的时候再手动触发下???没太理解

//TODO 执行故障转移,防止未及时故障转移吧,其实有个listener在监控,为什么这里还要手动执行下 故障转移

jobFacade.failoverIfNecessary();

- 任务分片执行完之后,触发业务给任务配置的监听器的执行

try {

//TODO 任务执行完成,这里是去触发业务配置的监听器的执行

jobFacade.afterJobExecuted(shardingContexts);

//CHECKSTYLE:OFF

} catch (final Throwable cause) {

//CHECKSTYLE:ON

jobErrorHandler.handleException(jobConfig.getJobName(), cause);

}

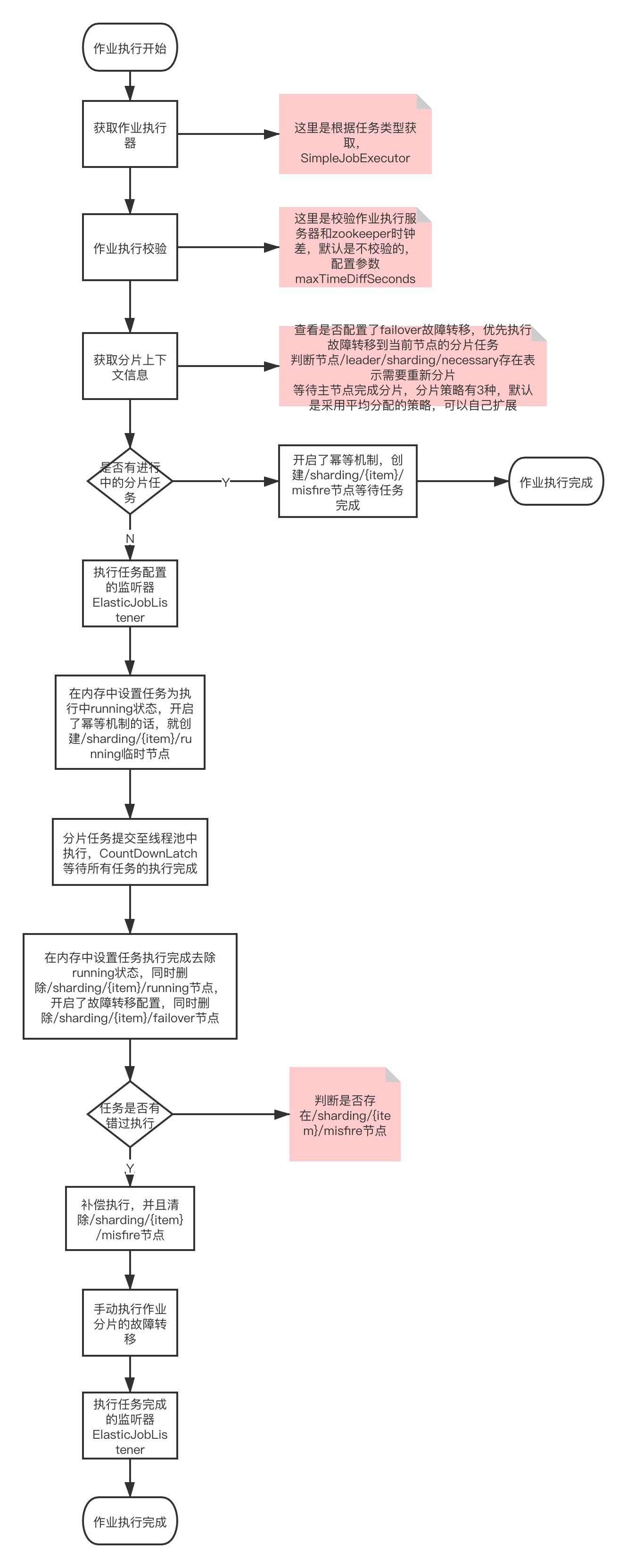

作业执行流程图:

ElasticJob作业执行流程图

智能推荐

c# 调用c++ lib静态库_c#调用lib-程序员宅基地

文章浏览阅读2w次,点赞7次,收藏51次。四个步骤1.创建C++ Win32项目动态库dll 2.在Win32项目动态库中添加 外部依赖项 lib头文件和lib库3.导出C接口4.c#调用c++动态库开始你的表演...①创建一个空白的解决方案,在解决方案中添加 Visual C++ , Win32 项目空白解决方案的创建:添加Visual C++ , Win32 项目这......_c#调用lib

deepin/ubuntu安装苹方字体-程序员宅基地

文章浏览阅读4.6k次。苹方字体是苹果系统上的黑体,挺好看的。注重颜值的网站都会使用,例如知乎:font-family: -apple-system, BlinkMacSystemFont, Helvetica Neue, PingFang SC, Microsoft YaHei, Source Han Sans SC, Noto Sans CJK SC, W..._ubuntu pingfang

html表单常见操作汇总_html表单的处理程序有那些-程序员宅基地

文章浏览阅读159次。表单表单概述表单标签表单域按钮控件demo表单标签表单标签基本语法结构<form action="处理数据程序的url地址“ method=”get|post“ name="表单名称”></form><!--action,当提交表单时,向何处发送表单中的数据,地址可以是相对地址也可以是绝对地址--><!--method将表单中的数据传送给服务器处理,get方式直接显示在url地址中,数据可以被缓存,且长度有限制;而post方式数据隐藏传输,_html表单的处理程序有那些

PHP设置谷歌验证器(Google Authenticator)实现操作二步验证_php otp 验证器-程序员宅基地

文章浏览阅读1.2k次。使用说明:开启Google的登陆二步验证(即Google Authenticator服务)后用户登陆时需要输入额外由手机客户端生成的一次性密码。实现Google Authenticator功能需要服务器端和客户端的支持。服务器端负责密钥的生成、验证一次性密码是否正确。客户端记录密钥后生成一次性密码。下载谷歌验证类库文件放到项目合适位置(我这边放在项目Vender下面)https://github.com/PHPGangsta/GoogleAuthenticatorPHP代码示例://引入谷_php otp 验证器

【Python】matplotlib.plot画图横坐标混乱及间隔处理_matplotlib更改横轴间距-程序员宅基地

文章浏览阅读4.3k次,点赞5次,收藏11次。matplotlib.plot画图横坐标混乱及间隔处理_matplotlib更改横轴间距

docker — 容器存储_docker 保存容器-程序员宅基地

文章浏览阅读2.2k次。①Storage driver 处理各镜像层及容器层的处理细节,实现了多层数据的堆叠,为用户 提供了多层数据合并后的统一视图②所有 Storage driver 都使用可堆叠图像层和写时复制(CoW)策略③docker info 命令可查看当系统上的 storage driver主要用于测试目的,不建议用于生成环境。_docker 保存容器

随便推点

网络拓扑结构_网络拓扑csdn-程序员宅基地

文章浏览阅读834次,点赞27次,收藏13次。网络拓扑结构是指计算机网络中各组件(如计算机、服务器、打印机、路由器、交换机等设备)及其连接线路在物理布局或逻辑构型上的排列形式。这种布局不仅描述了设备间的实际物理连接方式,也决定了数据在网络中流动的路径和方式。不同的网络拓扑结构影响着网络的性能、可靠性、可扩展性及管理维护的难易程度。_网络拓扑csdn

JS重写Date函数,兼容IOS系统_date.prototype 将所有 ios-程序员宅基地

文章浏览阅读1.8k次,点赞5次,收藏8次。IOS系统Date的坑要创建一个指定时间的new Date对象时,通常的做法是:new Date("2020-09-21 11:11:00")这行代码在 PC 端和安卓端都是正常的,而在 iOS 端则会提示 Invalid Date 无效日期。在IOS年月日中间的横岗许换成斜杠,也就是new Date("2020/09/21 11:11:00")通常为了兼容IOS的这个坑,需要做一些额外的特殊处理,笔者在开发的时候经常会忘了兼容IOS系统。所以就想试着重写Date函数,一劳永逸,避免每次ne_date.prototype 将所有 ios

如何将EXCEL表导入plsql数据库中-程序员宅基地

文章浏览阅读5.3k次。方法一:用PLSQL Developer工具。 1 在PLSQL Developer的sql window里输入select * from test for update; 2 按F8执行 3 打开锁, 再按一下加号. 鼠标点到第一列的列头,使全列成选中状态,然后粘贴,最后commit提交即可。(前提..._excel导入pl/sql

Git常用命令速查手册-程序员宅基地

文章浏览阅读83次。Git常用命令速查手册1、初始化仓库git init2、将文件添加到仓库git add 文件名 # 将工作区的某个文件添加到暂存区 git add -u # 添加所有被tracked文件中被修改或删除的文件信息到暂存区,不处理untracked的文件git add -A # 添加所有被tracked文件中被修改或删除的文件信息到暂存区,包括untracked的文件...

分享119个ASP.NET源码总有一个是你想要的_千博二手车源码v2023 build 1120-程序员宅基地

文章浏览阅读202次。分享119个ASP.NET源码总有一个是你想要的_千博二手车源码v2023 build 1120

【C++缺省函数】 空类默认产生的6个类成员函数_空类默认产生哪些类成员函数-程序员宅基地

文章浏览阅读1.8k次。版权声明:转载请注明出处 http://blog.csdn.net/irean_lau。目录(?)[+]1、缺省构造函数。2、缺省拷贝构造函数。3、 缺省析构函数。4、缺省赋值运算符。5、缺省取址运算符。6、 缺省取址运算符 const。[cpp] view plain copy_空类默认产生哪些类成员函数