4用于cifar10的卷积神经网络-4.25/4.26Tensorflow中的四种学习率衰减方法(上/下)_final learning rate-程序员宅基地

技术标签: TensorFlow中级教程

TensorFlow中的可变学习率

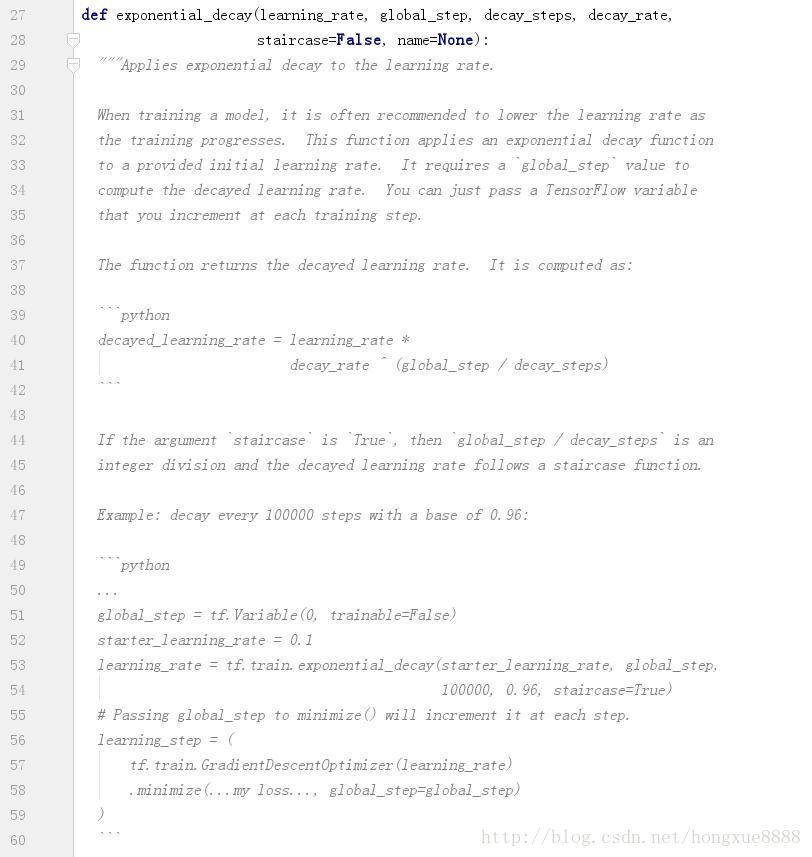

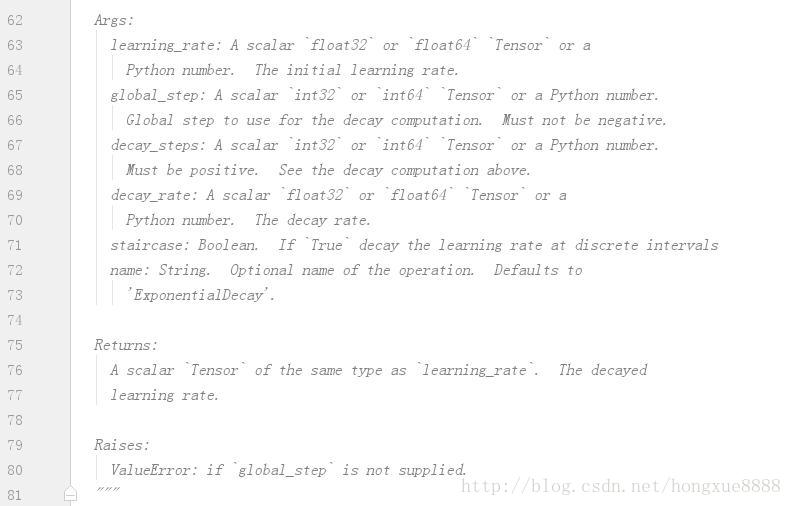

1、exponential_decay指数式衰减:

功能:对输入学习率learning rate实现指数衰减。

当我们训练一个模型的时候,经常需要根据训练过程的进展来逐渐降低学习率。上面的函数把一个指数衰减函数应用到初始学习率上以达到在训练过程中不断减少学习率。它需要一个“global step”值来计算衰减以后的学习率。你可以传入一个TensorFlow variable,只要这个Variable在每个训练步都自增就可以啦。

更新公式:

decayed_learning_rate = learning_rate *

decay_rate ^ (global_step / decay_steps)如果参数‘staircase ’为true,那么‘global_step/decay_step’是一个整数除法,衰减后的学习率是一个阶梯状的函数。

示例代码:以0.1的初始学习率开始,每隔100000步衰减一下,衰减速率:0.96

global_step = tf.Variable(0, trainable=False)

starter_learning_rate = 0.1

learning_rate = tf.train.exponential_decay(starter_learning_rate, global_step,

100000, 0.96, staircase=True)

# Passing global_step to minimize() will increment it at each step.

learning_step = (

tf.train.GradientDescentOptimizer(learning_rate)

.minimize(...my loss..., global_step=global_step)

)参数:

learning_rate : 初始的learning rate

global_step : 全局的step,与 decay_step 和 decay_rate一起决定了 learning rate的变化。

staircase : 如果为 True global_step/decay_step 向下取整

decayed_learning_rate为每一轮优化时使用的学习率;

learning_rate为事先设定的初始学习率;

decay_rate为衰减系数;

decay_steps为衰减速度。

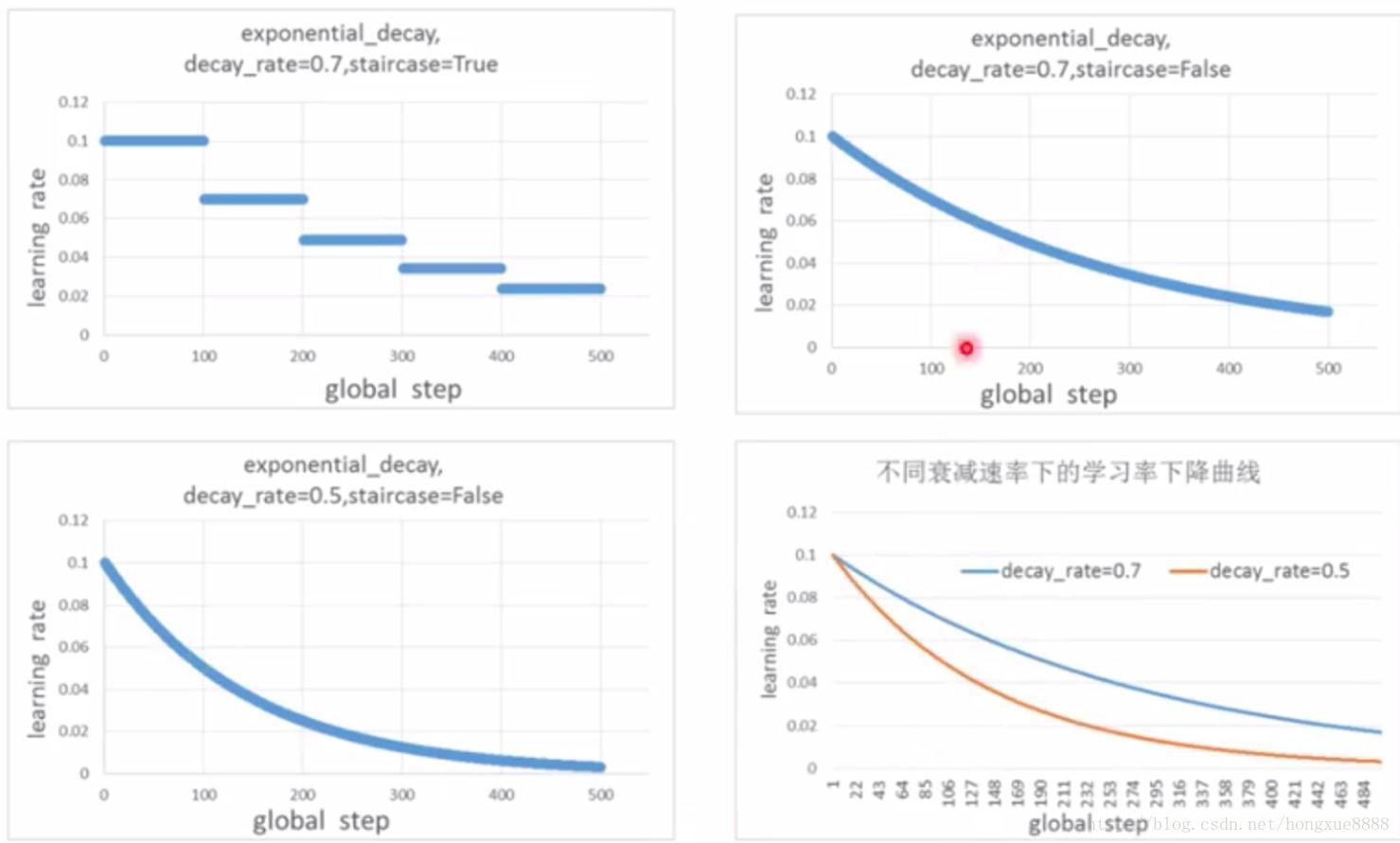

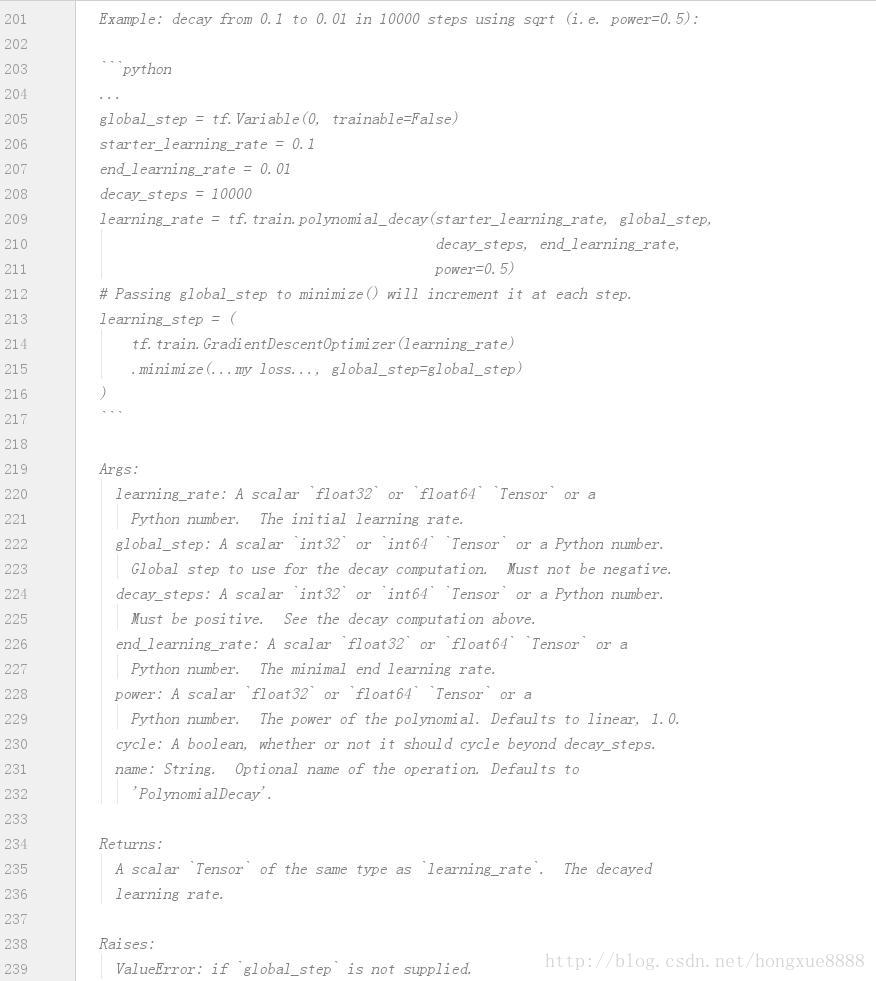

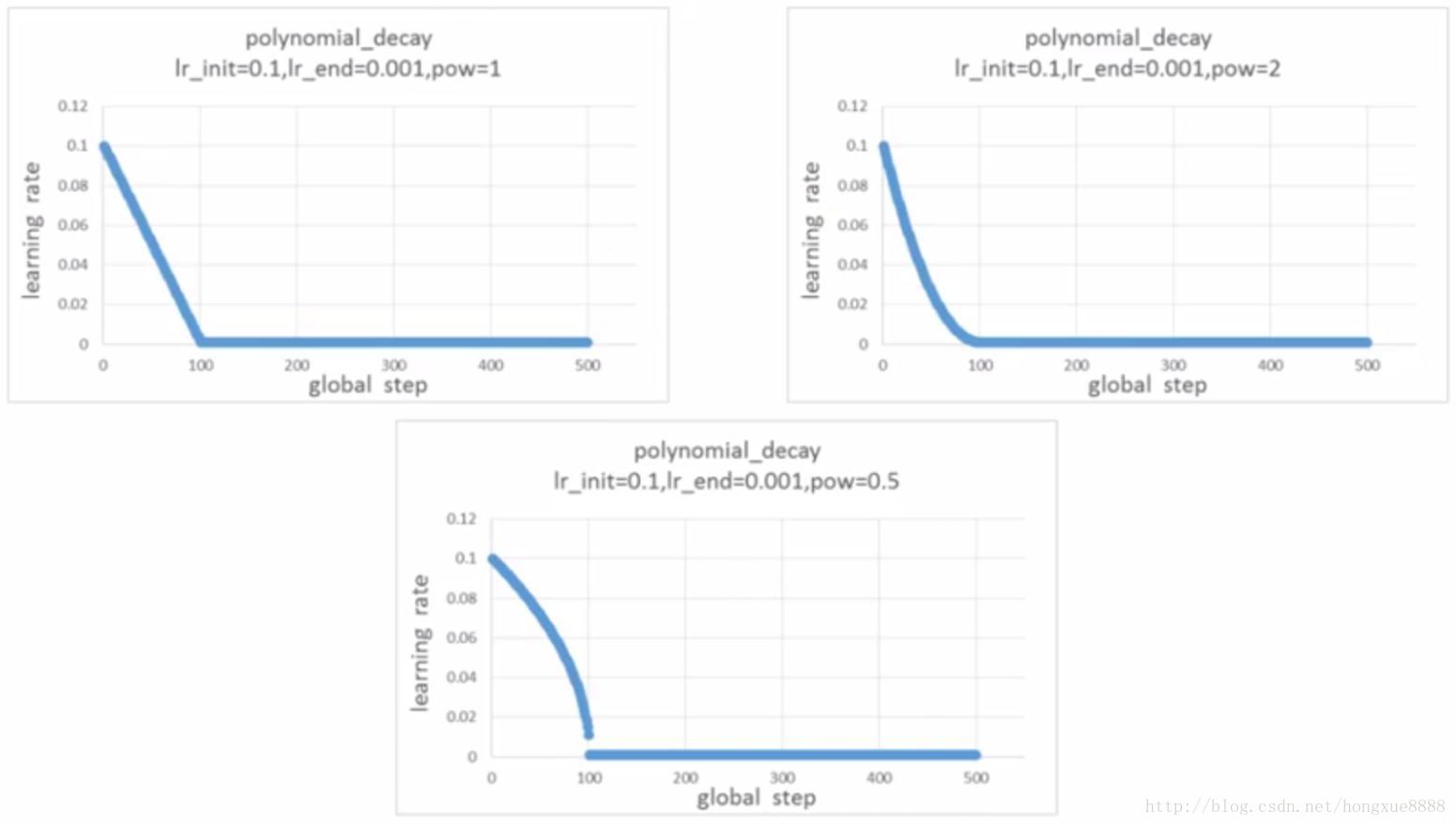

2、polynomial_decay多项式衰减:

功能:对输入学习率learning rate实施多项式衰减

大量的实验观察表明:通过精心的选择学习率的单调下降速率,可以获得一个性能更好地模型。这个函数使用一个多项式衰减函数使得学习率从指定的初始值(‘learning_rate’)经过指定的步数(‘decay_steps’)单调下降到指定的结束值(‘end_learning_rate’)

衰减以后的学习率是如下计算的:

python

global_step = min(global_step, decay_steps)

decayed_learning_rate = (learning_rate - end_learning_rate) *

(1 - global_step / decay_steps) ^ (power) +

end_learning_rate示例代码:decay from 0.1 to 0.01 in 10000 steps using sqrt (i.e. power=0.5):

python

...

global_step = tf.Variable(0, trainable=False)

starter_learning_rate = 0.1

end_learning_rate = 0.01

decay_steps = 10000

learning_rate = tf.train.polynomial_decay(starter_learning_rate, global_step,

decay_steps, end_learning_rate,

power=0.5)

# Passing global_step to minimize() will increment it at each step.

learning_step = (

tf.train.GradientDescentOptimizer(learning_rate)

.minimize(...my loss..., global_step=global_step)

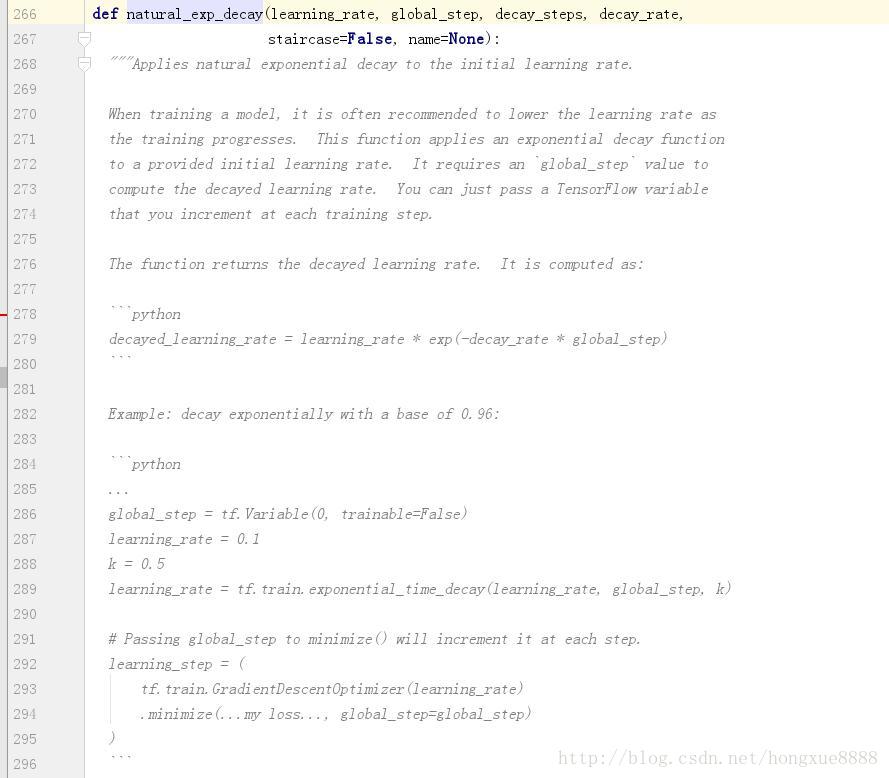

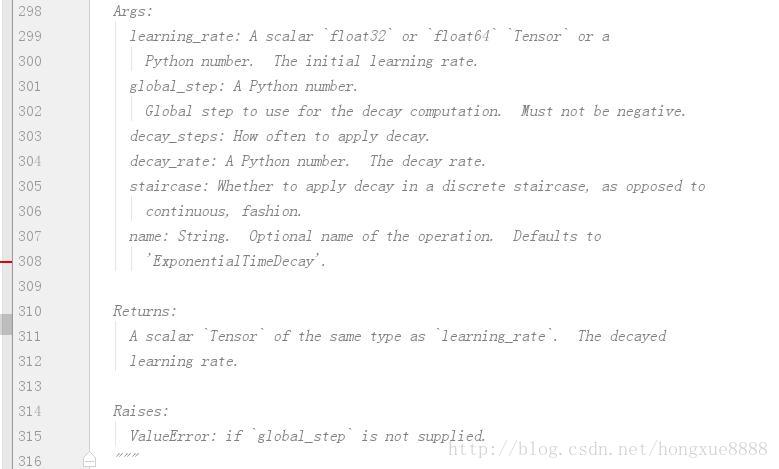

)3、natural_exp_decay自然指数衰减:

衰减以后的学习率是如下计算的:

decayed_learning_rate = learning_rate * exp(-decay_rate * global_step)示例代码: decay exponentially with a base of 0.96:

global_step = tf.Variable(0, trainable=False)

learning_rate = 0.1

k = 0.5

learning_rate = tf.train.exponential_time_decay(learning_rate, global_step, k)

# Passing global_step to minimize() will increment it at each step.

learning_step = (

tf.train.GradientDescentOptimizer(learning_rate)

.minimize(...my loss..., global_step=global_step)

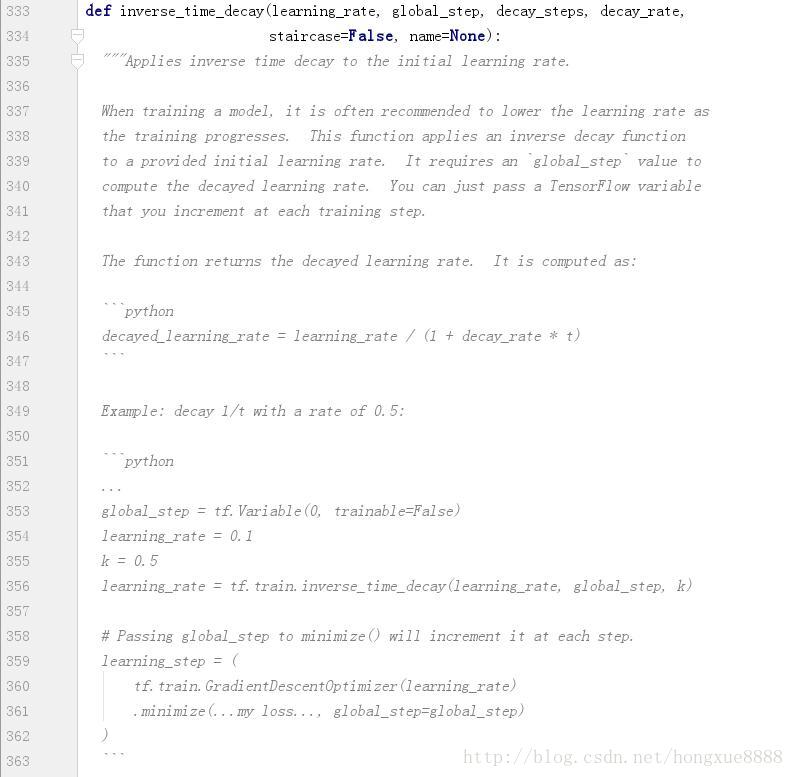

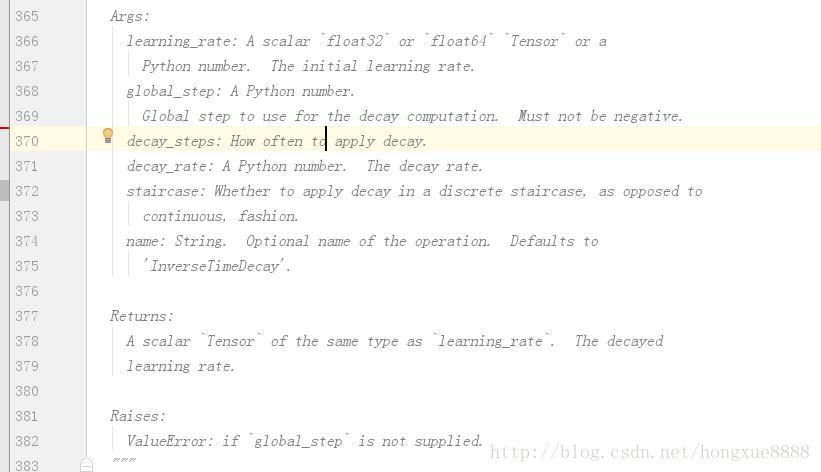

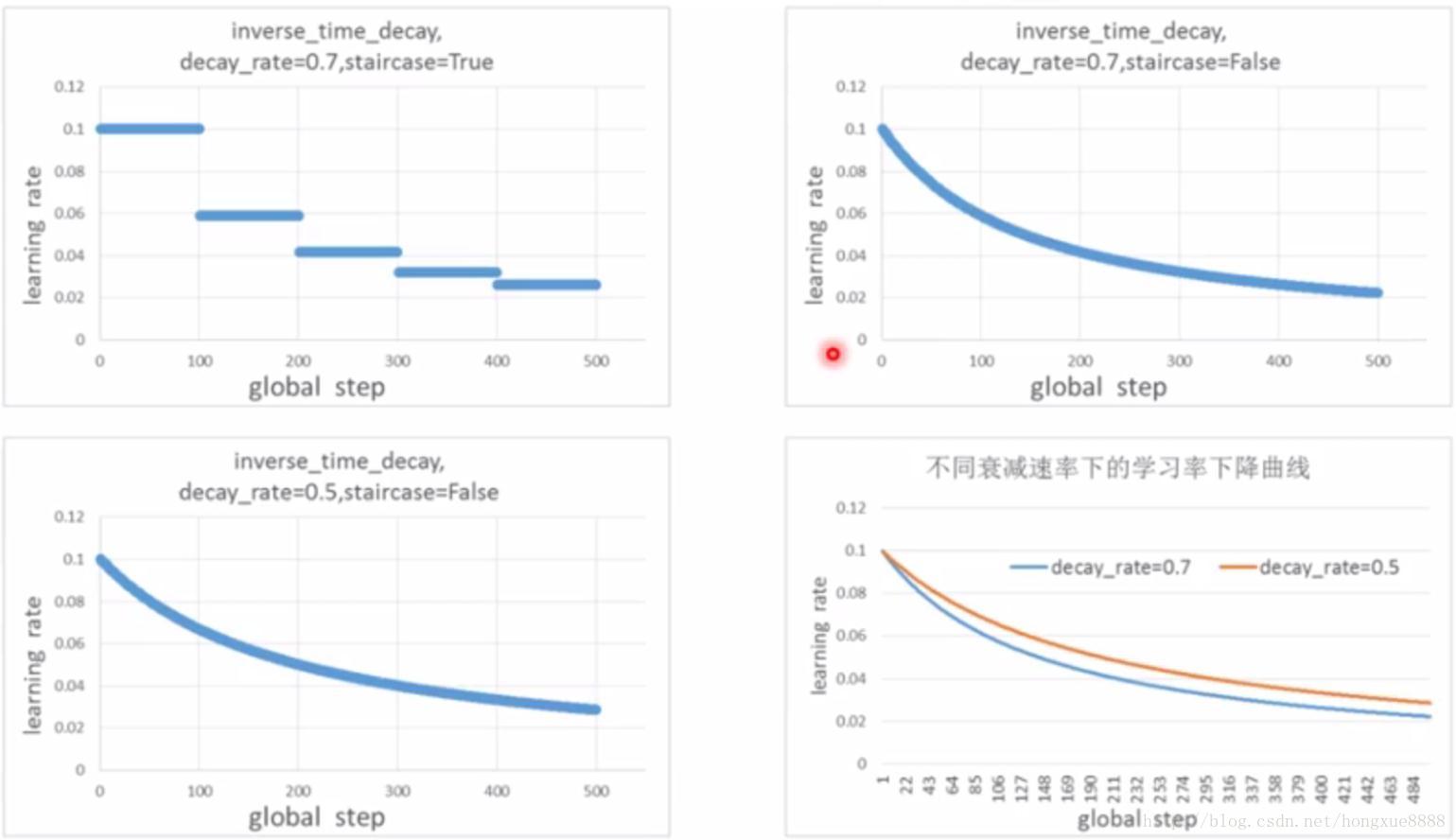

)4、inverse_time_decay逆时间衰减:

衰减以后的学习率是如下计算的:

decayed_learning_rate = learning_rate / (1 + decay_rate * t)示例代码: decay 1/t with a rate of 0.5:

global_step = tf.Variable(0, trainable=False)

learning_rate = 0.1

k = 0.5

learning_rate = tf.train.inverse_time_decay(learning_rate, global_step, k)

# Passing global_step to minimize() will increment it at each step.

learning_step = (

tf.train.GradientDescentOptimizer(learning_rate)

.minimize(...my loss..., global_step=global_step)

)代码如下:

#-*- coding:utf-8 -*-

#实现简单卷积神经网络对MNIST数据集进行分类:conv2d + activation + pool + fc

import csv

import tensorflow as tf

import os

from tensorflow.examples.tutorials.mnist import input_data

os.environ['TF_CPP_MIN_LOG_LEVEL'] = '2'

import sys

from six.moves import urllib

import tarfile

import cifar10_input

import numpy as np

# 设置算法超参数

training_epochs = 5

num_examples_per_epoch_for_train = 10000

batch_size = 100

learning_rate_init = 0.1

learning_rate_final = 0.001

learning_rate_decay_rate = 0.7

# learning_rate_decay_rate = 0.5

num_batches_per_epoch = int(num_examples_per_epoch_for_train/batch_size)

num_epochs_per_decay = 1 #Epochs after which learning rate decays

learning_rate_decay_steps = int(num_batches_per_epoch * num_epochs_per_decay)

display_step = 50

conv1_kernel_num = 32

conv2_kernel_num = 32

fc1_units_num = 250

fc2_units_num = 150

activation_func = tf.nn.relu

activation_name = 'relu'

l2loss_ratio = 0.05

with tf.Graph().as_default():

#优化器调用次数计算器,全局训练步数

global_step = tf.Variable(0,name='global_step',trainable=False,dtype=tf.int64)

#使用exponential_decay产生指衰减的学习率

learning_rate = tf.train.exponential_decay(learning_rate_init,

global_step,

learning_rate_decay_steps,

learning_rate_decay_rate,

staircase=False)

#使用polynomial_decay产生多项式衰减的学习率

# learning_rate = tf.train.polynomial_decay(learning_rate_init,

# global_step,

# learning_rate_decay_steps,

# learning_rate_decay_rate,

# staircase=False)

# 使用natural_exp_decay产生自然指数衰减的学习率

# learning_rate = tf.train.natural_exp_decay(learning_rate_init,

# global_step,

# learning_rate_decay_steps,

# learning_rate_decay_rate,

# staircase=False)

# 使用inverse_time_decay产生逆时间衰减的学习率

# learning_rate = tf.train.inverse_time_decay(learning_rate_init,

# global_step,

# learning_rate_decay_steps,

# learning_rate_decay_rate,

# staircase=False)

#定义损失函数

weights = tf.Variable(tf.random_normal([9000,9000],mean=0.0,stddev=1e9,dtype=tf.float32))

myloss = tf.nn.l2_loss(weights,name="L2Loss")

#传入 learning_rate创建优化器对象

optimizer = tf.train.GradientDescentOptimizer(learning_rate)

#将global_step传入minimize(),每次调用minimize都会使得global_step自增1.

training_op = optimizer.minimize(myloss,global_step=global_step)

#添加所有变量的初始化节点

init_op = tf.global_variables_initializer()

#将评估结果保存到文件

results_list = list()

results_list.append(['train_step','learning_rate','train_step','train_loss'])

#启动会话,训练模型

with tf.Session() as sess:

sess.run(init_op)

#训练指定轮数,每一轮的训练样本总数为:num_examples_per_epoch_for_train

for epoch in range(training_epochs):

print('********************************************')

#每一轮都要把所有的batch跑一遍

for batch_idx in range(num_batches_per_epoch):

#获取learning_rate的值

current_learning_rate = sess.run(learning_rate)

#执行训练节点,获取损失节点和global_step的值

_,loss_value,training_step = sess.run([training_op,myloss,global_step])

print("Training Epoch:" + str(epoch) +

",Training Step:" + str(training_step)+

",Learning Rate = " + "{:.6f}".format(current_learning_rate) +

",Learning Loss = " + "{:.6f}".format(loss_value))

#记录结果

results_list.append([training_step,current_learning_rate,training_step,loss_value])

#将评估结果保存到文件

print("训练结束,将结果保存到文件")

results_file = open('evaluate_results/learning_rate/exponential_decay/evaluate_results(decay_rate=0.7,staircase=False).csv','w',newline='')

csv_writer = csv.writer(results_file,dialect='excel')

for row in results_list:

csv_writer.writerow(row)

智能推荐

oracle 12c 集群安装后的检查_12c查看crs状态-程序员宅基地

文章浏览阅读1.6k次。安装配置gi、安装数据库软件、dbca建库见下:http://blog.csdn.net/kadwf123/article/details/784299611、检查集群节点及状态:[root@rac2 ~]# olsnodes -srac1 Activerac2 Activerac3 Activerac4 Active[root@rac2 ~]_12c查看crs状态

解决jupyter notebook无法找到虚拟环境的问题_jupyter没有pytorch环境-程序员宅基地

文章浏览阅读1.3w次,点赞45次,收藏99次。我个人用的是anaconda3的一个python集成环境,自带jupyter notebook,但在我打开jupyter notebook界面后,却找不到对应的虚拟环境,原来是jupyter notebook只是通用于下载anaconda时自带的环境,其他环境要想使用必须手动下载一些库:1.首先进入到自己创建的虚拟环境(pytorch是虚拟环境的名字)activate pytorch2.在该环境下下载这个库conda install ipykernelconda install nb__jupyter没有pytorch环境

国内安装scoop的保姆教程_scoop-cn-程序员宅基地

文章浏览阅读5.2k次,点赞19次,收藏28次。选择scoop纯属意外,也是无奈,因为电脑用户被锁了管理员权限,所有exe安装程序都无法安装,只可以用绿色软件,最后被我发现scoop,省去了到处下载XXX绿色版的烦恼,当然scoop里需要管理员权限的软件也跟我无缘了(譬如everything)。推荐添加dorado这个bucket镜像,里面很多中文软件,但是部分国外的软件下载地址在github,可能无法下载。以上两个是官方bucket的国内镜像,所有软件建议优先从这里下载。上面可以看到很多bucket以及软件数。如果官网登陆不了可以试一下以下方式。_scoop-cn

Element ui colorpicker在Vue中的使用_vue el-color-picker-程序员宅基地

文章浏览阅读4.5k次,点赞2次,收藏3次。首先要有一个color-picker组件 <el-color-picker v-model="headcolor"></el-color-picker>在data里面data() { return {headcolor: ’ #278add ’ //这里可以选择一个默认的颜色} }然后在你想要改变颜色的地方用v-bind绑定就好了,例如:这里的:sty..._vue el-color-picker

迅为iTOP-4412精英版之烧写内核移植后的镜像_exynos 4412 刷机-程序员宅基地

文章浏览阅读640次。基于芯片日益增长的问题,所以内核开发者们引入了新的方法,就是在内核中只保留函数,而数据则不包含,由用户(应用程序员)自己把数据按照规定的格式编写,并放在约定的地方,为了不占用过多的内存,还要求数据以根精简的方式编写。boot启动时,传参给内核,告诉内核设备树文件和kernel的位置,内核启动时根据地址去找到设备树文件,再利用专用的编译器去反编译dtb文件,将dtb还原成数据结构,以供驱动的函数去调用。firmware是三星的一个固件的设备信息,因为找不到固件,所以内核启动不成功。_exynos 4412 刷机

Linux系统配置jdk_linux配置jdk-程序员宅基地

文章浏览阅读2w次,点赞24次,收藏42次。Linux系统配置jdkLinux学习教程,Linux入门教程(超详细)_linux配置jdk

随便推点

matlab(4):特殊符号的输入_matlab微米怎么输入-程序员宅基地

文章浏览阅读3.3k次,点赞5次,收藏19次。xlabel('\delta');ylabel('AUC');具体符号的对照表参照下图:_matlab微米怎么输入

C语言程序设计-文件(打开与关闭、顺序、二进制读写)-程序员宅基地

文章浏览阅读119次。顺序读写指的是按照文件中数据的顺序进行读取或写入。对于文本文件,可以使用fgets、fputs、fscanf、fprintf等函数进行顺序读写。在C语言中,对文件的操作通常涉及文件的打开、读写以及关闭。文件的打开使用fopen函数,而关闭则使用fclose函数。在C语言中,可以使用fread和fwrite函数进行二进制读写。 Biaoge 于2024-03-09 23:51发布 阅读量:7 ️文章类型:【 C语言程序设计 】在C语言中,用于打开文件的函数是____,用于关闭文件的函数是____。

Touchdesigner自学笔记之三_touchdesigner怎么让一个模型跟着鼠标移动-程序员宅基地

文章浏览阅读3.4k次,点赞2次,收藏13次。跟随鼠标移动的粒子以grid(SOP)为partical(SOP)的资源模板,调整后连接【Geo组合+point spirit(MAT)】,在连接【feedback组合】适当调整。影响粒子动态的节点【metaball(SOP)+force(SOP)】添加mouse in(CHOP)鼠标位置到metaball的坐标,实现鼠标影响。..._touchdesigner怎么让一个模型跟着鼠标移动

【附源码】基于java的校园停车场管理系统的设计与实现61m0e9计算机毕设SSM_基于java技术的停车场管理系统实现与设计-程序员宅基地

文章浏览阅读178次。项目运行环境配置:Jdk1.8 + Tomcat7.0 + Mysql + HBuilderX(Webstorm也行)+ Eclispe(IntelliJ IDEA,Eclispe,MyEclispe,Sts都支持)。项目技术:Springboot + mybatis + Maven +mysql5.7或8.0+html+css+js等等组成,B/S模式 + Maven管理等等。环境需要1.运行环境:最好是java jdk 1.8,我们在这个平台上运行的。其他版本理论上也可以。_基于java技术的停车场管理系统实现与设计

Android系统播放器MediaPlayer源码分析_android多媒体播放源码分析 时序图-程序员宅基地

文章浏览阅读3.5k次。前言对于MediaPlayer播放器的源码分析内容相对来说比较多,会从Java-&amp;gt;Jni-&amp;gt;C/C++慢慢分析,后面会慢慢更新。另外,博客只作为自己学习记录的一种方式,对于其他的不过多的评论。MediaPlayerDemopublic class MainActivity extends AppCompatActivity implements SurfaceHolder.Cal..._android多媒体播放源码分析 时序图

java 数据结构与算法 ——快速排序法-程序员宅基地

文章浏览阅读2.4k次,点赞41次,收藏13次。java 数据结构与算法 ——快速排序法_快速排序法